Содержание

- 2. Задача: оптимизация приложения вконтакте

- 3. 30 тыс пользователей до 9 секунд на запрос 5 серверов надо опустить время ответа до 500

- 4. Более 2-х млн пользователей 25 мс на запрос 14 серверов 40K RPM и 20 млн записей

- 5. Ежедневная смена требований Экспоненциальный рост нагрузки Поровну записи и чтения Сделать быстро, дешево и приемлемо С

- 6. Что оказалось важным в нашем случае

- 7. Грамотный менеджер «Щасспрошу» завалит проект Персонал

- 8. Системный администратор. Получше, чем «aptitude-джан» Персонал

- 9. Наша команда злых марсиан! http://evilmartians.ru/ Персонал

- 10. Волшебных гномиков нет.

- 11. Нет их даже в MongoDB и memcached

- 12. pgpool — master-master медленный memcached — нечего кешировать Сразу выкинули

- 13. Ruby on Rails — нужна гибкость PostgreSQL — часто меняется схема RabbitMQ — задержка записи внешний

- 14. Что мы делали

- 15. Без него никуда Догадки не работают newrelic.com Фоновые задачи очень важны Профилирование

- 16. Место на дисках Упавшие серверы Длины очередей Ночной дежурный (?) Мониторинг

- 17. Нужны реляционные выборки Часто меняются критерии PostgreSQL быстр и удобен Индексы — основной дисковый IO SQL

- 18. Много данных рядом — плохо Нам повезло с логикой выборок Шардинг: user_id % 100 Надо планировать

- 19. Меньше всего проблем Zero-downtime deploy с unicorn-ом Плохая поддержка шардинга Необходимость RabbitMQ Ruby on Rails

- 20. Самая быстрая часть проекта Оказался индикатором состояния Мучительное восстановление RabbitMQ

- 22. Скачать презентацию

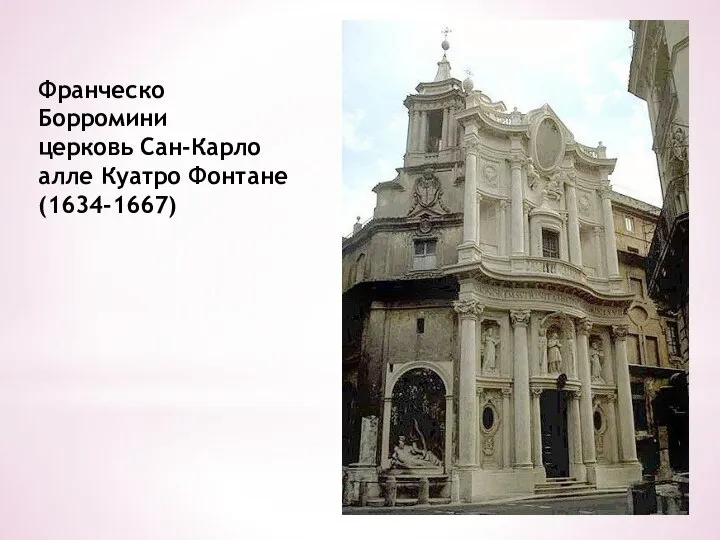

Культура Западной Европы 17-18 веков

Культура Западной Европы 17-18 веков Что едят русские по мнению иностранцев

Что едят русские по мнению иностранцев Памятники русской архитектуры XVII

Памятники русской архитектуры XVII “Исследование космических лучей на аэростатных высотах (эксперимент “СФЕРА”)” за 2005 г.

“Исследование космических лучей на аэростатных высотах (эксперимент “СФЕРА”)” за 2005 г. Ораторское мастерство

Ораторское мастерство План розвитку Великобудищанської спеціалізованої школи І-ІІІ ступенів

План розвитку Великобудищанської спеціалізованої школи І-ІІІ ступенів Banket-chay_20

Banket-chay_20 Коммуникационные технологии во внешнеэкономической деятельности предприятия

Коммуникационные технологии во внешнеэкономической деятельности предприятия Новая линейка комбо устройств MiVue iсерии

Новая линейка комбо устройств MiVue iсерии Конфликты в школе. Профилактика конфликтов в школьной среде, поиск путей предотвращения и преодоления конфликтных ситуаций

Конфликты в школе. Профилактика конфликтов в школьной среде, поиск путей предотвращения и преодоления конфликтных ситуаций Что такое светская этика (4 класс)

Что такое светская этика (4 класс) Варвари біля воріт Принципи корпоративного управління

Варвари біля воріт Принципи корпоративного управління Как получается мёд

Как получается мёд Физиология мотивации

Физиология мотивации Лидер детского молодежного объединения

Лидер детского молодежного объединения Личная гигиена спортсмена

Личная гигиена спортсмена Коммерческое предложение по установке КМС-400/1

Коммерческое предложение по установке КМС-400/1 Ференц Лист

Ференц Лист Предприятие-субъект предпринимательской деятельности

Предприятие-субъект предпринимательской деятельности ОРГАНИЗАЦИЯ ТЕКУЩЕГО КОНТРОЛЯ И ПРОМЕЖУТОЧНОЙ АТТЕСТАЦИИ СТУДЕНТОВС ИСПОЛЬЗОВАНИЕМ БАЛЛЬНО-РЕЙТИНГОВОЙ СИСТЕМЫ ОЦЕНКИ УСПЕВАЕ

ОРГАНИЗАЦИЯ ТЕКУЩЕГО КОНТРОЛЯ И ПРОМЕЖУТОЧНОЙ АТТЕСТАЦИИ СТУДЕНТОВС ИСПОЛЬЗОВАНИЕМ БАЛЛЬНО-РЕЙТИНГОВОЙ СИСТЕМЫ ОЦЕНКИ УСПЕВАЕ Организация здоровьесберегающей среды в школе

Организация здоровьесберегающей среды в школе Презентация на тему КРАСНОДАР

Презентация на тему КРАСНОДАР  жылу баланс (1)

жылу баланс (1) Праздник весны и труда. 1 Мая

Праздник весны и труда. 1 Мая Учитель основ безопасности жизнедеятельности школы №84 Горлов Сергей Сергеевич

Учитель основ безопасности жизнедеятельности школы №84 Горлов Сергей Сергеевич Землетрясения Подготовила презентацию студентка 1ого курса ЭФ Группы Э112Б Олефир Карина

Землетрясения Подготовила презентацию студентка 1ого курса ЭФ Группы Э112Б Олефир Карина Modern China

Modern China  Правовое положение личности

Правовое положение личности