Содержание

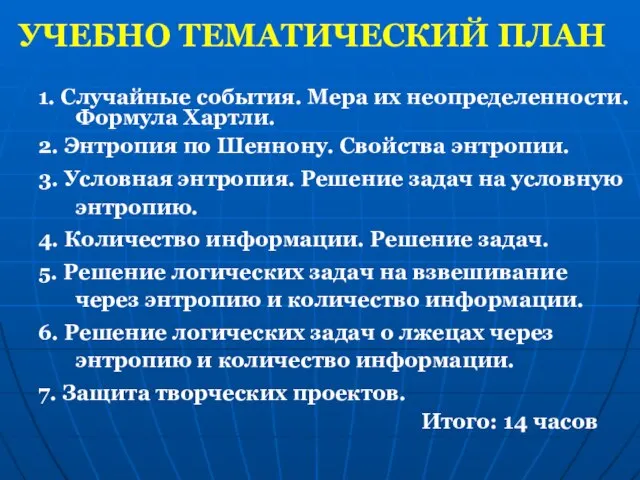

- 2. 1. Случайные события. Мера их неопределенности. Формула Хартли. 2. Энтропия по Шеннону. Свойства энтропии. 3. Условная

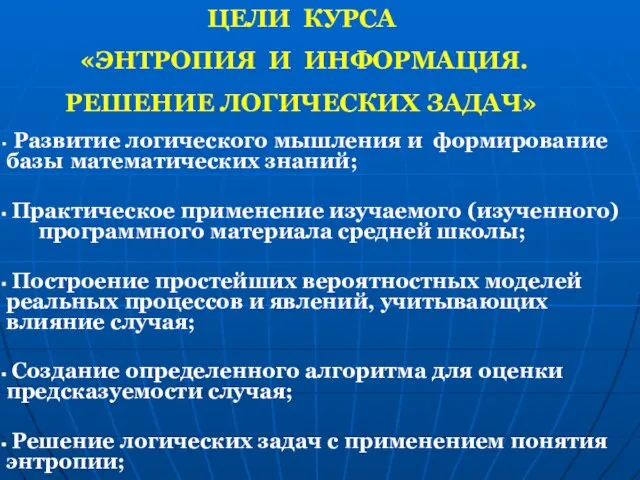

- 3. ЦЕЛИ КУРСА «ЭНТРОПИЯ И ИНФОРМАЦИЯ. РЕШЕНИЕ ЛОГИЧЕСКИХ ЗАДАЧ» Развитие логического мышления и формирование базы математических знаний;

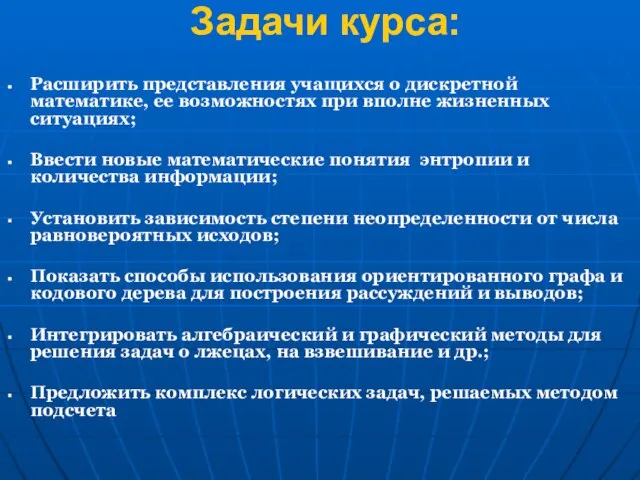

- 4. Задачи курса: Расширить представления учащихся о дискретной математике, ее возможностях при вполне жизненных ситуациях; Ввести новые

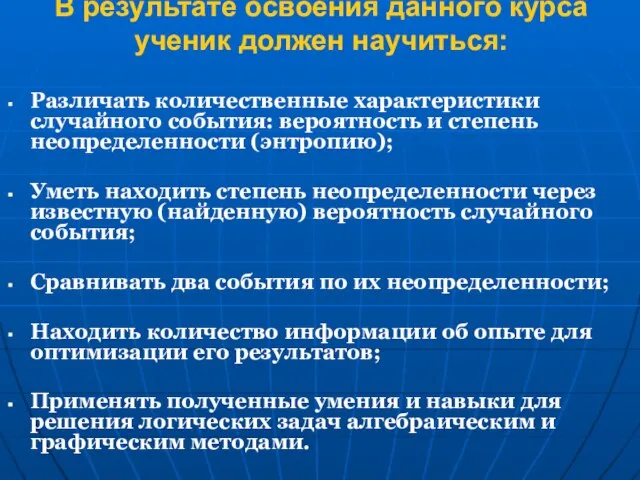

- 5. В результате освоения данного курса ученик должен научиться: Различать количественные характеристики случайного события: вероятность и степень

- 6. Занятие №1. Случайные события. Мера их неопределенности. Формула Хартли. Цель занятия: Вспомнить понятие случайных событий; Ввести

- 7. Занятие №1. Случайные события. Мера их неопределенности. Формула Хартли. Задачи занятия: Научиться среди предложенных событий выбирать

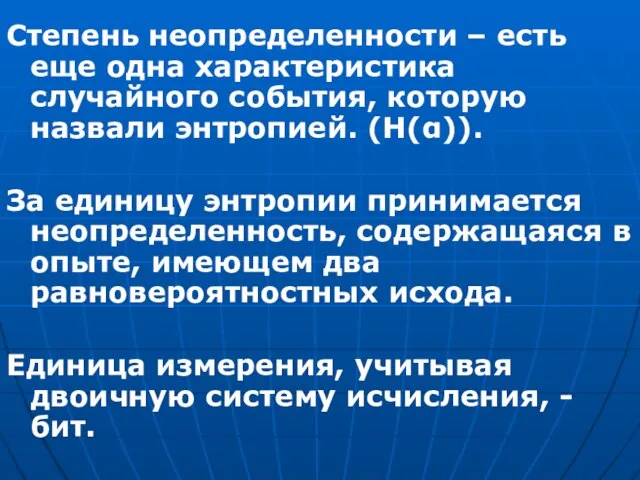

- 8. Степень неопределенности – есть еще одна характеристика случайного события, которую назвали энтропией. (Н(α)). За единицу энтропии

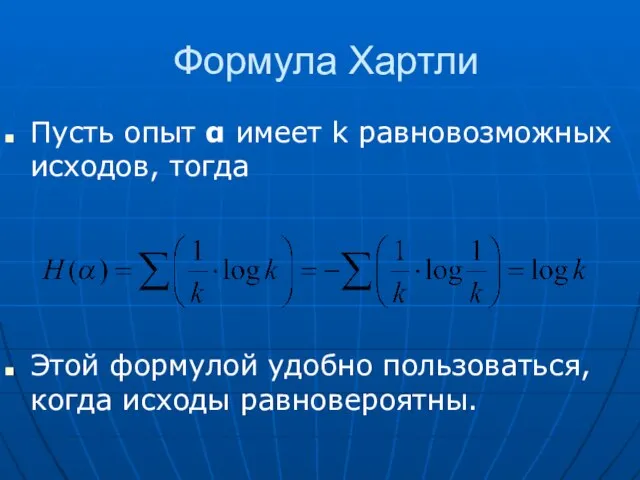

- 9. Формула Хартли Пусть опыт α имеет k равновозможных исходов, тогда Этой формулой удобно пользоваться, когда исходы

- 10. Чем больше равновероятных исходов, тем больше степень неопределенности Чем меньше вероятность, тем больше степень неопределенности Что

- 11. ПРИЛОЖЕНИЕ №2.

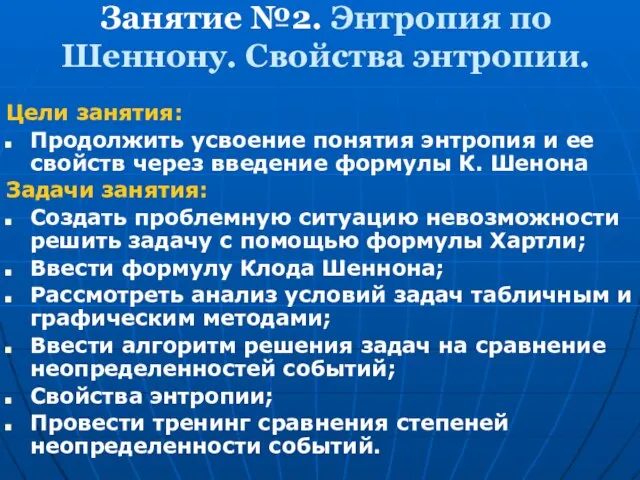

- 12. Занятие №2. Энтропия по Шеннону. Свойства энтропии. Цели занятия: Продолжить усвоение понятия энтропия и ее свойств

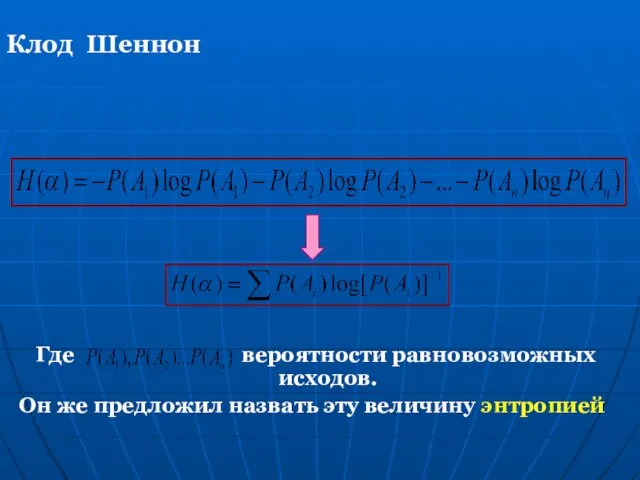

- 13. Где вероятности равновозможных исходов. Он же предложил назвать эту величину энтропией Клод Шеннон

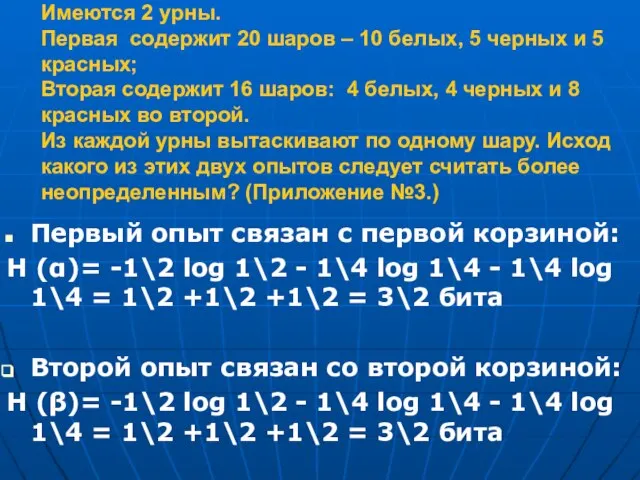

- 14. Имеются 2 урны. Первая содержит 20 шаров – 10 белых, 5 черных и 5 красных; Вторая

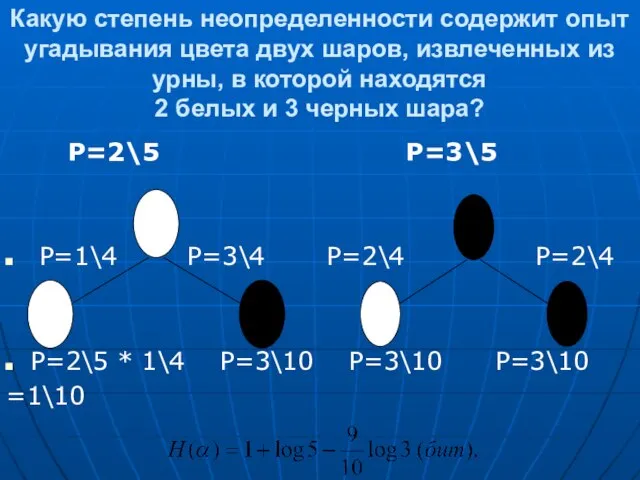

- 15. Какую степень неопределенности содержит опыт угадывания цвета двух шаров, извлеченных из урны, в которой находятся 2

- 16. Занятие №3. Условная энтропия. Решение задач на условную энтропию. Цель занятия: введение понятия условной энтропии для

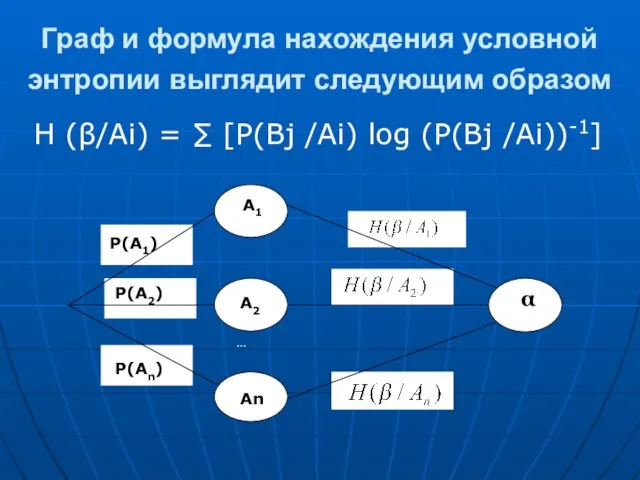

- 17. Граф и формула нахождения условной энтропии выглядит следующим образом Н (β/Аi) = ∑ [Р(Вj /Аi) log

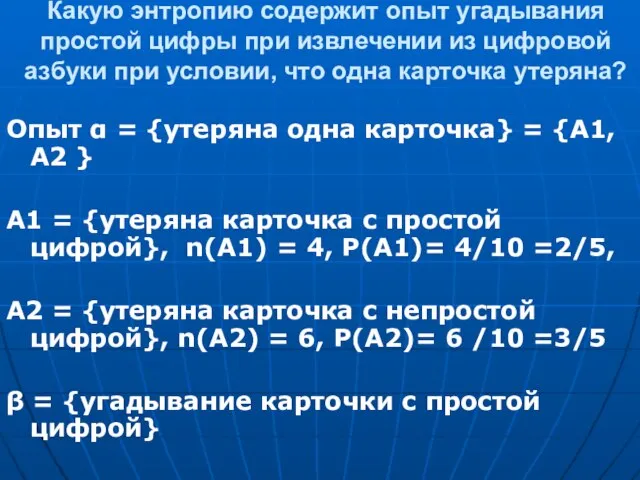

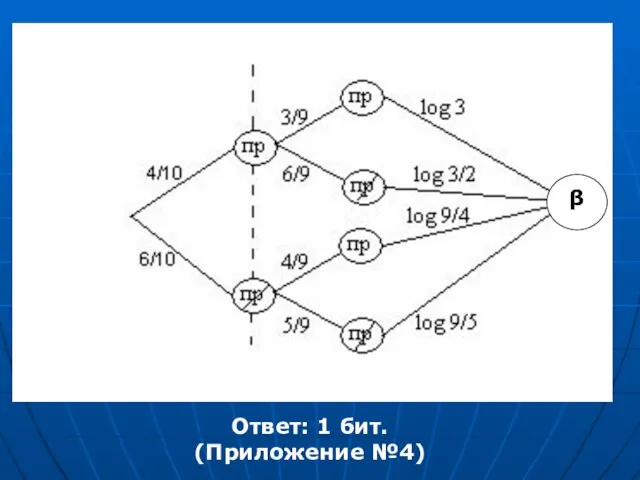

- 18. Какую энтропию содержит опыт угадывания простой цифры при извлечении из цифровой азбуки при условии, что одна

- 19. β Ответ: 1 бит. (Приложение №4)

- 20. Занятие №4. Количество информации. Решение задач Цель занятия: Введение понятия количества информации для решения задач Задачи

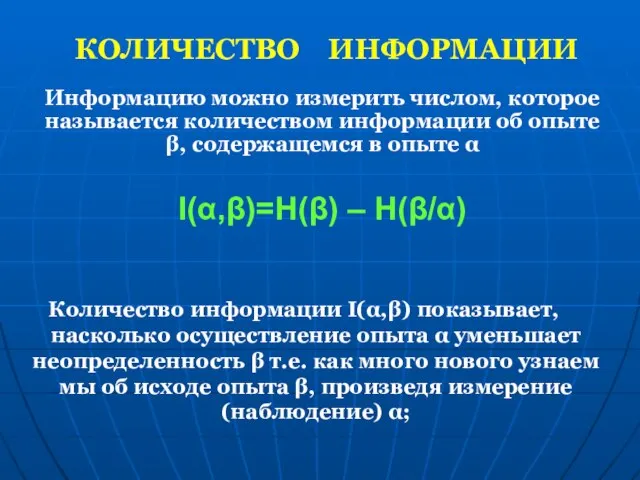

- 21. КОЛИЧЕСТВО ИНФОРМАЦИИ Количество информации I(α,β) показывает, насколько осуществление опыта α уменьшает неопределенность β т.е. как много

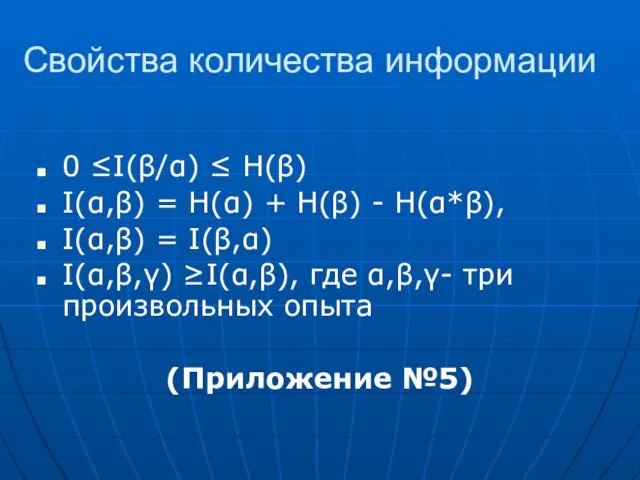

- 22. Свойства количества информации 0 ≤I(β/α) ≤ Н(β) I(α,β) = Н(α) + Н(β) - Н(α*β), I(α,β) =

- 23. Решение логических задач на взвешивание через энтропию и количество информации.

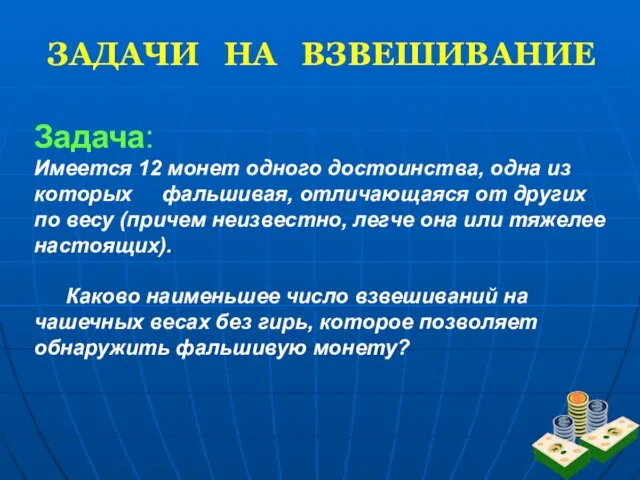

- 24. ЗАДАЧИ НА ВЗВЕШИВАНИЕ Задача: Имеется 12 монет одного достоинства, одна из которых фальшивая, отличающаяся от других

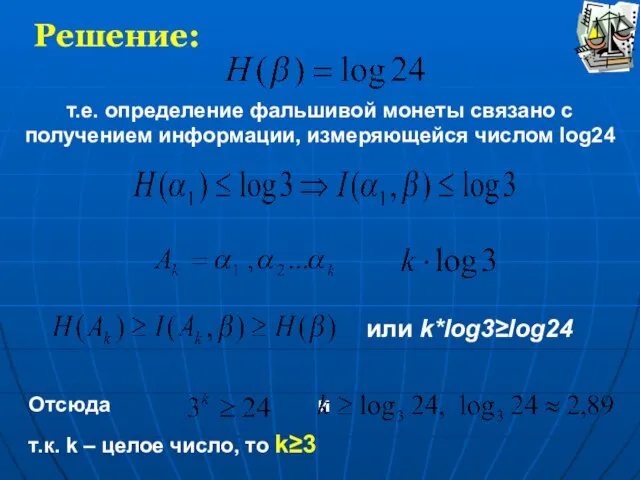

- 25. Решение: т.е. определение фальшивой монеты связано с получением информации, измеряющейся числом log24 или k*log3≥log24 Отсюда и

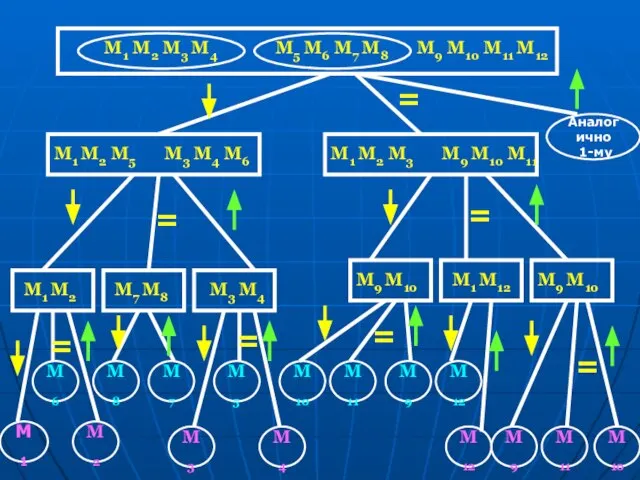

- 26. M1 M2 M3 M4 M5 M6 M7 M8 M9 M10 M11 M12 = M3 M4 M6

- 28. Скачать презентацию

Психология общения. Тема 2

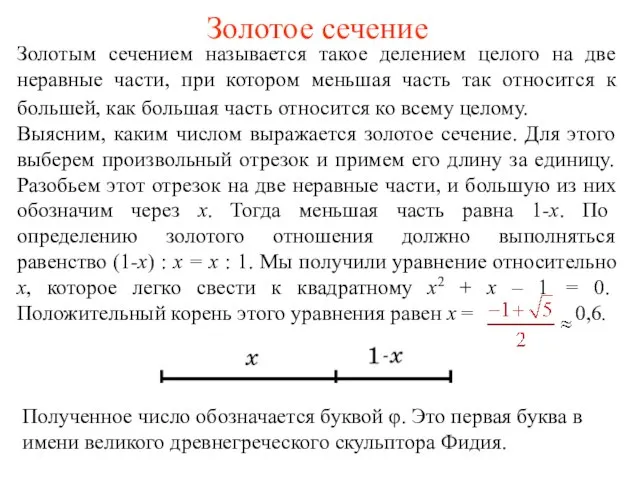

Психология общения. Тема 2 Золотое сечение

Золотое сечение Основные производственные фонды

Основные производственные фонды Сон без стресса и тревоги

Сон без стресса и тревоги Компетентностный

Компетентностный Опыт внедрения системы Офис-кайдзен в ТЭЦ ОАО Иркутскэнерго

Опыт внедрения системы Офис-кайдзен в ТЭЦ ОАО Иркутскэнерго Адаптация спортсменов к выполнению специфических статических нагрузок

Адаптация спортсменов к выполнению специфических статических нагрузок Обеспечение карьерного роста в образовательном учреждении

Обеспечение карьерного роста в образовательном учреждении Бизнес план

Бизнес план Презентация на тему Лицейские друзья Пушкина

Презентация на тему Лицейские друзья Пушкина  Настольный теннис. Правила игры

Настольный теннис. Правила игры Презентация на тему Общественный строй Древней Руси (6 класс)

Презентация на тему Общественный строй Древней Руси (6 класс) Международный день грамотности

Международный день грамотности YTRON® ... все зависит от головки!

YTRON® ... все зависит от головки! Введение в алгебру логики

Введение в алгебру логики О Корабле

О Корабле Иллюзии зрения

Иллюзии зрения Мультивалютный сервис Alpha Cash

Мультивалютный сервис Alpha Cash Нормы трудового права. Тест

Нормы трудового права. Тест ИСТОРИЯ ОРУЖИЯ

ИСТОРИЯ ОРУЖИЯ Музеи изобразительного искусства

Музеи изобразительного искусства Баргузинский заповедник как составная часть природного наследия "озеро Байкал"

Баргузинский заповедник как составная часть природного наследия "озеро Байкал" Организация учебного процесса на 1 курсе ОЗО

Организация учебного процесса на 1 курсе ОЗО Content_Changes

Content_Changes Классицизм и барокко

Классицизм и барокко Полуектов Иван Фёдорович (29.08.1903 - 12.07.1944)

Полуектов Иван Фёдорович (29.08.1903 - 12.07.1944) Организация учета документов АФ РФ и других архивных документов в архиве

Организация учета документов АФ РФ и других архивных документов в архиве Кормление свиней. Составление кормовых смесей

Кормление свиней. Составление кормовых смесей