Слайд 2ARHITECTURĂ

Felul în care este construit sau alcătuit ceva; aspectul compozițional al

unei opere artistice; structură. – Din fr. architecture, lat. architectura.

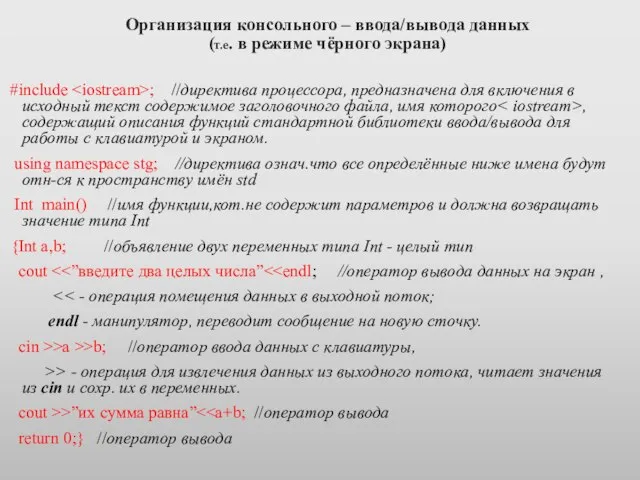

Слайд 3Arhitectura Multistrat a RN

Neuronii pot fi conectați în diferite moduri pentru a

forma o rețea neurală

O rețea neurală multistrat conține:

două sau mai multe straturi de neuroni

Primul strat primește intrările din mediu

Ieșirile din primul strat sunt intrări pentru stratul următor

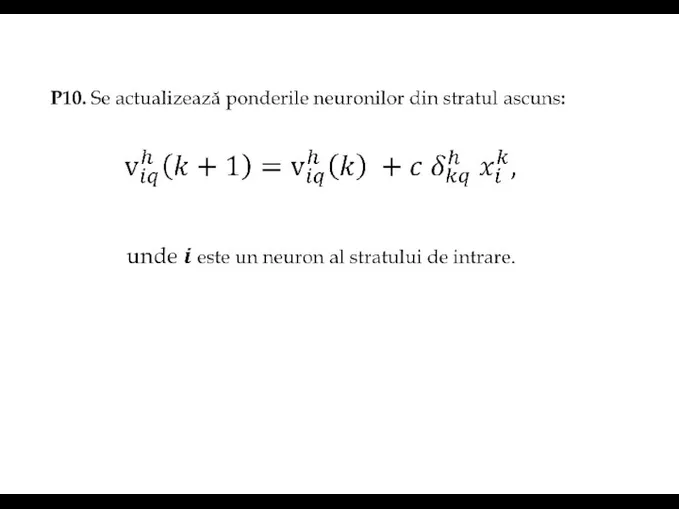

Ieșirea rețelei este formată din ieșirile neuronilor din ultimul strat

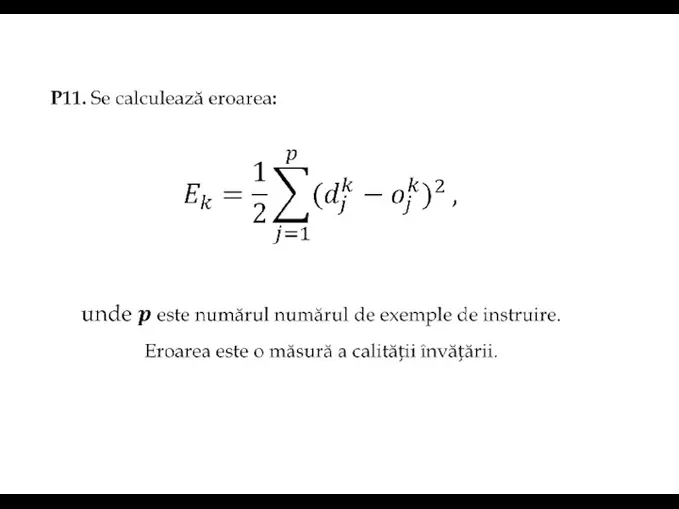

Straturile situate între primul și ultimul strat se numesc straturi ascunse ale rețelei

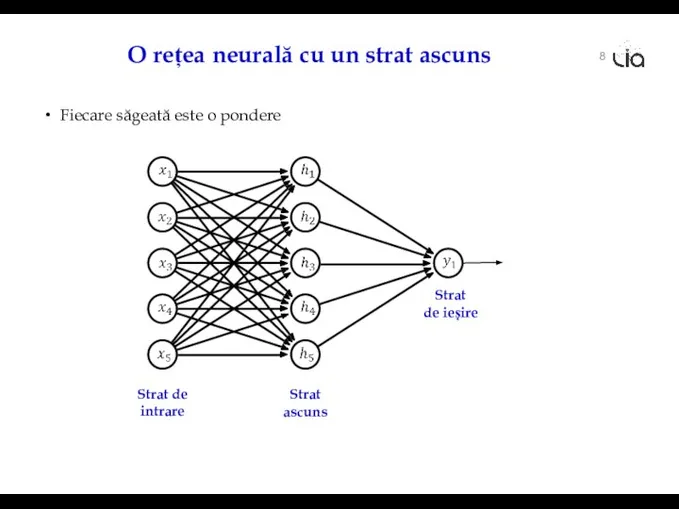

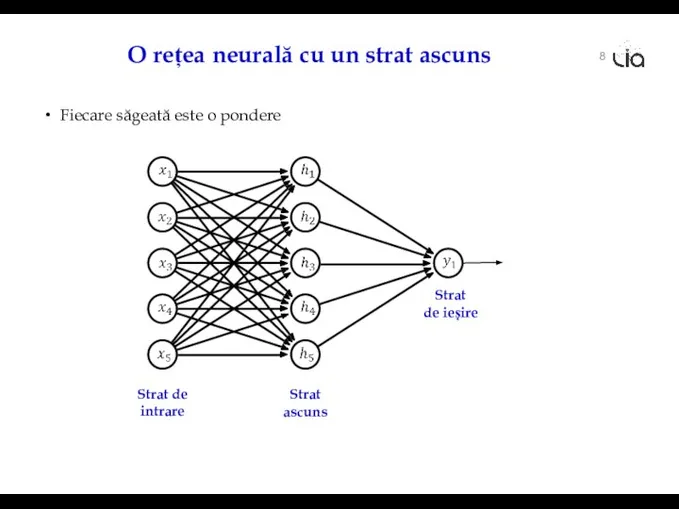

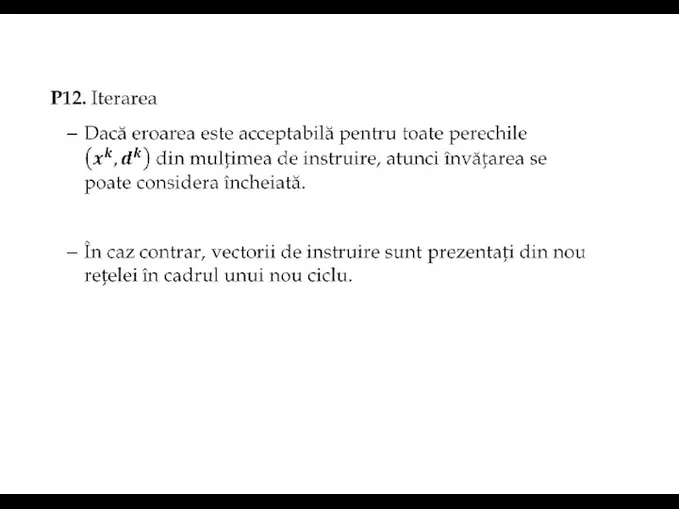

Слайд 4O rețea neurală cu un strat ascuns

8

Fiecare săgeată este o pondere

Strat

de

intrare

Strat

ascuns

Strat

de ieșire

Слайд 53 concepte importante

Transformare

Instruire

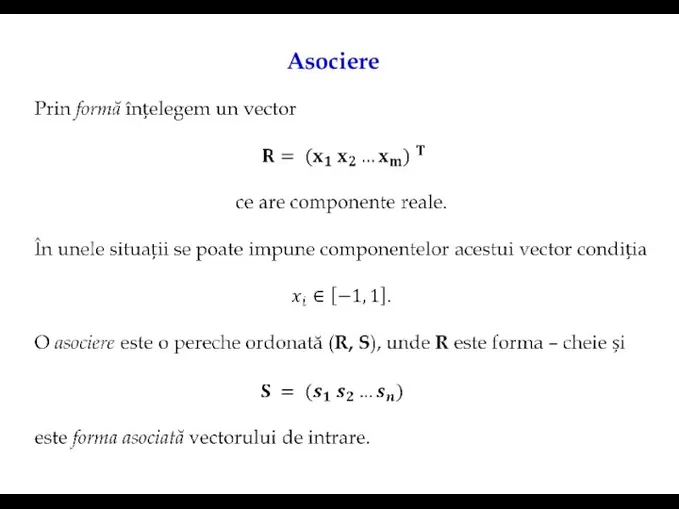

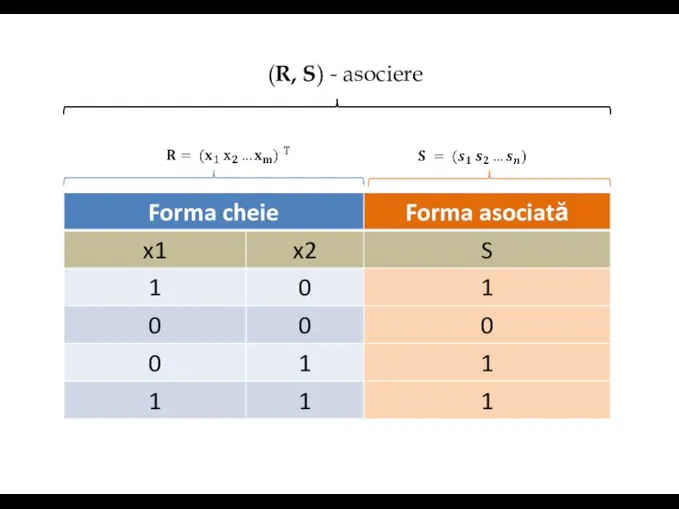

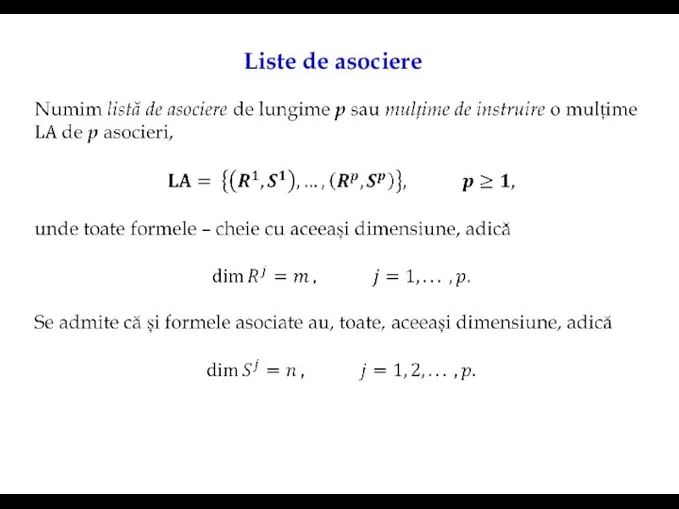

Asociere

Слайд 6Transformare

Rețelele neuronale transformă o anumită configurație de intrare într-o configurație de ieșire

Ieșirile rețelei pot corespunde unei acțiuni pe care rețeaua trebuie să o realizeze

Ieșirile rețelei pot prezenta o clasificare a obiectelor prezentate la intrare

În general, ieșirea poate fi orice transformare a spațiului de intrare, deci funcționarea rețelei reprezintă o aplicație (proiecție, transformare) a spațiului vectorilor de intrare în spațiul vectorilor de ieșire

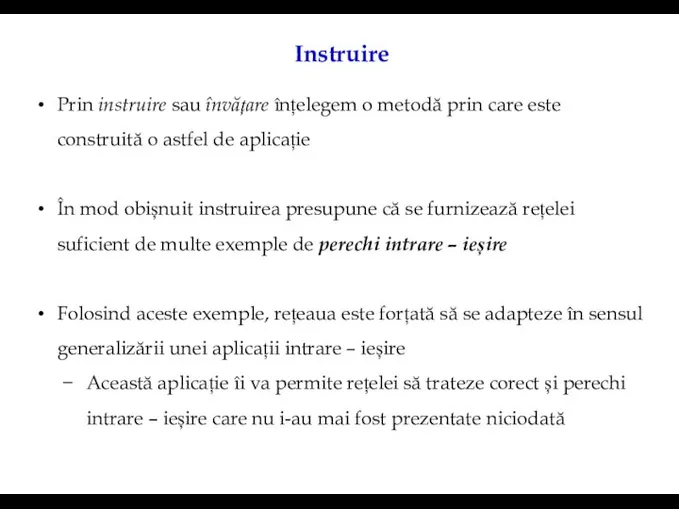

Слайд 7Instruire

Prin instruire sau învățare înțelegem o metodă prin care este construită o

astfel de aplicație

În mod obișnuit instruirea presupune că se furnizează rețelei suficient de multe exemple de perechi intrare – ieșire

Folosind aceste exemple, rețeaua este forțată să se adapteze în sensul generalizării unei aplicații intrare – ieșire

Această aplicație îi va permite rețelei să trateze corect și perechi intrare – ieșire care nu i-au mai fost prezentate niciodată

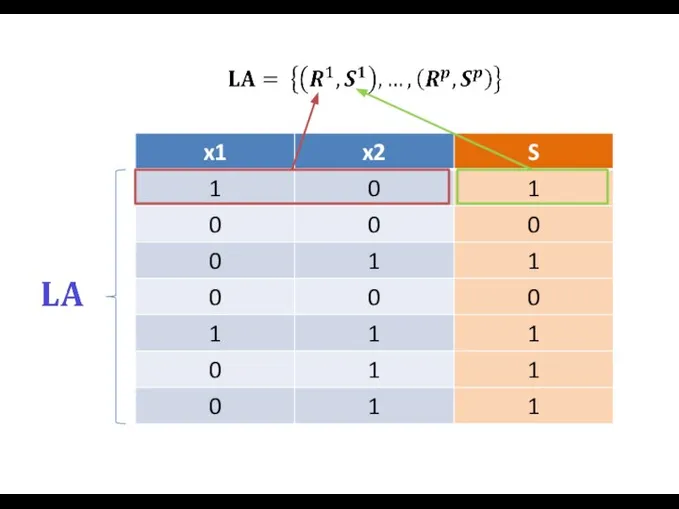

Слайд 12În Rețelele Neurale asocierile se memorează în ponderile sinapselor neuronilor

Reprezentarea unei

asociații este distribuită peste mai multe conexiuni

Reciproc, fiecare conexiune este implicată în memorarea mai multor asocieri

Această reprezentare distribuită înzestrează sistemul cu un anumit grad de robustețe față de deteriorări fizice minore,

În plus, permite sistemul să „observe” (să detecteze) anumite regularități în mulțimea de instruire

Слайд 13Faza în care toate asocierile sunt memorate sau învățate reprezintă faza de

instruire a rețelei

Faza de lucru - este caracterizată printr-un proces de regăsire

În această fază se prezintă rețelei diferite forme-cheie

Слайд 14Faza de lucru și de instruire

Semnalul se propagă în rețea dinspre stratul

de intrare spre cel de ieșire

În faza de lucru avem o propagare înainte a semnalului

În faza de instruire avem o propagare înapoi a erorii

În continuare vom prezenta algoritmul de propagare înapoi

Слайд 15Algoritmul de propagare înapoi (I)

Algoritmul de propagare înapoi – retro-propagare (Back Propagation,

BP):

cel mai important şi mai utilizat algoritm pentru instruirea reţelelor neuronale multistrat

Popularitatea sa a constituit un factor important în reînvierea direcţiei conexioniste, în Inteligenţa Artificială

Слайд 16Algoritmul de propagare înapoi (II)

Algoritmul de propagare înapoi este o metodă de

instruire în reţelele neuronale multistrat cu transmitere înainte (reţele unidirecţionale),

în care se urmăreşte minimizarea erorii medii pătratice printr-o metodă de gradient.

Слайд 17Caracteristici

BP acţionează asupra unei arhitecturi cu mai mulţi neuroni organizaţi în straturi

multiple, dintre care unele straturi sunt ascunse iar neuronii au funcţii de ieşire sigmoidale.

Слайд 18Scurt istoric

Ideea propagării înapoi a fost redescoperită de mai multe ori

1974: Paul

Werbos

1982: David Parker și Rumelhart („Parallel Distributed Processing")

autorii au sugerat că algoritmul de propagare înapoi sau regula delta generalizată (cum au numit-o ei) poate depăşi limitările algoritmului perceptronului, enumerate de Minsky şi Papert (1969).

Слайд 19Primele practici

În cadrul unui experiment pentru a sintetiza vocea dintr-un text scris,

fără a face apel la reguli ale unui sistem expert (Sejnowski şi Grossberg, 1987)

O bandă magnetică conţinea o bogată experienţă de instruire

Răsunetul pe care acest experiment l-a avut, a determinat popularizarea sa rapidă ca „un nou algoritm de instruire care învaţă din experienţă”.

Слайд 20Aplicații

S-a apreciat că algoritmul de propagare înapoi ar putea avea numeroase aplicaţii

potenţiale:

recunoaşterea în timp real a vorbirii,

traducerea automată,

vedere artificială

Слайд 21Analogie

Psihologii şi neurofiziologii au căutat să identifice algoritmul de propagare înapoi în

funcţionarea creierului uman şi a sistemului nervos central

Cel puţin până acum, nu s-a descoperit analogia biologică a algoritmului de retro-propagare

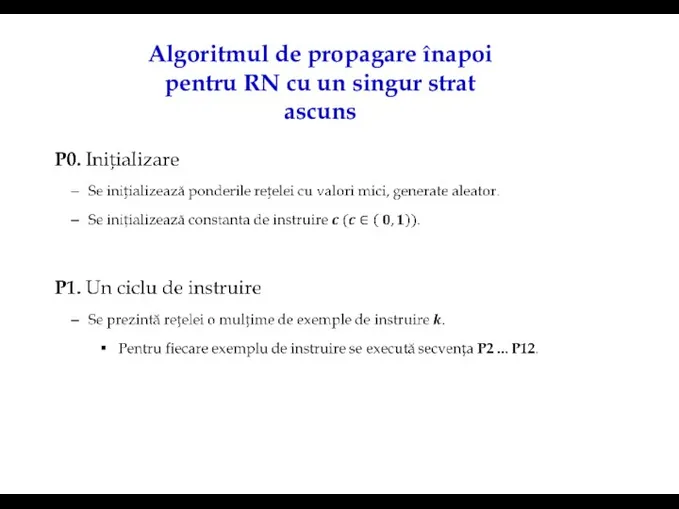

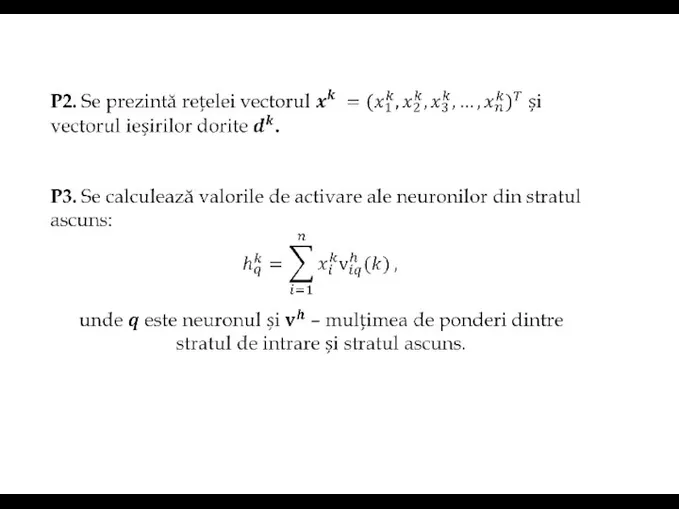

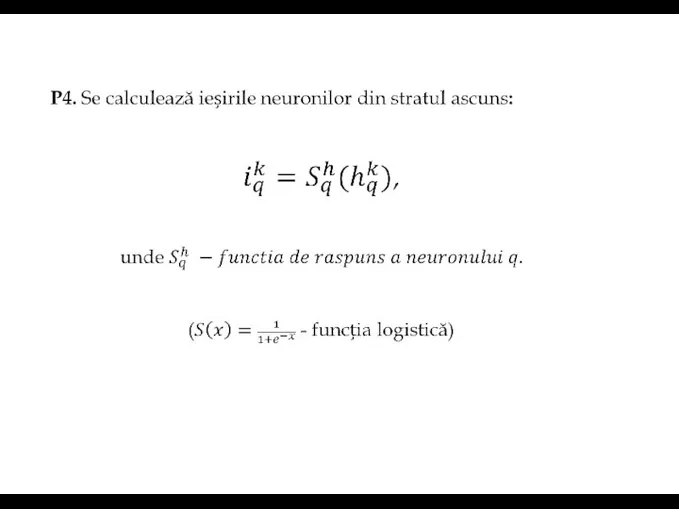

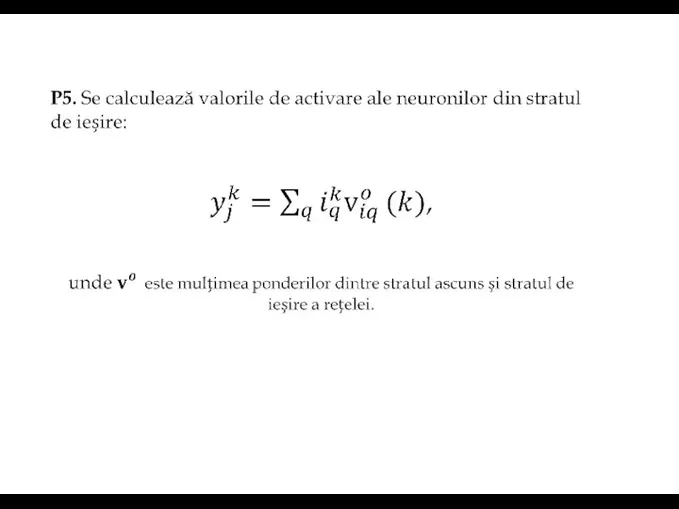

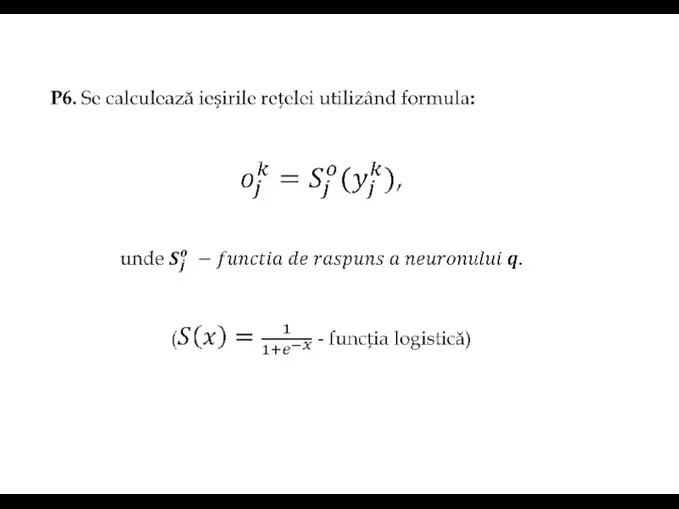

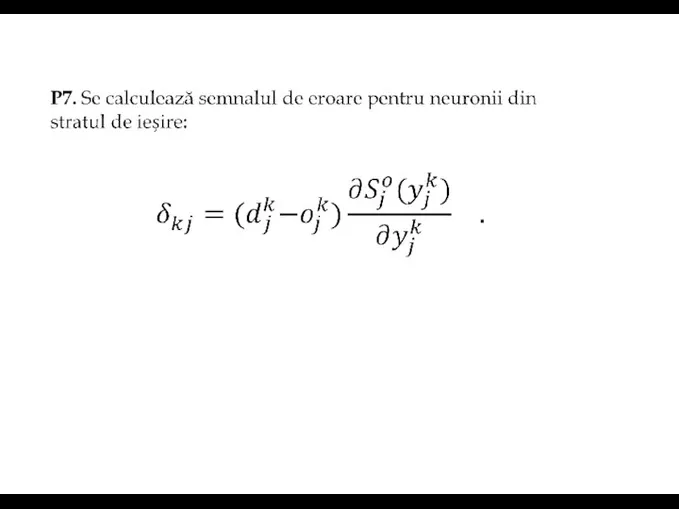

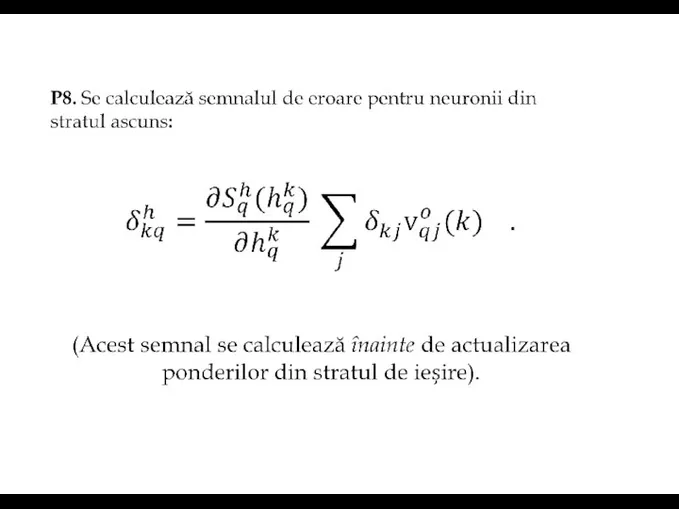

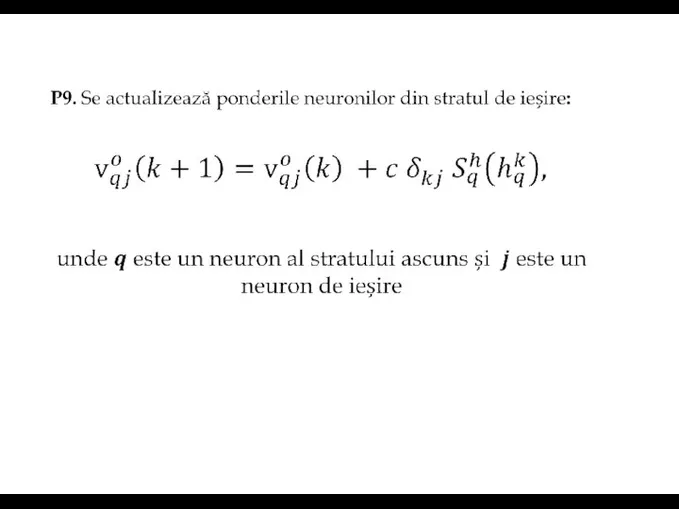

Слайд 22Algoritmul de propagare înapoi pentru RN cu un singur strat ascuns

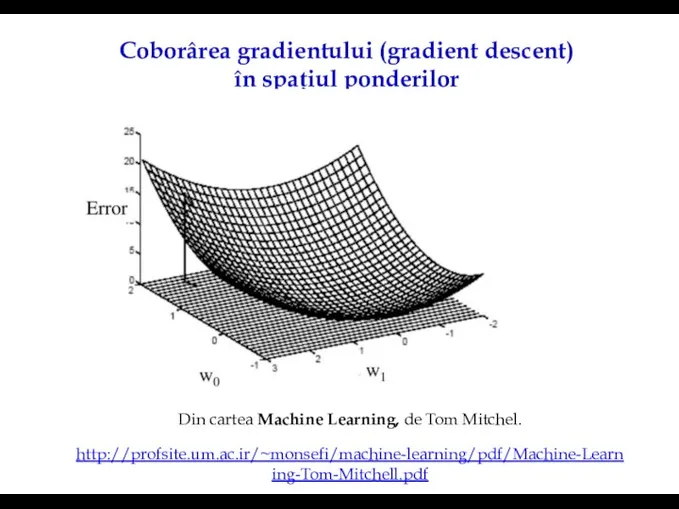

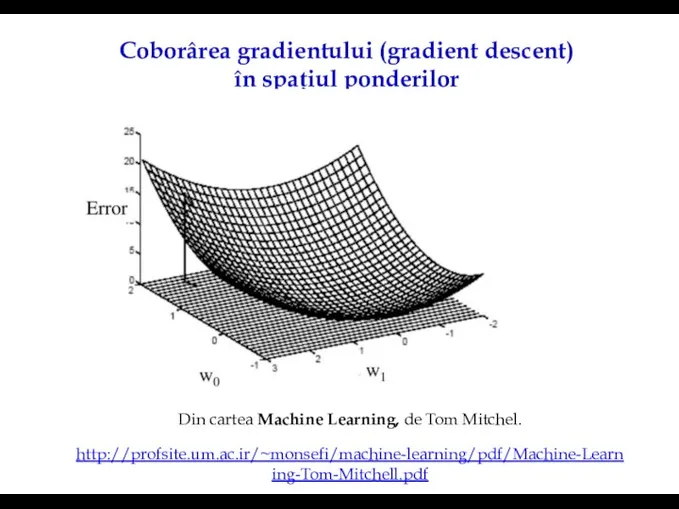

Слайд 29Coborârea gradientului (gradient descent) în spațiul ponderilor

Din cartea Machine Learning, de Tom

Mitchel.

http://profsite.um.ac.ir/~monsefi/machine-learning/pdf/Machine-Learning-Tom-Mitchell.pdf

Слайд 34De ce avem nevoie de mai multe straturi?

Incapacitatea arhitecturilor simple de a

rezolva o problemă sau o clasă de probleme

Uneori este sufiecient să mărim numărul de neuroni din rețea

fără de a schimba arhitectura

În alte situații este necesară modificarea arhitecturii rețelei

introducând unul sau mai multe straturi neurale noi

Проблемы развития киберспорта в регионах России

Проблемы развития киберспорта в регионах России Интернет как один из источников информационного обеспечения фундаментальных и прикладных научных исследований

Интернет как один из источников информационного обеспечения фундаментальных и прикладных научных исследований Компьютерная графика

Компьютерная графика Размещения, сочетания и перестановки. Практическое занятие

Размещения, сочетания и перестановки. Практическое занятие Сложные алгоритмические структуры. Ветвления и циклы

Сложные алгоритмические структуры. Ветвления и циклы Стандартизация структуры ИС

Стандартизация структуры ИС Игра Турнир смекалистых

Игра Турнир смекалистых Путь журналиста

Путь журналиста Записи в языке Паскаль

Записи в языке Паскаль RFID технология: Открытая библиотека

RFID технология: Открытая библиотека Фильтрация изображений

Фильтрация изображений Вывод и ввод данных

Вывод и ввод данных Безопасность школьников в сети Интернета

Безопасность школьников в сети Интернета Носители информации. Перфокарты

Носители информации. Перфокарты лаб работа 1 базы данных

лаб работа 1 базы данных с++ полная (1)

с++ полная (1) Настойка ISO для фотокамер NIKON

Настойка ISO для фотокамер NIKON Один день без интернета

Один день без интернета Персональный компьютер. Компьютер как универсальное устройство для работы с информацией. Информатика, 7 класс

Персональный компьютер. Компьютер как универсальное устройство для работы с информацией. Информатика, 7 класс Какие технологии самые современные?

Какие технологии самые современные? Косимуляция Matlab- PSIM

Косимуляция Matlab- PSIM Сноски. Работа с текстовым документом

Сноски. Работа с текстовым документом Сетевые войны

Сетевые войны Система управления базами данных моделирование и формализация. 9 класс

Система управления базами данных моделирование и формализация. 9 класс Документационное обеспечение управления и архивоведение

Документационное обеспечение управления и архивоведение Интернет-шахматы для самообразования

Интернет-шахматы для самообразования Практика интервью. Народная журналистика

Практика интервью. Народная журналистика 16-17_CSS Grid

16-17_CSS Grid