Содержание

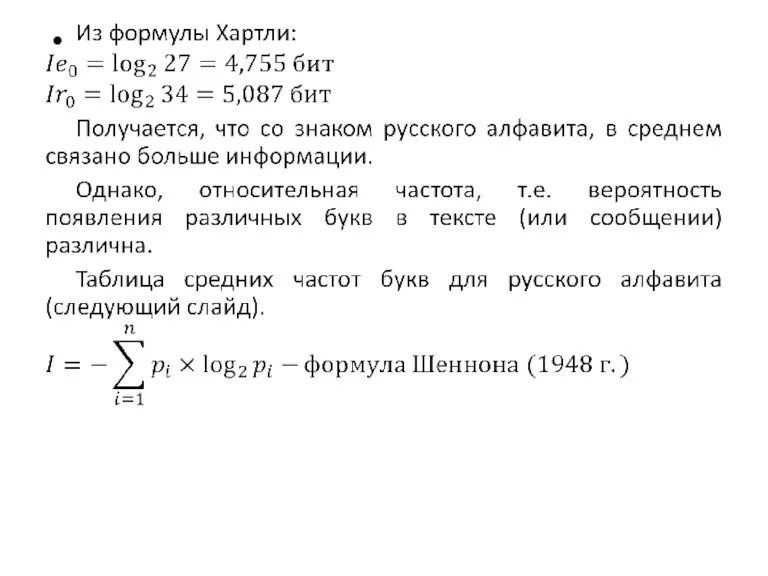

- 3. Таблица для средних частот букв русского алфавита

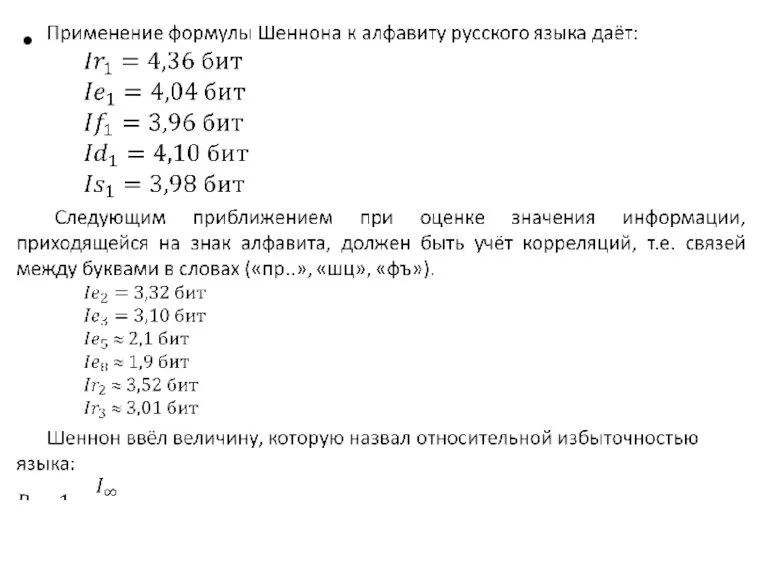

- 5. Сообщения, в которых вероятность появления каждого отдельного знака не меняется со временем, называют шенноновскими, а порождающий

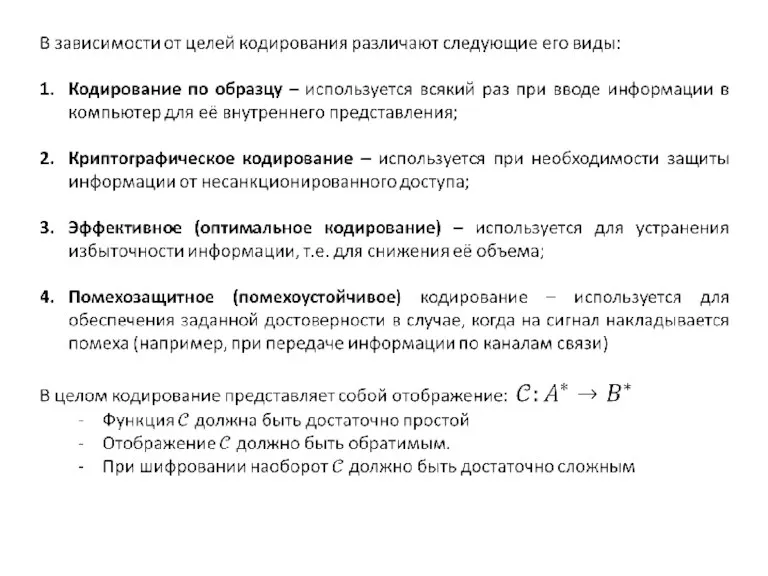

- 7. Понятие о кодировании. Коды. Кодирование символьной информации Теория кодирования информации является одним из разделов теоретической информатики.

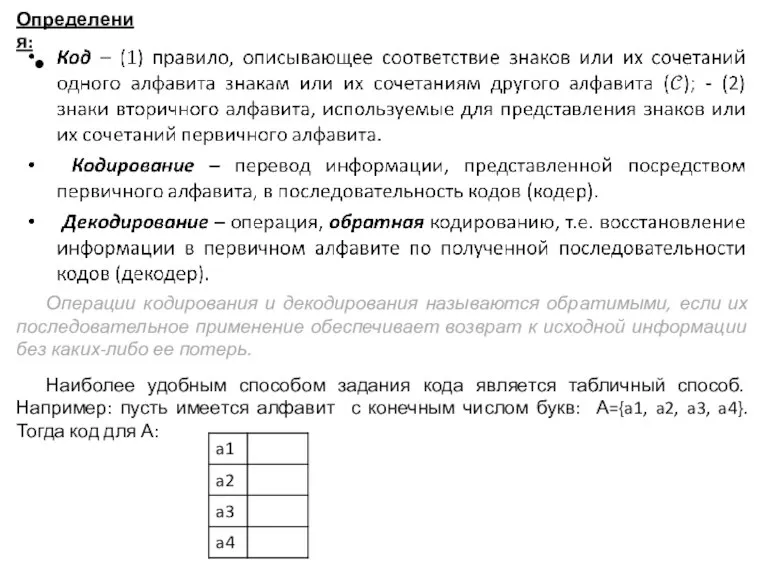

- 9. Операции кодирования и декодирования называются обратимыми, если их последовательное применение обеспечивает возврат к исходной информации без

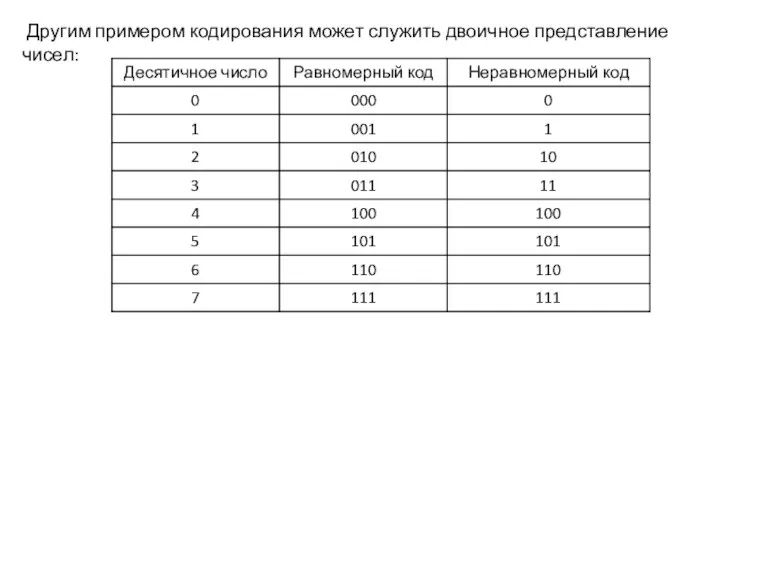

- 10. Другим примером кодирования может служить двоичное представление чисел:

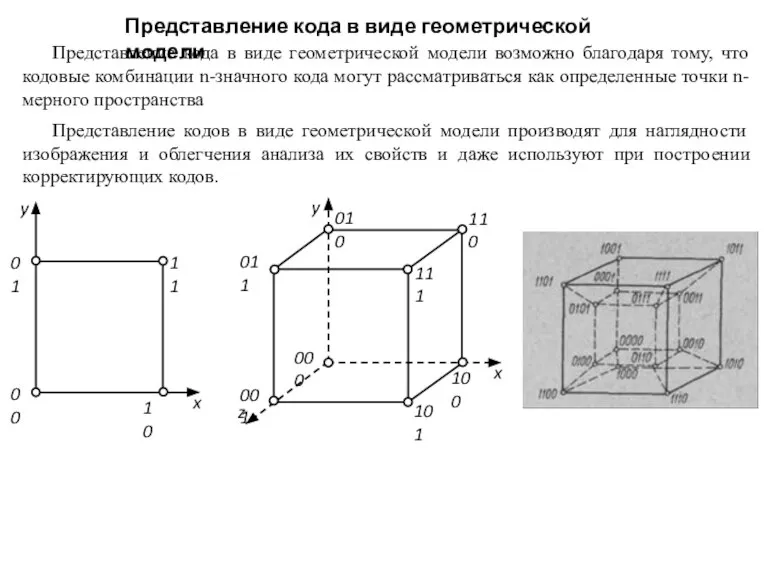

- 11. Представление кода в виде геометрической модели Представление кода в виде геометрической модели возможно благодаря тому, что

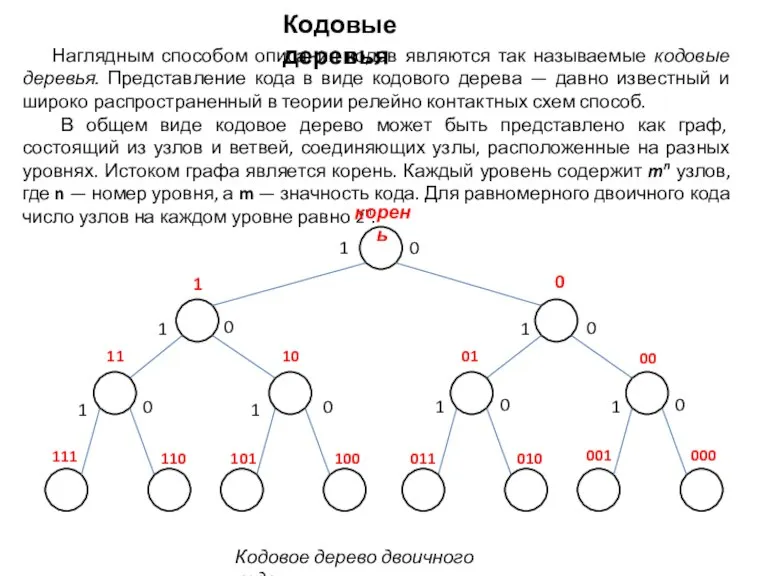

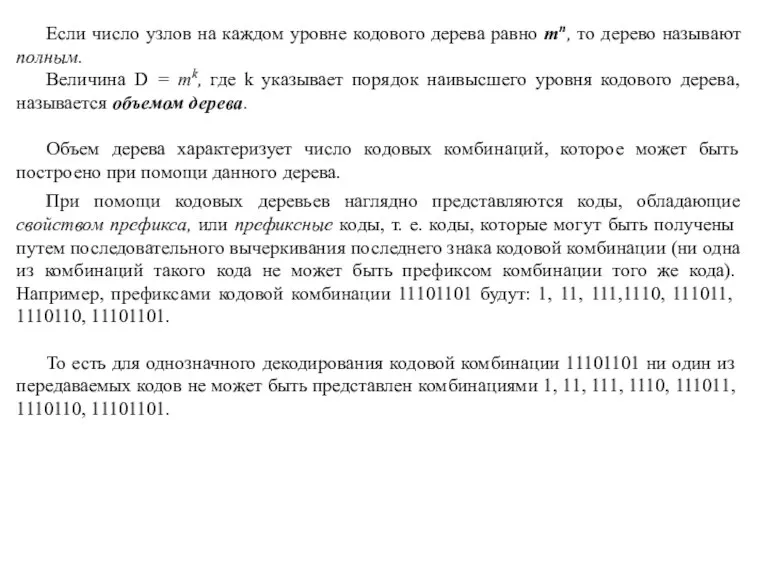

- 12. Наглядным способом описания кодов являются так называемые кодовые деревья. Представление кода в виде кодового дерева —

- 13. При помощи кодовых деревьев наглядно представляются коды, обладающие свойством префикса, или префиксные коды, т. е. коды,

- 14. Префиксом данной кодовой комбинации Аi является любая последовательность, составленная из ее начальной части, включая саму комбинацию

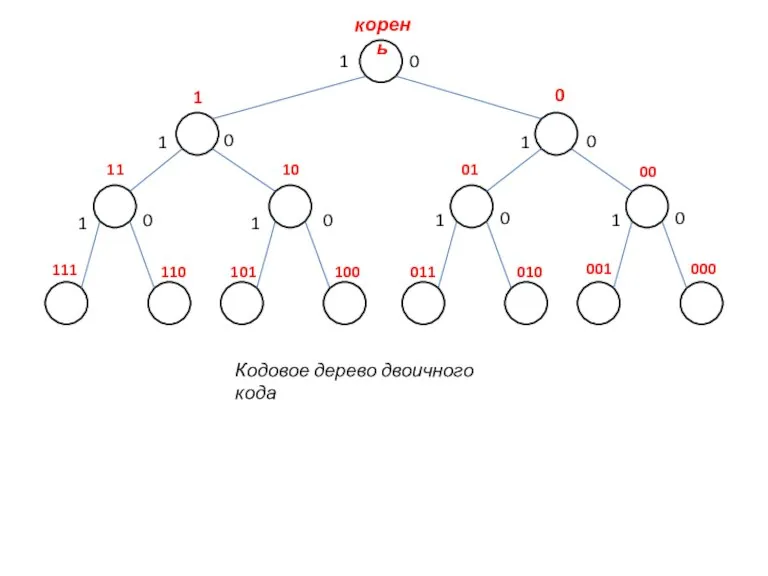

- 15. корень 1 0 1 0 1 1 1 1 1 1 0 0 0 0 0

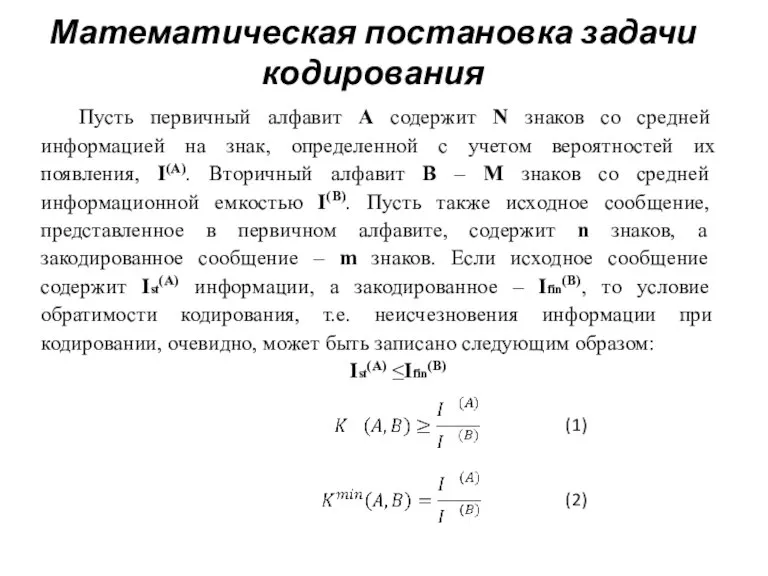

- 16. Математическая постановка задачи кодирования Пусть первичный алфавит A содержит N знаков со средней информацией на знак,

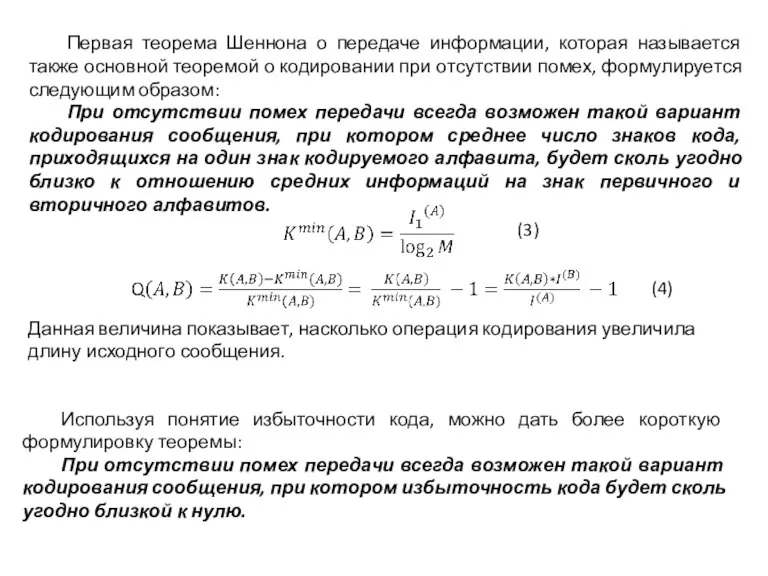

- 17. Первая теорема Шеннона о передаче информации, которая называется также основной теоремой о кодировании при отсутствии помех,

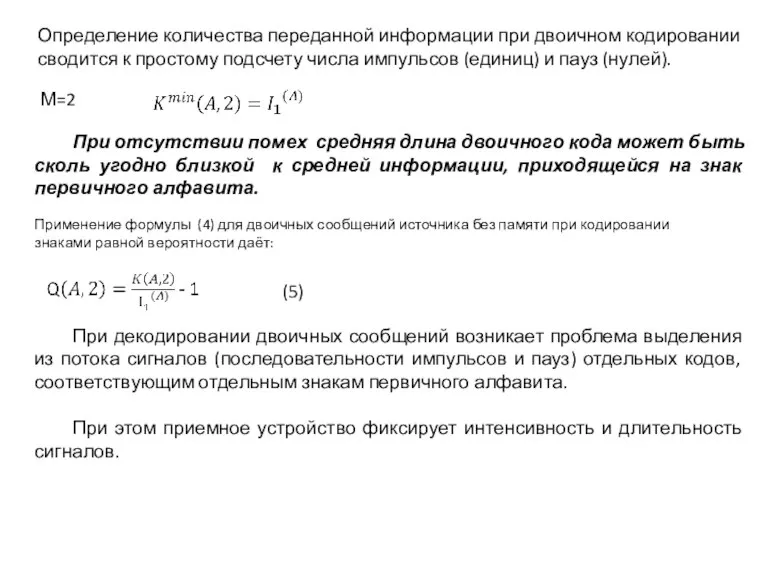

- 18. М=2 При отсутствии помех средняя длина двоичного кода может быть сколь угодно близкой к средней информации,

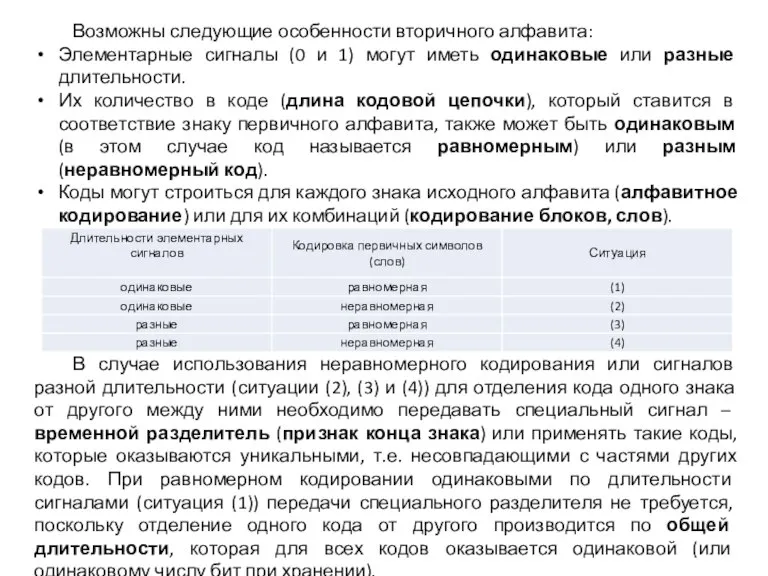

- 19. Возможны следующие особенности вторичного алфавита: Элементарные сигналы (0 и 1) могут иметь одинаковые или разные длительности.

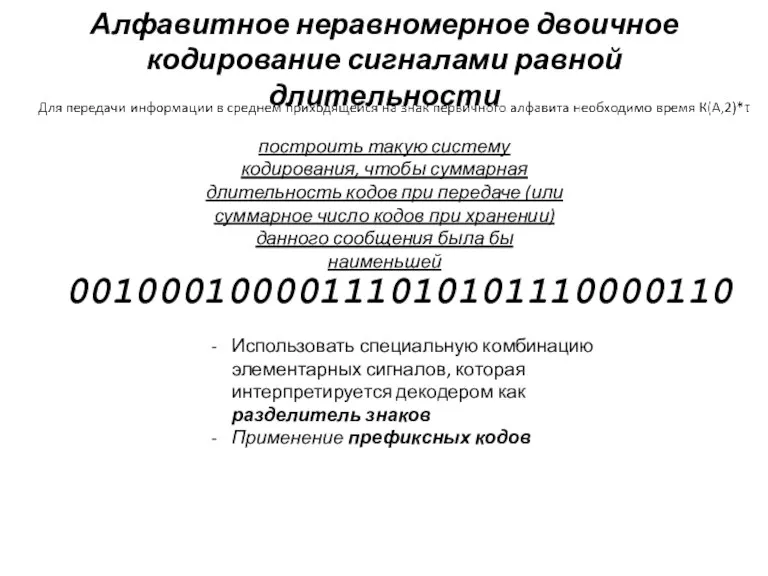

- 20. Алфавитное неравномерное двоичное кодирование сигналами равной длительности построить такую систему кодирования, чтобы суммарная длительность кодов при

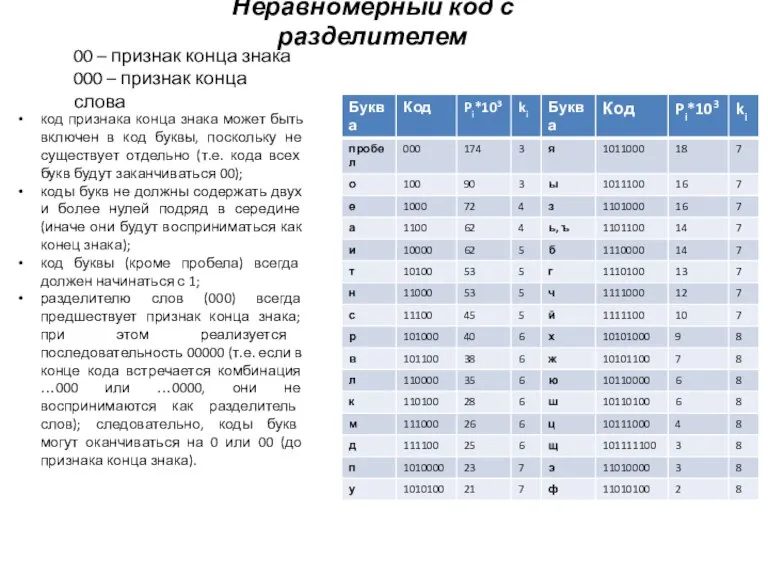

- 21. Неравномерный код с разделителем 00 – признак конца знака 000 – признак конца слова код признака

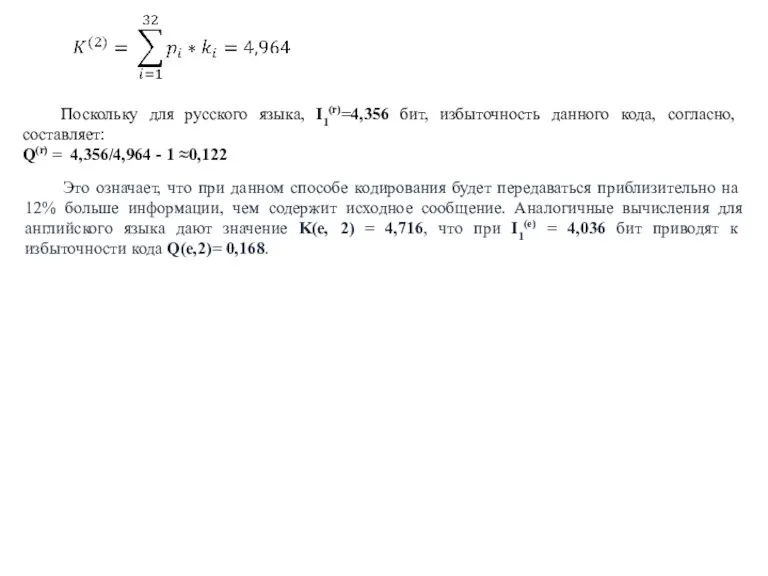

- 22. Поскольку для русского языка, I1(r)=4,356 бит, избыточность данного кода, согласно, составляет: Q(r) = 4,356/4,964 - 1

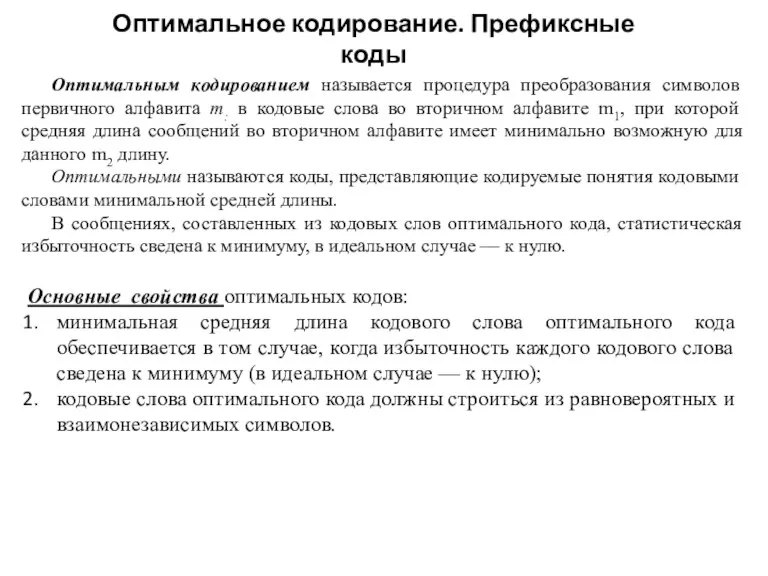

- 23. Оптимальное кодирование. Префиксные коды Оптимальным кодированием называется процедура преобразования символов первичного алфавита т: в кодовые слова

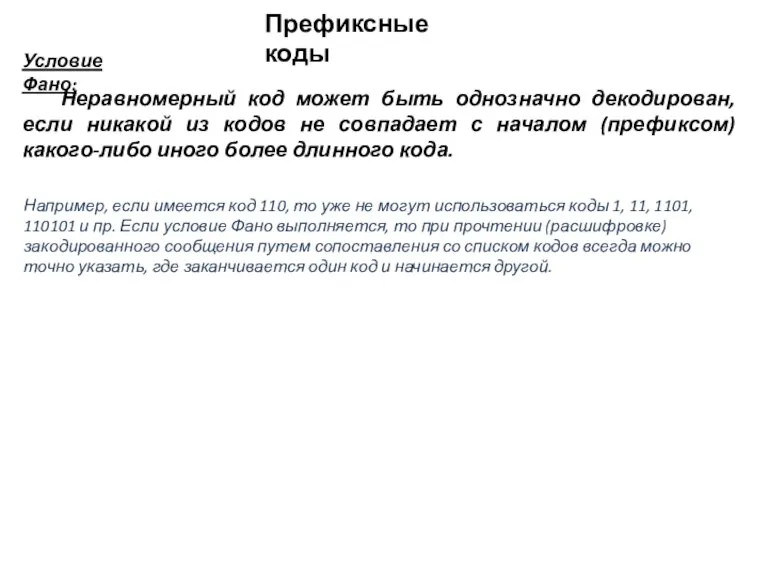

- 24. Неравномерный код может быть однозначно декодирован, если никакой из кодов не совпадает с началом (префиксом) какого-либо

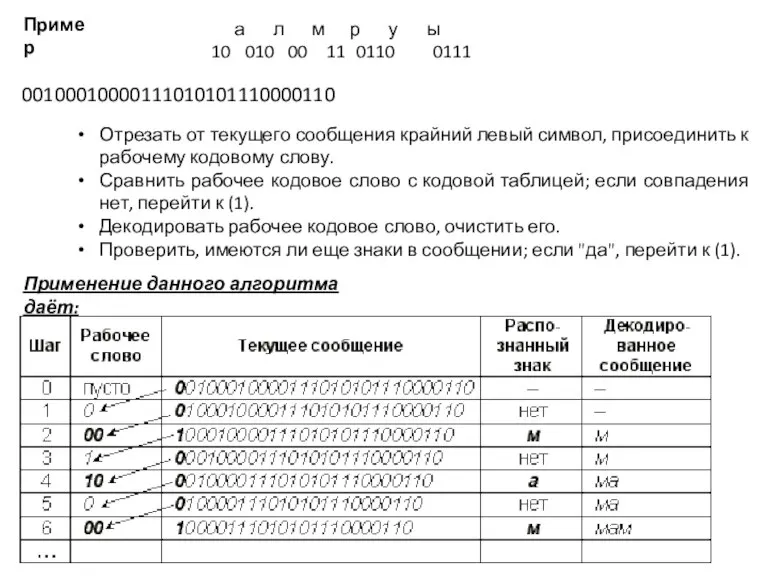

- 25. а л м р у ы 10 010 00 11 0110 0111 Пример 00100010000111010101110000110 Отрезать от

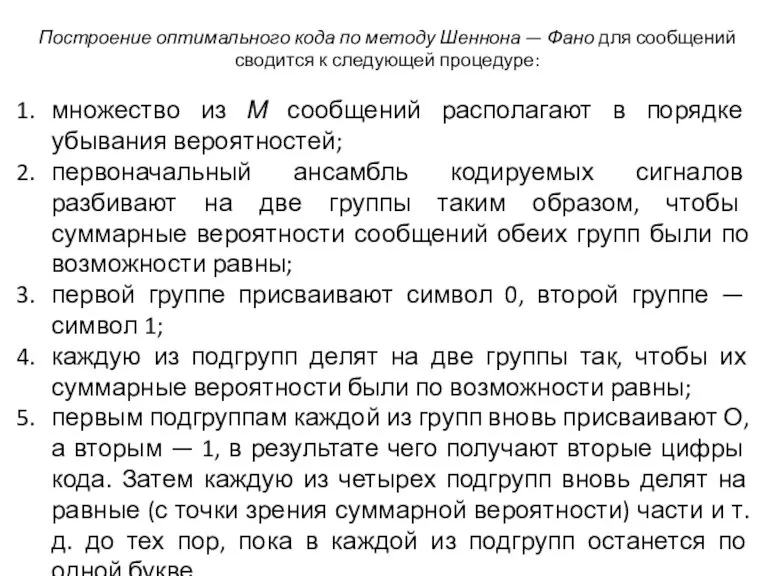

- 26. Построение оптимального кода по методу Шеннона — Фано для сообщений сводится к следующей процедуре: множество из

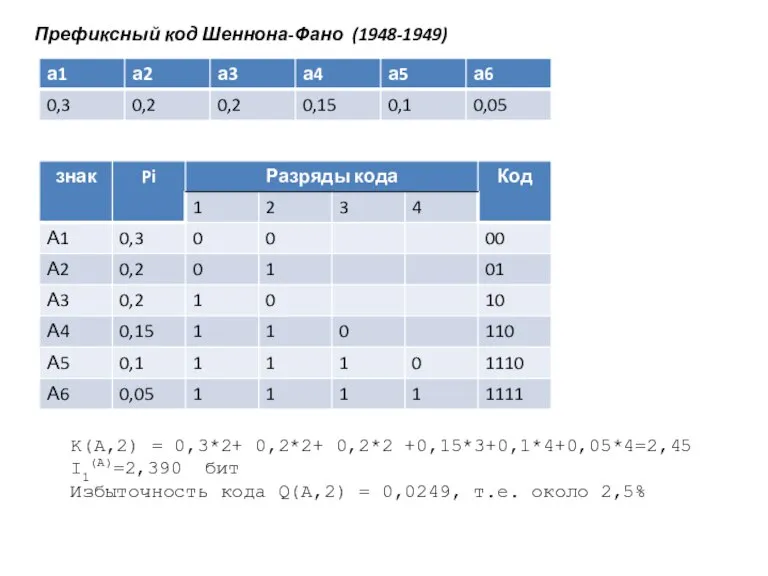

- 27. Префиксный код Шеннона-Фано (1948-1949) K(A,2) = 0,3*2+ 0,2*2+ 0,2*2 +0,15*3+0,1*4+0,05*4=2,45 I1(A)=2,390 бит Избыточность кода Q(A,2) =

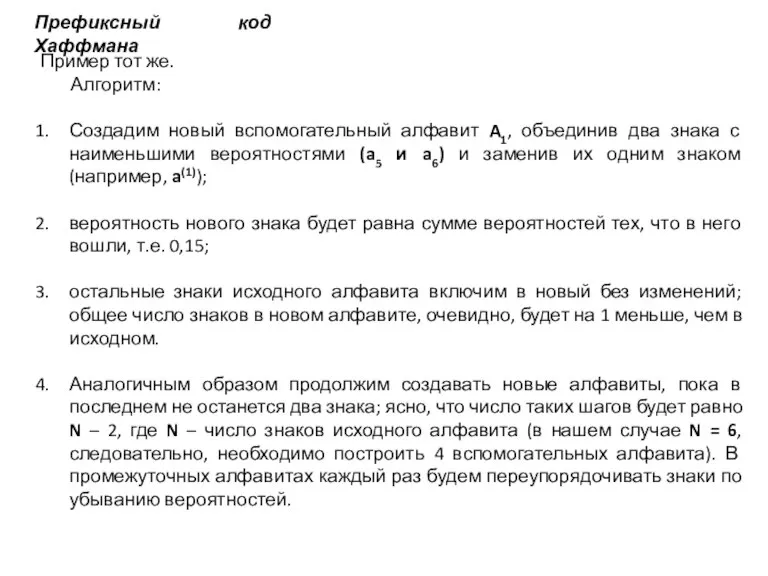

- 28. Префиксный код Хаффмана Пример тот же. Алгоритм: Создадим новый вспомогательный алфавит A1, объединив два знака с

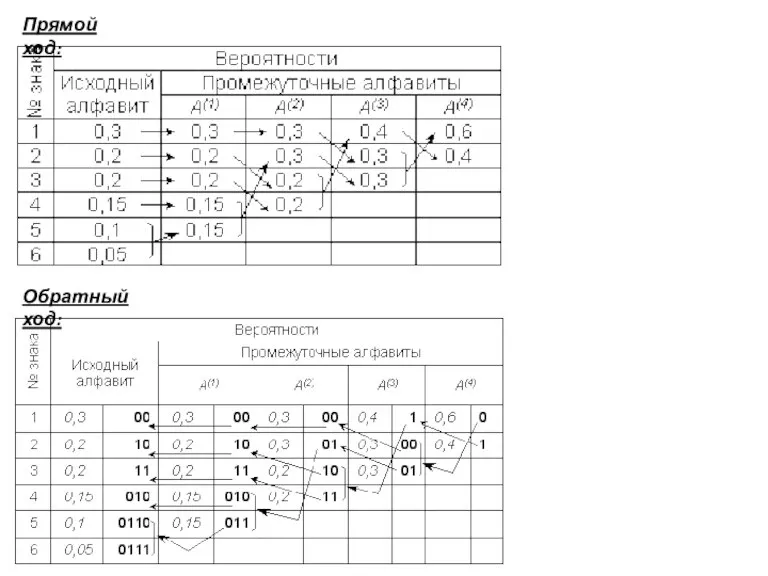

- 29. Прямой ход: Обратный ход:

- 31. Скачать презентацию

Шаблон презентации

Шаблон презентации Логические элементы

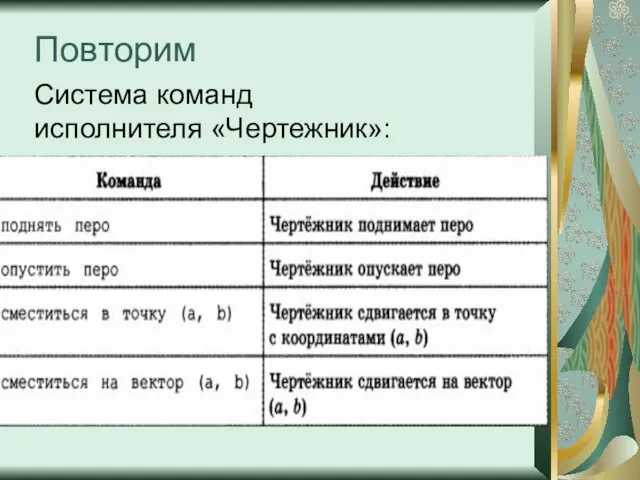

Логические элементы Система команд исполнителя Чертежник

Система команд исполнителя Чертежник Базовые типы и операторы

Базовые типы и операторы Правила оформления и публикации постов РДШ

Правила оформления и публикации постов РДШ Иконки контурные

Иконки контурные Цветовая модель RGB

Цветовая модель RGB Web – конструирование на HTML

Web – конструирование на HTML Цифровые технологии в дизайне

Цифровые технологии в дизайне Интерпретация религии в игре

Интерпретация религии в игре CSS технология. Каскадные таблицы стилей

CSS технология. Каскадные таблицы стилей Операционные системы

Операционные системы Анализ ресурсов academia.edu

Анализ ресурсов academia.edu Алгоритмы

Алгоритмы Презентация на тему Декодирование информации в компьютере

Презентация на тему Декодирование информации в компьютере  Опасность в интернете

Опасность в интернете Файловая система

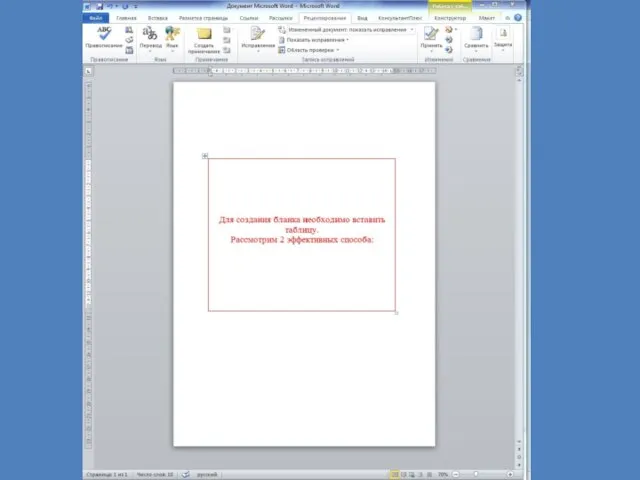

Файловая система Создание заявления и правильное его заполнение для ГУ МВД России

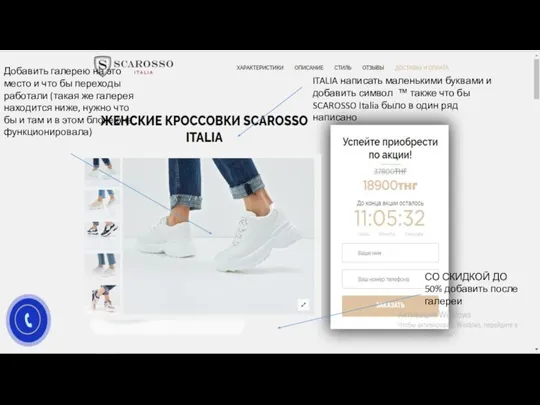

Создание заявления и правильное его заполнение для ГУ МВД России ТЗ по сайту на фриланс

ТЗ по сайту на фриланс 0821dd87747943779db6c0c7e5802e37

0821dd87747943779db6c0c7e5802e37 Методика решения задач по теме Информационный объем текста

Методика решения задач по теме Информационный объем текста Информационные технологии вокруг нас, в мире и в Беларуси

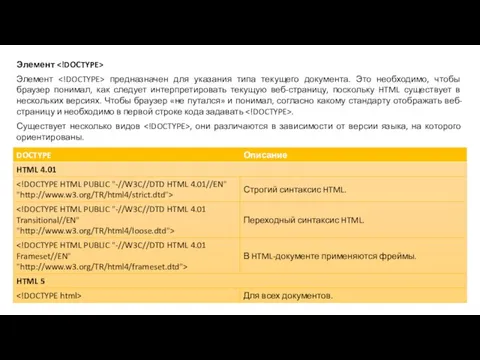

Информационные технологии вокруг нас, в мире и в Беларуси Элемент <!DOCTYPE>

Элемент <!DOCTYPE> Понятие и система средств массовой коммуникации

Понятие и система средств массовой коммуникации Программирование на языке Python

Программирование на языке Python Ассистент on line проектов

Ассистент on line проектов CSS. Урок 12

CSS. Урок 12 Эволюция веб-технологий

Эволюция веб-технологий