Слайд 21. Понятие информации. Свойства информации

Федеральный закон от 27 июля 2006 года №149-ФЗ «ОБ ИНФОРМАЦИИ, ИНФОРМАЦИОННЫХ

ТЕХНОЛОГИЯХ И О ЗАЩИТЕ ИНФОРМАЦИИ»:

Информация - сведения (сообщения, данные) независимо от формы их представления.

Слайд 3Свойства информации

Качество информации можно определить как совокупность свойств, обуславливающих возможность ее использования

для удовлетворения определенных потребностей.

1. Адекватность информации - это степень соответствия реальному объективному состоянию дела (устаревшая, неполная информация). Неадекватная информация может образовываться при создании новой информации на основе неполных или недостоверных данных.

2. Полнота информации - во многом характеризует качество информации и определяет достаточность данных для принятия решений или для созданиях новых данных на базе уже имеющихся.

Слайд 4 3. Актуальность информации - способность информации соответствовать нуждам потребителей в нужный момент

времени.

4. Доступность информации - мера возможности получить ту ли иную информацию.

5. Защищенность информации - свойство, характеризующее невозможность несанкционированного использования или изменения.

Особо важным является первое свойство, так как от него зависит правильность отображения и понимания информации человеком. При этом полной адекватности в природе не существует по причине того, что всегда присутствует некая степень неопределенности, которую можно вычислить.

Слайд 5Виды информации

По времени возникновения:

априорная - известна потребителю заранее, до получения сигнала;

апостериорная -

становится известной потребителю после получения сигнала.

Так, получаемая сейчас студентом информация является априорной, если он освоил азы информатики в школе, в противном случае - апостериорной.

Слайд 6 По стабильности:

переменная - отражает фактические характеристики источника информации, может меняться;

постоянная - неизменная

и многократно используемая в течение длительного периода времени. Строго говоря, и эта информация может меняться, но с гораздо меньшей частотой, которой можно пренебречь.

Слайд 7 По способу использования:

вспомогательная - необязательные данные;

закрытая - ее использование возможно с согласия

определенных физических или юридических лиц;

избыточная - дублирует данные;

- коммерческая - является объектом купли-продажи.

Слайд 82. Носители информации

Классификация ВЗУ по типу носителя информации

Слайд 10Флэш-накопитель (картридер) и USB-флэш-память (так называемые USB-«ключи»).

Слайд 113. Представление чисел в различных системах счисления

Позиционные системы счисления.

Непозиционные системы счисления.

Представление чисел

в различных системах счисления.

Перевод целых чисел из одной позиционной системы счисления в другую.

Перевод дробных чисел из одной позиционной системы счисления в другую.

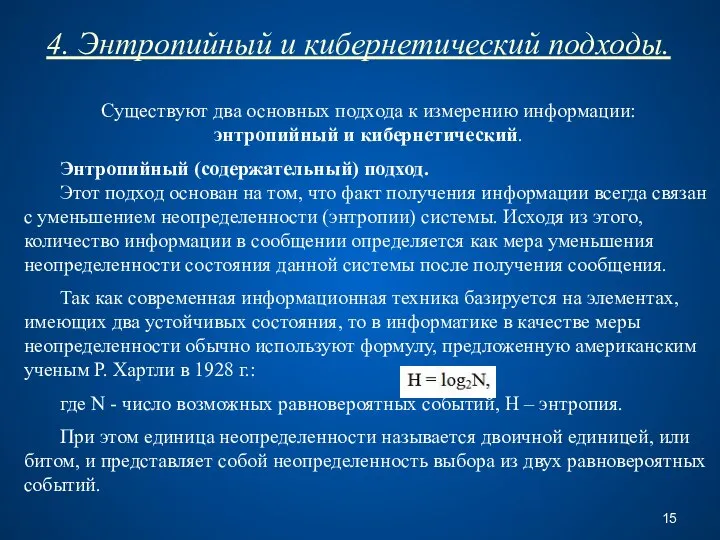

Слайд 154. Энтропийный и кибернетический подходы.

Существуют два основных подхода к измерению информации:

энтропийный

и кибернетический.

Энтропийный (содержательный) подход.

Этот подход основан на том, что факт получения информации всегда связан с уменьшением неопределенности (энтропии) системы. Исходя из этого, количество информации в сообщении определяется как мера уменьшения неопределенности состояния данной системы после получения сообщения.

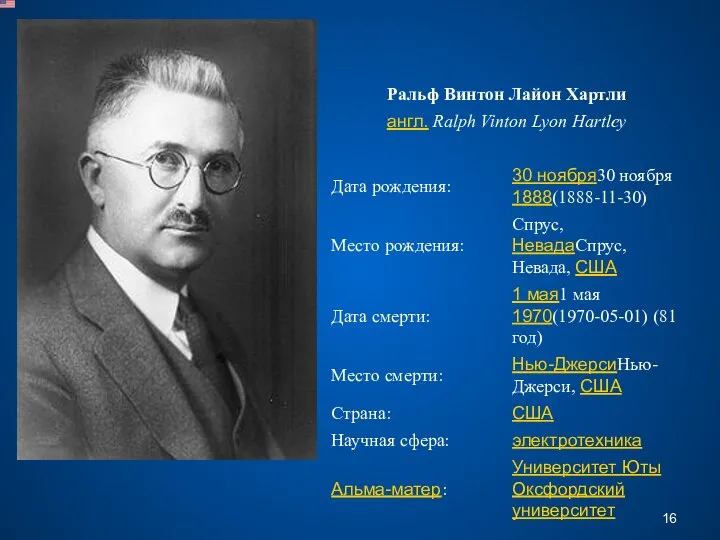

Так как современная информационная техника базируется на элементах, имеющих два устойчивых состояния, то в информатике в качестве меры неопределенности обычно используют формулу, предложенную американским ученым Р. Хартли в 1928 г.:

где N - число возможных равновероятных событий, Н – энтропия.

При этом единица неопределенности называется двоичной единицей, или битом, и представляет собой неопределенность выбора из двух равновероятных событий.

Слайд 17Кибернетический подход

(символьный, алфавитный, объемный подход)

Основывается на подсчете числа символов в сообщении,

то есть связан с длиной сообщения и не учитывает содержание. Способ чувствителен к форме представления (записи) сообщения.

Например, запись числа 21 «двадцать один», 21, 11001, XXI.

При использовании объемного подхода все три сообщения имеют разный объем информации.

Единица измерения - байт. Байт - это один символ.

Все символы кодируются в компьютере в двоичном коде при помощи 0 и 1. Алфавит составляет 256 символов, кодирующихся при помощи 8 двоичных разрядов.

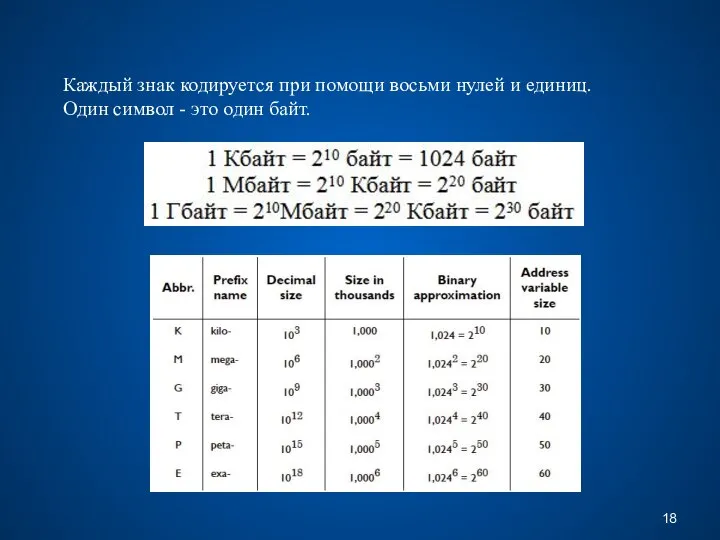

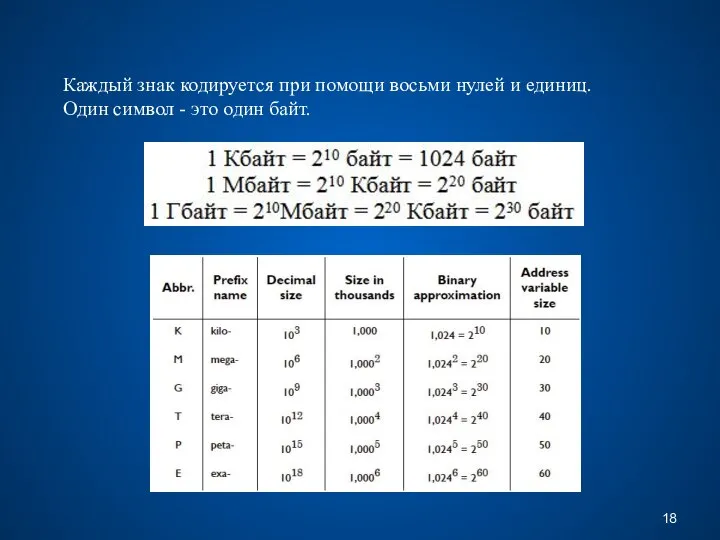

Слайд 18 Каждый знак кодируется при помощи восьми нулей и единиц.

Один символ -

это один байт.

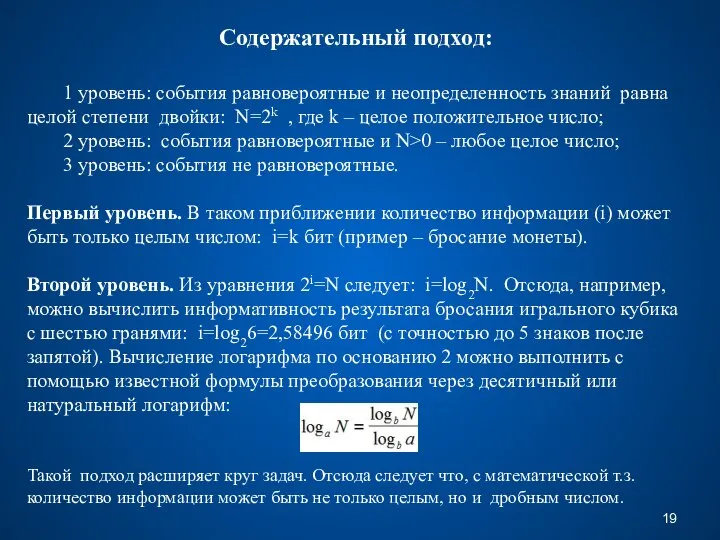

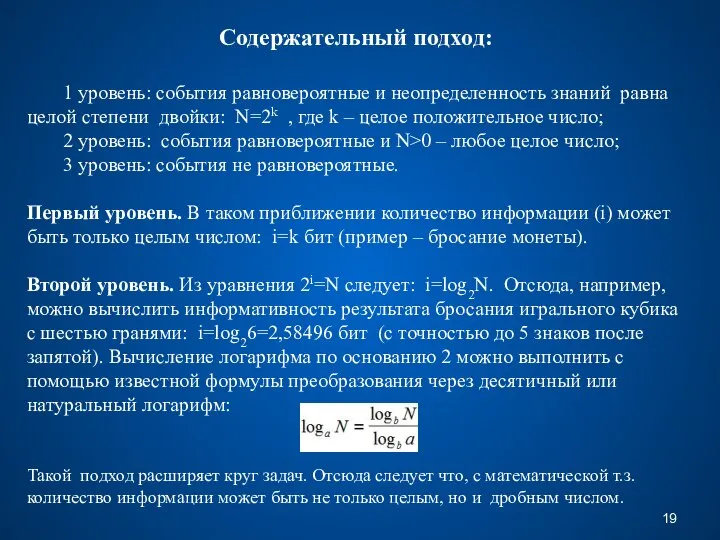

Слайд 19Содержательный подход:

1 уровень: события равновероятные и неопределенность знаний равна целой степени двойки:

N=2k , где k – целое положительное число;

2 уровень: события равновероятные и N>0 – любое целое число;

3 уровень: события не равновероятные.

Первый уровень. В таком приближении количество информации (i) может быть только целым числом: i=k бит (пример – бросание монеты).

Второй уровень. Из уравнения 2i=N следует: i=log2N. Отсюда, например, можно вычислить информативность результата бросания игрального кубика с шестью гранями: i=log26=2,58496 бит (с точностью до 5 знаков после запятой). Вычисление логарифма по основанию 2 можно выполнить с помощью известной формулы преобразования через десятичный или натуральный логарифм:

Такой подход расширяет круг задач. Отсюда следует что, с математической т.з. количество информации может быть не только целым, но и дробным числом.

Презентация на тему Работа с текстовой информацией в EXCEL

Презентация на тему Работа с текстовой информацией в EXCEL  Информационные технологии

Информационные технологии Лекция 29. CorelDRAW Инструменты группы. Изменение формы

Лекция 29. CorelDRAW Инструменты группы. Изменение формы Исполнитель Калькулятор

Исполнитель Калькулятор Создание 3d модели на основе операций твердотельного моделирования

Создание 3d модели на основе операций твердотельного моделирования Системное программное обеспечение

Системное программное обеспечение Популярные компьютерные игры

Популярные компьютерные игры Разработка автоматизированной информационной системы учета материальных и иных активов в ЦЦОД IT-Куб г. Княгинино

Разработка автоматизированной информационной системы учета материальных и иных активов в ЦЦОД IT-Куб г. Княгинино Концепция Virtual logistics

Концепция Virtual logistics Человек и информация

Человек и информация Буккроссинг - новое увлечение современных людей

Буккроссинг - новое увлечение современных людей Основы алгоритмизации инженерных задач

Основы алгоритмизации инженерных задач Проектирование пользовательского интерфейса графической оболочки сайта учебного учреждения АНПОО РОСТ

Проектирование пользовательского интерфейса графической оболочки сайта учебного учреждения АНПОО РОСТ Интернет-мошенничество

Интернет-мошенничество Электронные издания в сети Интернет. Виды по целевому назначению

Электронные издания в сети Интернет. Виды по целевому назначению Технические средства телекоммуникаций

Технические средства телекоммуникаций Техническое задание на проектирование персонажа

Техническое задание на проектирование персонажа Информация и информационные процессы. Тест

Информация и информационные процессы. Тест Программное обеспечение для обслуживания жестких дисков компьютера

Программное обеспечение для обслуживания жестких дисков компьютера Презентация А.Пуоджюс

Презентация А.Пуоджюс Джедаисты. Цели

Джедаисты. Цели Информатика и информационно-коммуникационные технологии

Информатика и информационно-коммуникационные технологии Введение в базовый синтаксис

Введение в базовый синтаксис Структуры данных

Структуры данных Инфографика

Инфографика Продвижение информационной составляющей официального сайта

Продвижение информационной составляющей официального сайта Компьютер, его системы и процессы

Компьютер, его системы и процессы Автоматизированные информационные технологии

Автоматизированные информационные технологии