Слайд 2Отчетность

Экзамен

Лекций – 18 ч (9 шт)

Практика – 34 ч – ФОМ

-180510

18 ч – ФОМ- 181001

Слайд 3Темы

Введение. Основные понятия

Статистические методы сжатия данных

Словарные методы

Вейвлетные методы сжатия

Сжатие изображений

Сжатие видео

Сжатие аудио

Практика

– OpenCV

Слайд 4Введение

Проблема коммуникации

Основные понятия

Слайд 5Проблема коммуникации

«Главное свойство системы связи заключается в том, что она должна точно

или приближенно воспроизвести в определенной точке пространства и времени некоторое сообщение, выбранное в другой точке. Обычно, это сообщение имеет какой-то смысл, однако это совершенно неважно для решения поставленной и инженерной задачи. Самое главное заключается в том, что посылаемое сообщение выбирается из некоторого семейства возможных сообщений»

Клод Шеннон, 1948 г.

Слайд 6Последствия сформулированной проблемы

Возникла теория информации

Все коммуникации должны быть цифровыми, т.е. передача данных

должна идти как передача двоичных цифр

Слайд 7Основные понятия

Система связи

Шум

Кодирование источника

Слайд 8Кодирование источника

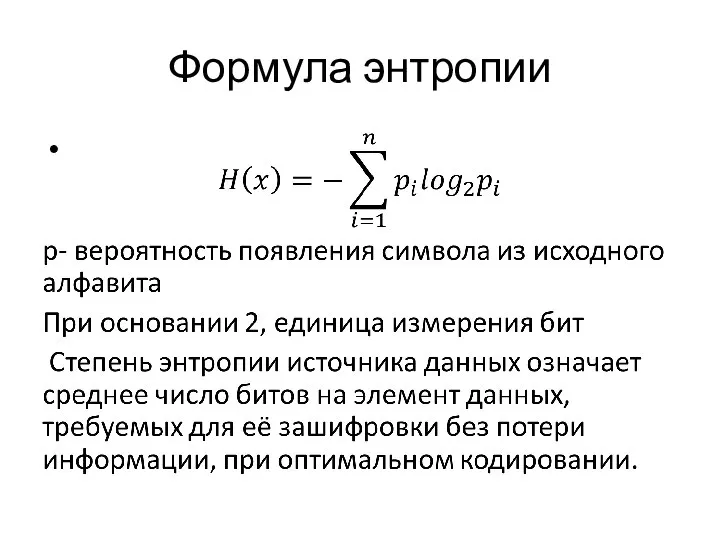

Мера компактности представления данных – информационная энтропия

Информационная энтропия - мера непредсказуемости

появления какого-либо символа первичного алфавита.

Слайд 9Определение Информационной энтропии по Шеннону

Клод Шеннон предположил, что прирост информации равен утраченной

неопределённости, и задал требования к её измерению:

мера должна быть непрерывной; то есть изменение значения величины вероятности на малую величину должно вызывать малое результирующее изменение функции;

в случае, когда все варианты (буквы в приведённом примере) равновероятны, увеличение количества вариантов (букв) должно всегда увеличивать значение функции;

должна быть возможность сделать выбор (в нашем примере букв) в два шага, в которых значение функции конечного результата должно являться суммой функций промежуточных результатов.

Слайд 12Энтропийное сжатие

(сжатие без потерь)

Энтропия сжатых данных совпадает с энтропией исходного источника.

При этом предполагается, что по сжатым данным можно полностью восстановить исходную информацию.

Слайд 13Избыточность данных

Текст

Код ASCII является избыточным, т.к. вероятности появления букв в тексте разная

Если

зашифровать часто встречающиеся буквы коротким кодом, а редкие буквы – длинным, то уберем избыточность

Изображения

Есть основные цвета и дополнительные, а кодируются одинаково – избыточность

Соседние пиксели обычно имеют близкие цвета - избыточность

Слайд 14Основа сжатия данных

Определить избыточность для источника данных

Подобрать алгоритм сжатия, убирающий именно эту

избыточность

Слайд 15Термины

Компрессор или кодер -программа, которая сжимает «сырой» исходный файл и создает на

выходе файл со сжатыми данными, в которых мало избыточности.

Декомпрессор или декодер работает в обратном направлении. Термин кодек иногда используется для объединения кодера и декодера.

Слайд 16Термины

Симметричное сжатие – это когда и кодер, и декодер используют один и

тот же базовый алгоритм, но используют его в противоположных направлениях.

Слайд 18Тест

Что предложил Шеннон для решения проблемы передачи информации через зашумленный канал?

Белый шум

не имеет избыточности. Можно ли его сжать?

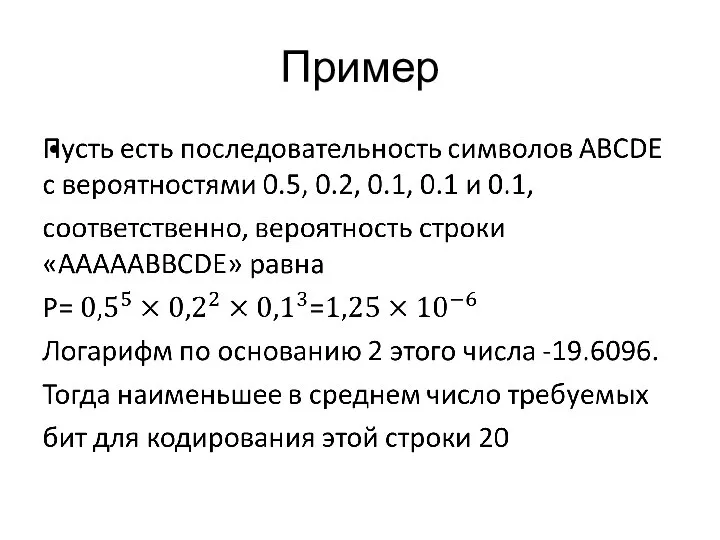

Исходный алфавит представляет 4 символа TGRD c вероятностями появления 0,80; 0,10; 0,05; 0,05. Рассчитайте минимальное количество бит, необходимое для кодирования следующей строки TGTGTTTRDD

Технология DeepHD

Технология DeepHD Факторный анализ

Факторный анализ Цифровые образовательные ресурсы в школе № 35 г. Оренбурга на примере сервисаЯКласс

Цифровые образовательные ресурсы в школе № 35 г. Оренбурга на примере сервисаЯКласс Презентация на тему ТВОИ УСПЕХИ

Презентация на тему ТВОИ УСПЕХИ  С новым годом. Отчет-поздравление группы Точка доступа в цифровое пространство

С новым годом. Отчет-поздравление группы Точка доступа в цифровое пространство Логические основы компьютеров

Логические основы компьютеров Вставка в документ художественного текста и рисунков

Вставка в документ художественного текста и рисунков Логические операции. Урок 3

Логические операции. Урок 3 Проект Dengerouscraft,1.1.X

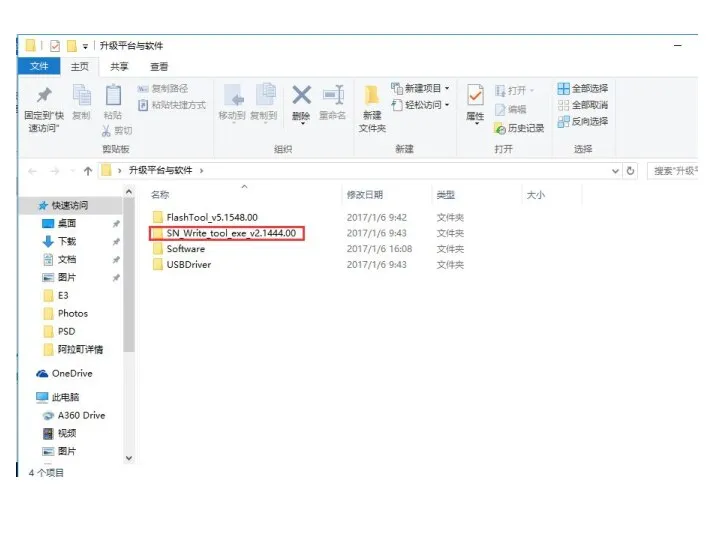

Проект Dengerouscraft,1.1.X IMEI Write Operational guidance

IMEI Write Operational guidance Презентация на тему Язык общения ICQ, чата, форума

Презентация на тему Язык общения ICQ, чата, форума  Планета алгоритмика. Клад

Планета алгоритмика. Клад Рекурсивные алгоритмы. ЕГЭ-11

Рекурсивные алгоритмы. ЕГЭ-11 Рунет: жизнь на яркой стороне. Виртуальный рейд по детским сайтам

Рунет: жизнь на яркой стороне. Виртуальный рейд по детским сайтам Графическая информация

Графическая информация Презентация каналов РЕН ТВ и Discovery Channel

Презентация каналов РЕН ТВ и Discovery Channel Обработка информации с помощью программ. Шаблон

Обработка информации с помощью программ. Шаблон Прямое и стилевое форматирование текста. Обработка текстовой информации

Прямое и стилевое форматирование текста. Обработка текстовой информации Основы алгоритмизации и программирования

Основы алгоритмизации и программирования Безопасность личного пространства (соцсети)

Безопасность личного пространства (соцсети) Программно-аппаратная защита информации. Лекция 5

Программно-аппаратная защита информации. Лекция 5 Двоичное кодирование текста. ОГЭ

Двоичное кодирование текста. ОГЭ Анализ ресурсов academia.edu

Анализ ресурсов academia.edu Возможности электронных таблиц

Возможности электронных таблиц Language-Integrated Query (LINQ)

Language-Integrated Query (LINQ) Текстовые данные. Контрольная работа № 2. 3 класс

Текстовые данные. Контрольная работа № 2. 3 класс Продвижение социального проекта библиотеки

Продвижение социального проекта библиотеки Моделирование в среде OO Impress

Моделирование в среде OO Impress