Содержание

- 2. СЖАТИЕ Сжатие данных Кодирование по алгоритму Хаффмана Межсимвольная зависимость Избыточность в английском языке Кодирование Лемпеля –

- 3. Сжатие данных (data compression) – процедура уменьшения их объёма с сохранением (полным или частичным) их целостности.

- 5. Способы решения (устранения избыточности): 1. Замена часто встречающихся данных короткими кодовыми словами, а редких – длинными

- 6. Сжатие данных, не обладающих свойством избыточности (например, случайный сигнал или белый шум, зашифрованные сообщения), принципиально невозможно

- 7. Все методы сжатия данных делятся на два основных класса: Сжатие без потерь (полное восстановление исходных данных)

- 8. два способа сжатия текста (сжатие без потерь): Кодирование Хаффмана (энтропийное кодирование) Кодирование Лемпеля-Зива (LZ77)

- 9. Алгоритм Хаффмана – это один из первых методов, в основе которого лежит энтропийное кодирование (кодирование источника).

- 11. АЛГОРИТМ ХАФФМАНА Алгоритм состоит из двух этапов: 1. Сначала символы источника сокращаются путем последовательного образования сложных

- 12. Рассмотрим источник из пяти символов с заданными вероятностями. ПРИМЕР 1

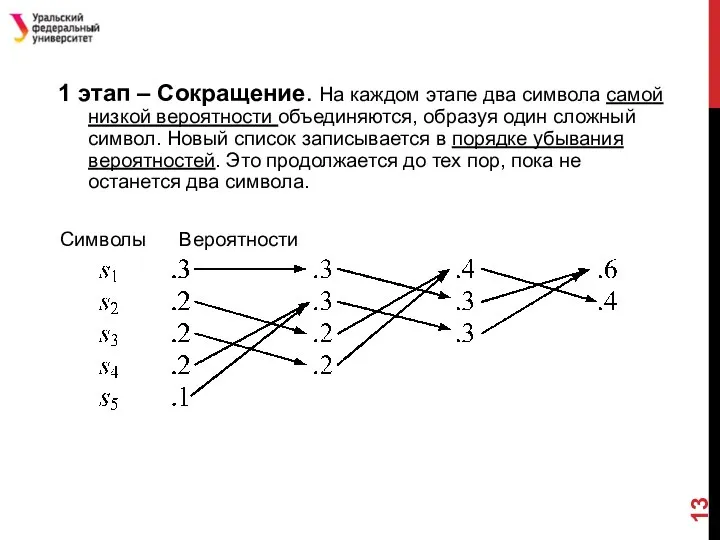

- 13. 1 этап – Сокращение. На каждом этапе два символа самой низкой вероятности объединяются, образуя один сложный

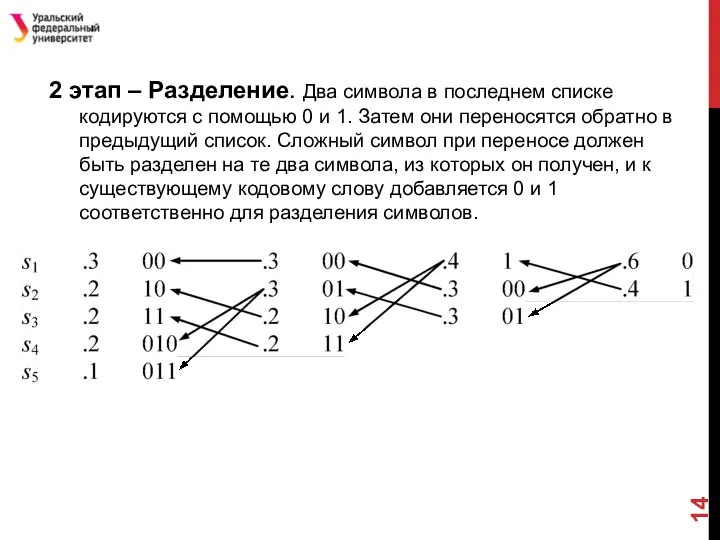

- 14. 2 этап – Разделение. Два символа в последнем списке кодируются с помощью 0 и 1. Затем

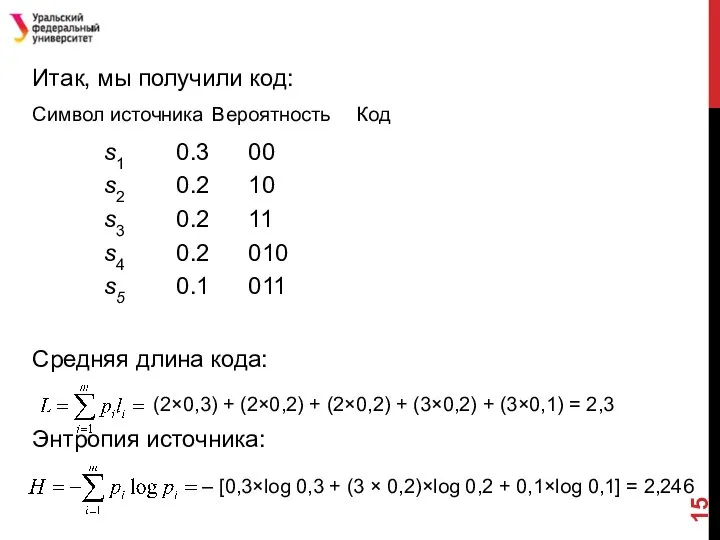

- 15. Итак, мы получили код: Символ источника Вероятность Код s1 0.3 00 s2 0.2 10 s3 0.2

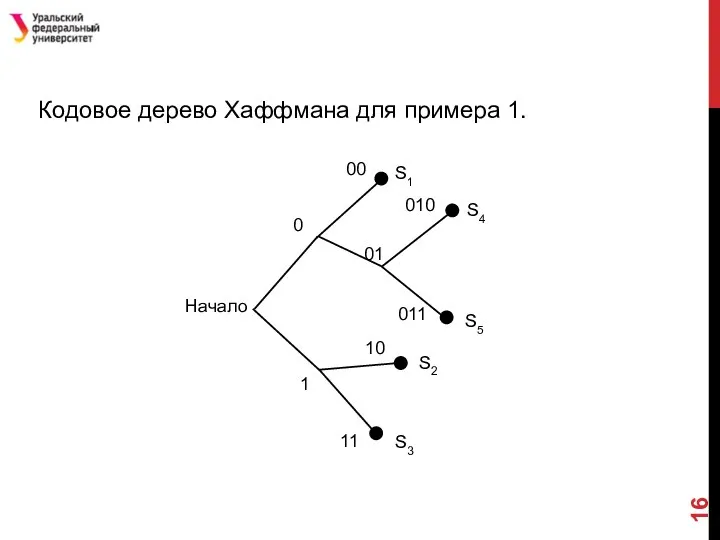

- 16. Кодовое дерево Хаффмана для примера 1.

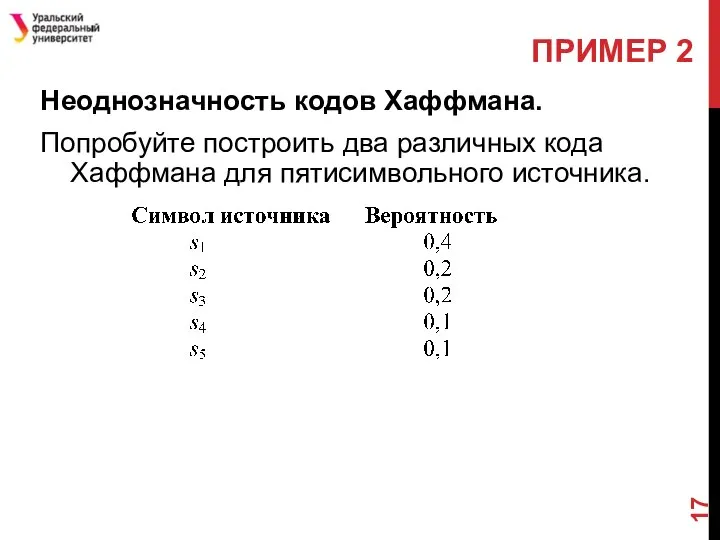

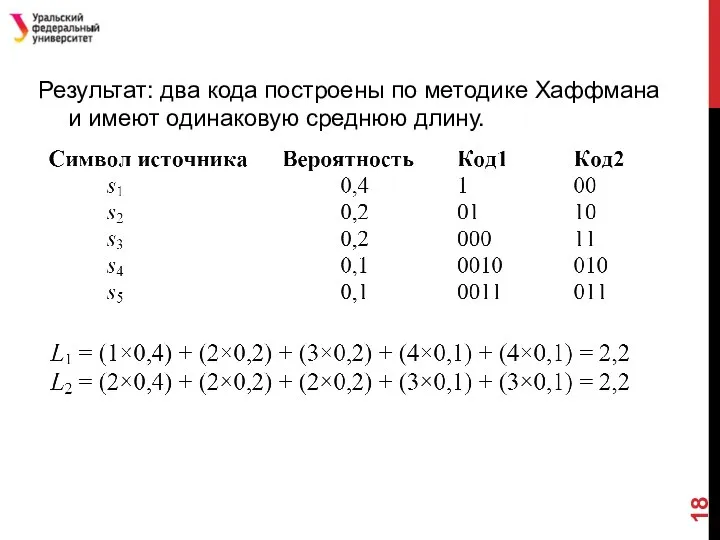

- 17. Неоднозначность кодов Хаффмана. Попробуйте построить два различных кода Хаффмана для пятисимвольного источника. ПРИМЕР 2

- 18. Результат: два кода построены по методике Хаффмана и имеют одинаковую среднюю длину.

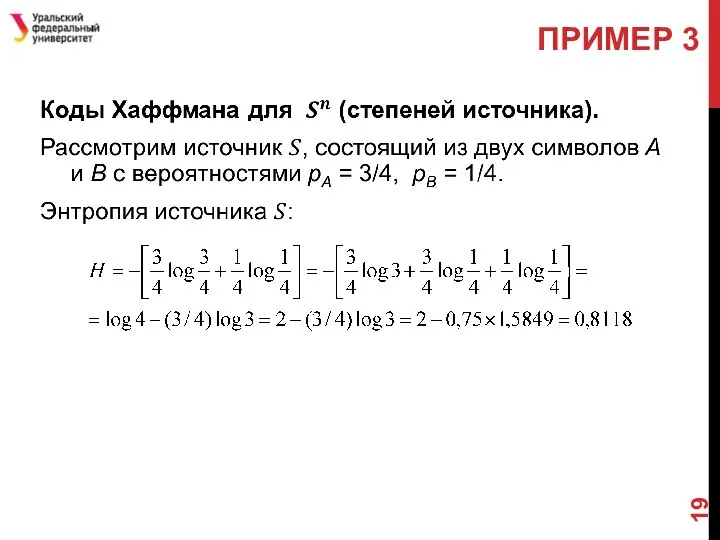

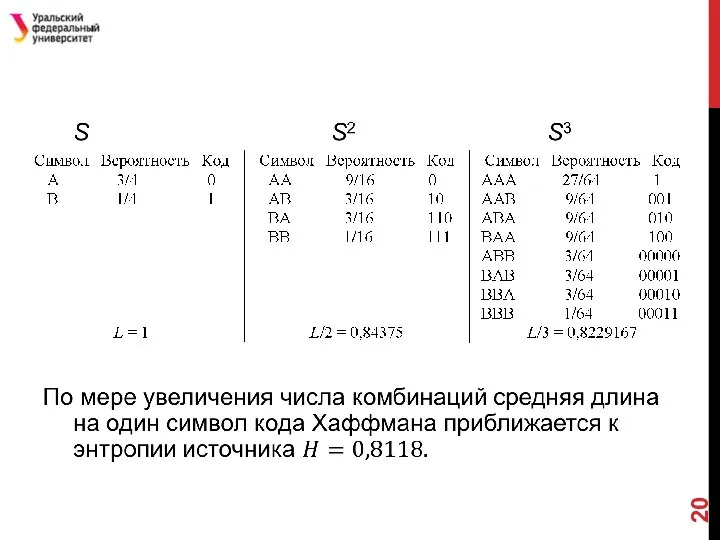

- 19. ПРИМЕР 3

- 21. Межсимвольная зависимость. Следующие друг за другом символы от источника не всегда являются независимыми. Наоборот, текущие вероятности

- 22. ВЕРОЯТНОСТИ В АНГЛИЙСКОМ ЯЗЫКЕ

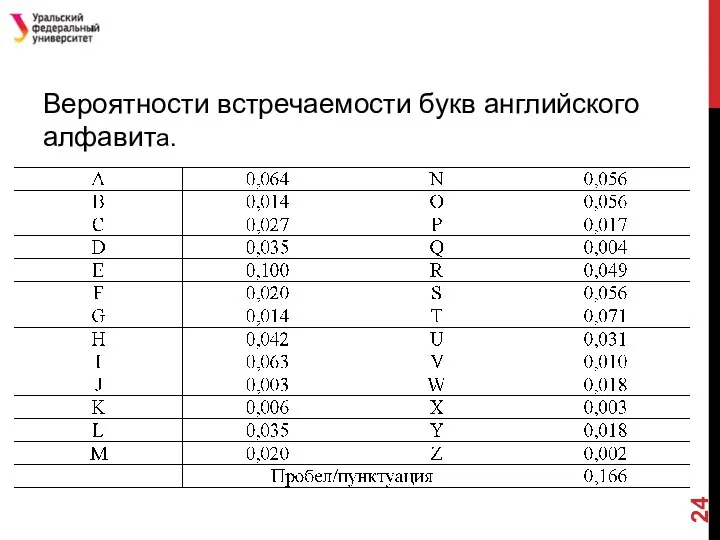

- 24. Вероятности встречаемости букв английского алфавита.

- 26. Таким образом, код Хаффмана для алфавита будет иметь среднюю длину ближе к четырем, чем к пяти.

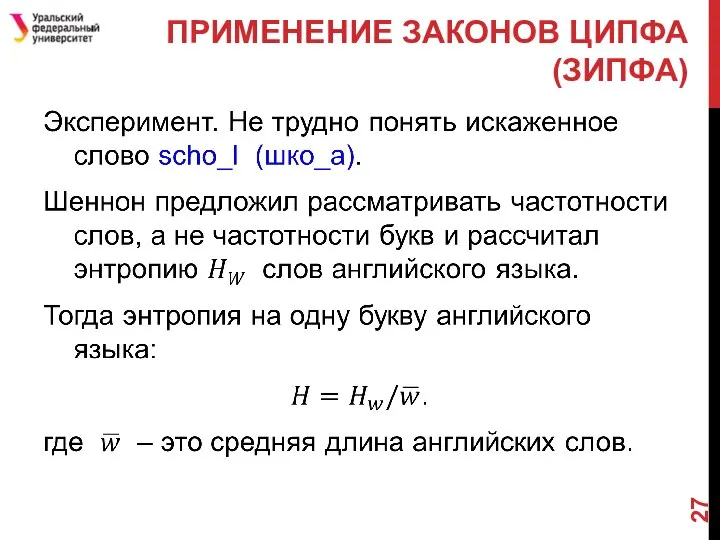

- 27. ПРИМЕНЕНИЕ ЗАКОНОВ ЦИПФА (ЗИПФА)

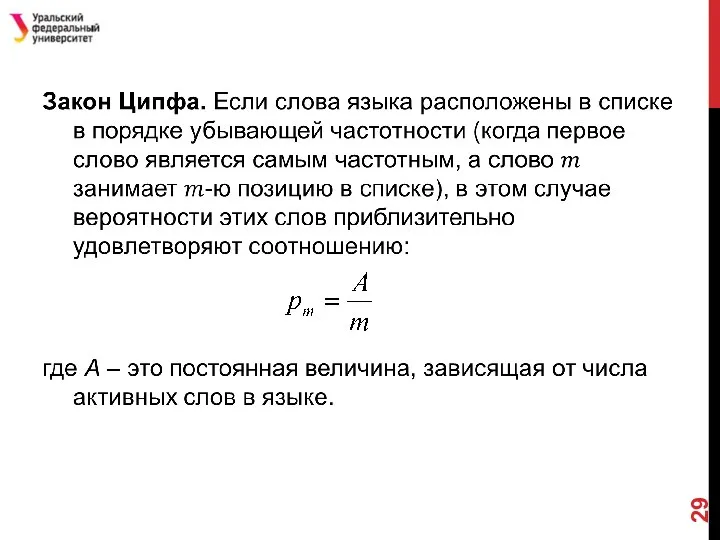

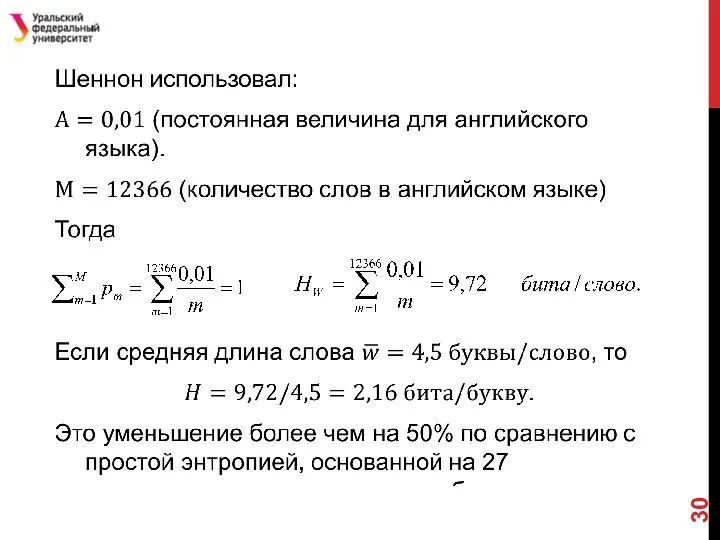

- 28. Для расчета Шеннон воспользовался законом Ципфа. (Джордж Ципф в 1949 г. эмпирически вывел соотношение частотностей слов).

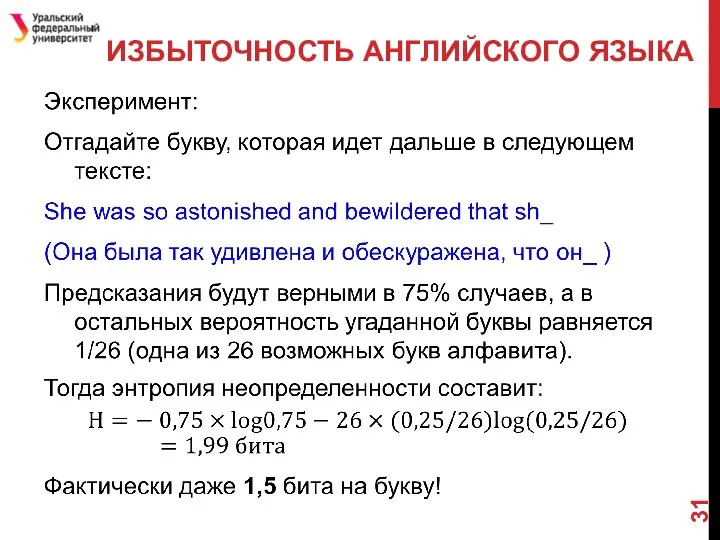

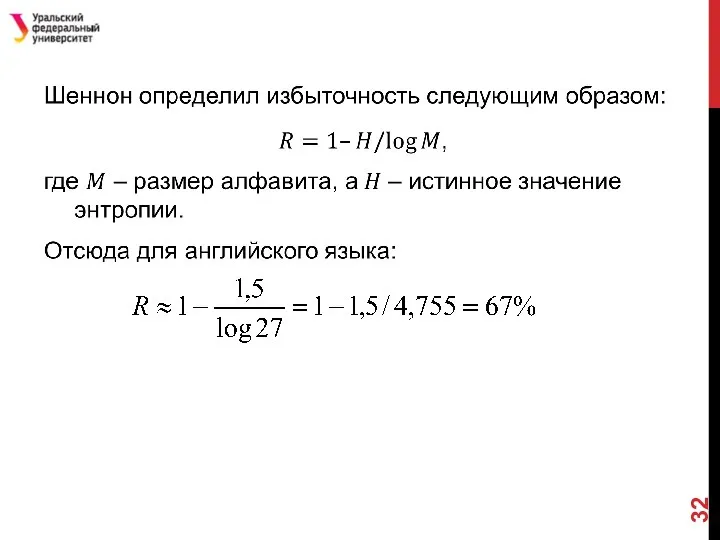

- 31. ИЗБЫТОЧНОСТЬ АНГЛИЙСКОГО ЯЗЫКА

- 33. Выводы: Имеется огромная возможность для компрессии английского текста. Текстовый файл может теоретически быть спрессован до размера,

- 34. КОДИРОВАНИЕ ЛЕМПЕЛЯ – ЗИВА Новаторский и талантливый метод компрессии предложили Зив и Лемпель в 1977 г.

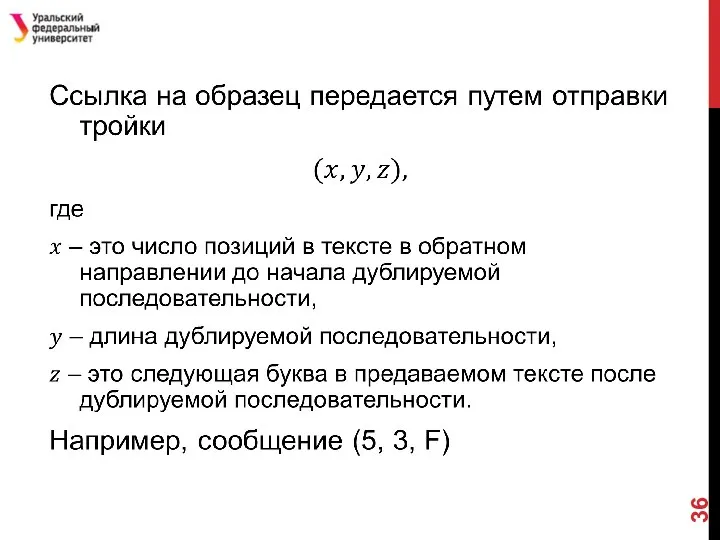

- 35. В методе Лемпеля – Зива и отправитель, и получатель ведут запись того, что уже было отправлено.

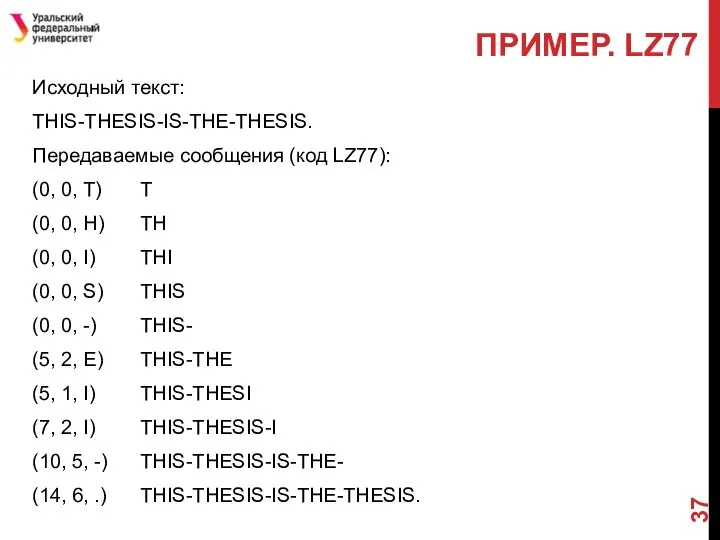

- 37. ПРИМЕР. LZ77 Исходный текст: THIS-THESIS-IS-THE-THESIS. Передаваемые сообщения (код LZ77): (0, 0, T) T (0, 0, H)

- 38. Задания: 1) Закодируйте сообщение: ROCCOBAROCCO. Код LZ77: (0,0,’R’) (0,0,’O’) (0,0,’C’) (1,1,’O’) (0,0,’B’) (0,0,’A’) (7,5,’.’) 2) Декодируйте

- 39. СОВРЕМЕННЫЕ АРХИВАТОРЫ

- 40. ДРУГИЕ ФОРМЫ СЖАТИЯ ИНФОРМАЦИИ Кроме текста, сжатие также применяется к графике, изображениям, речи, видео…(эти данные не

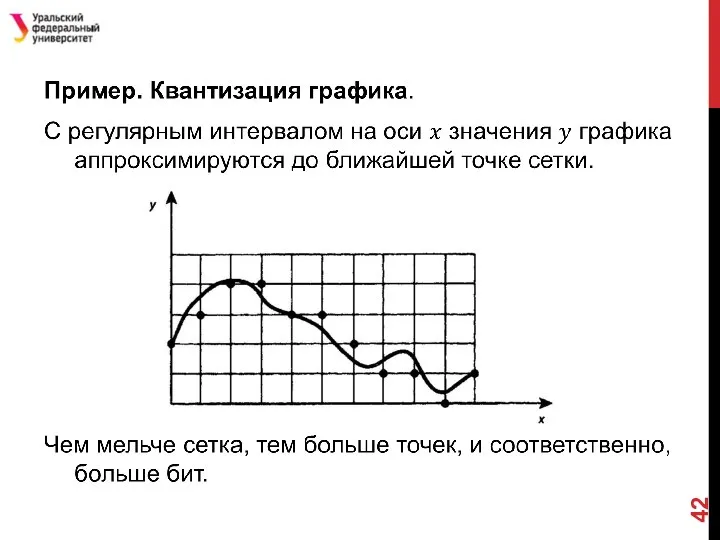

- 41. Общепринятой является обработка этих видов данных первоначально посредством дискретизации временного и пространственного измерения, а также уровней

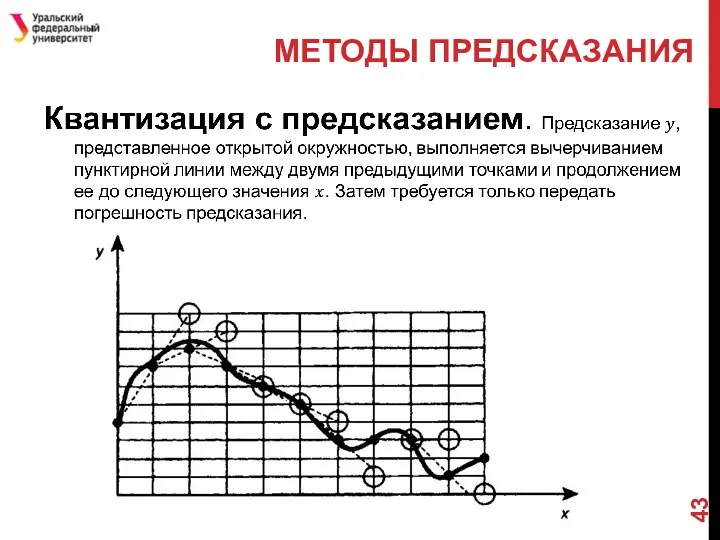

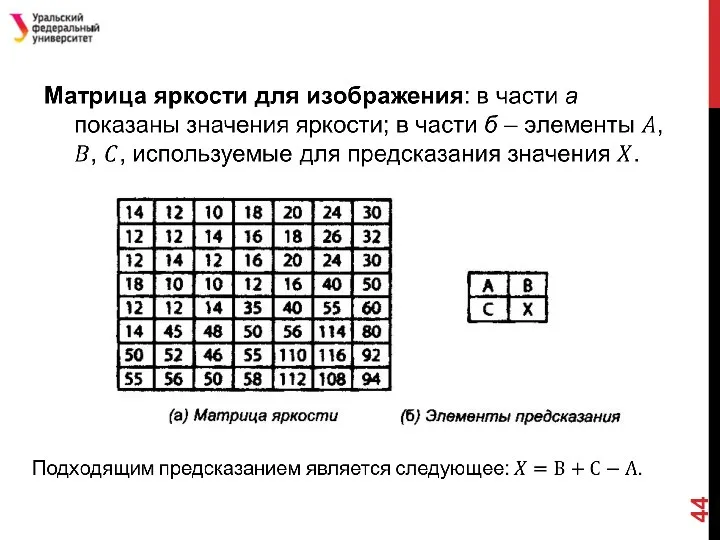

- 43. МЕТОДЫ ПРЕДСКАЗАНИЯ

- 45. JPEG Стандарты сжатия графической информации были установлены комитетом, который называется Совместной группой экспертов по фотографии (Joint

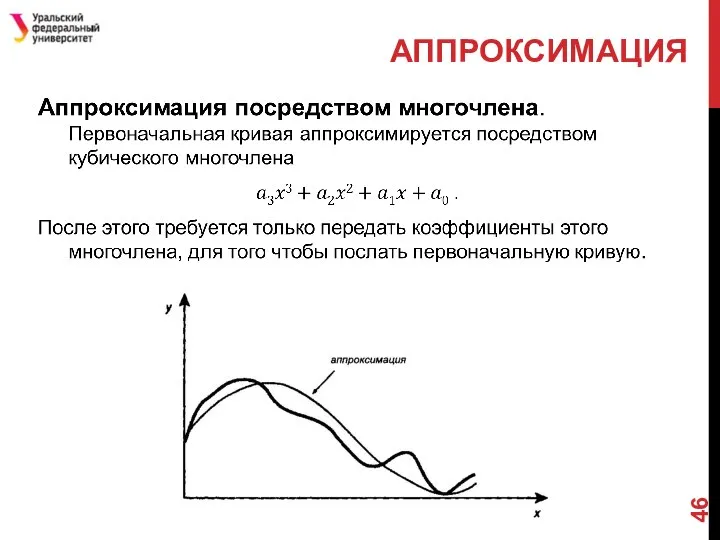

- 46. АППРОКСИМАЦИЯ

- 47. Популярная версия JPEG аппроксимирует матрицу яркости посредством серии двухмерных функций косинуса и записывает коэффициенты этой серии.

- 48. МРЗ MPEG (филиал комитета JPEG) – группа экспертов по киноизображениям разработала стандарты сжатия для киноизображений и

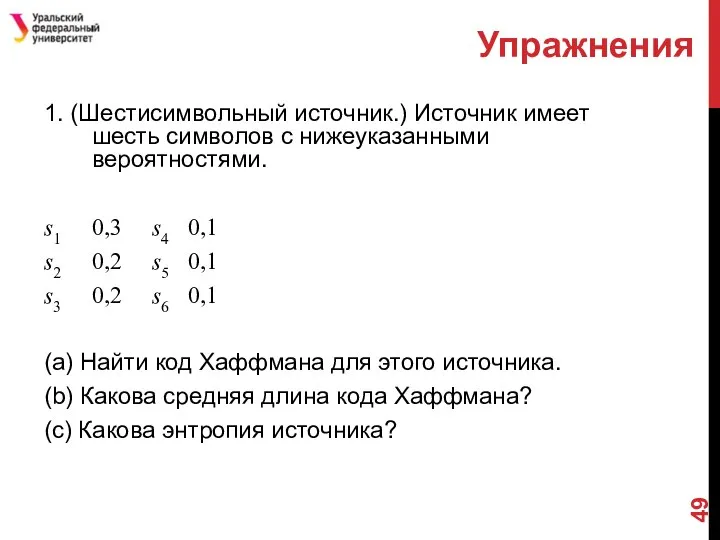

- 49. Упражнения 1. (Шестисимвольный источник.) Источник имеет шесть символов с нижеуказанными вероятностями. s1 0,3 s4 0,1 s2

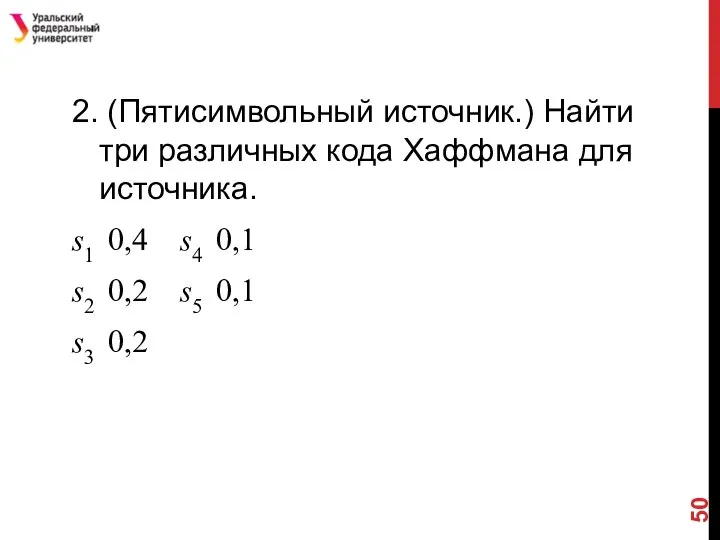

- 50. 2. (Пятисимвольный источник.) Найти три различных кода Хаффмана для источника. s1 0,4 s4 0,1 s2 0,2

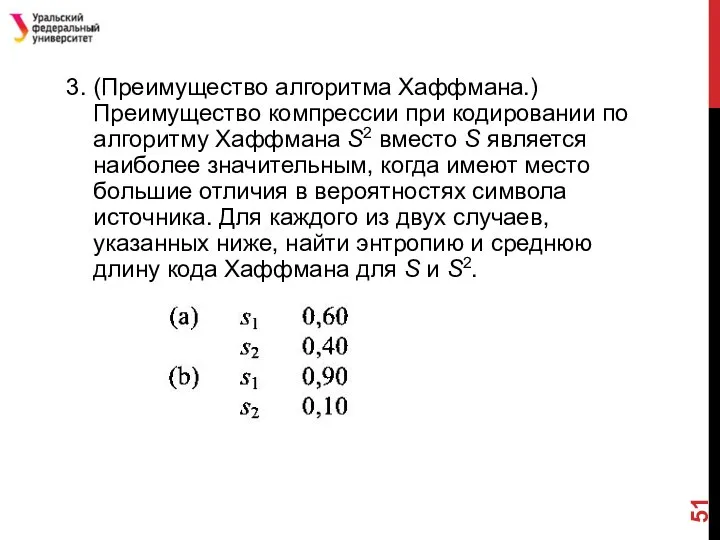

- 51. 3. (Преимущество алгоритма Хаффмана.) Преимущество компрессии при кодировании по алгоритму Хаффмана S2 вместо S является наиболее

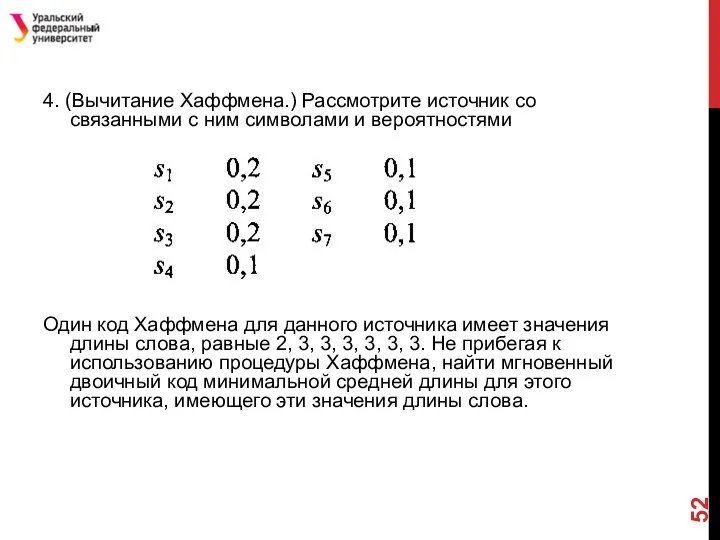

- 52. 4. (Вычитание Хаффмена.) Рассмотрите источник со связанными с ним символами и вероятностями Один код Хаффмена для

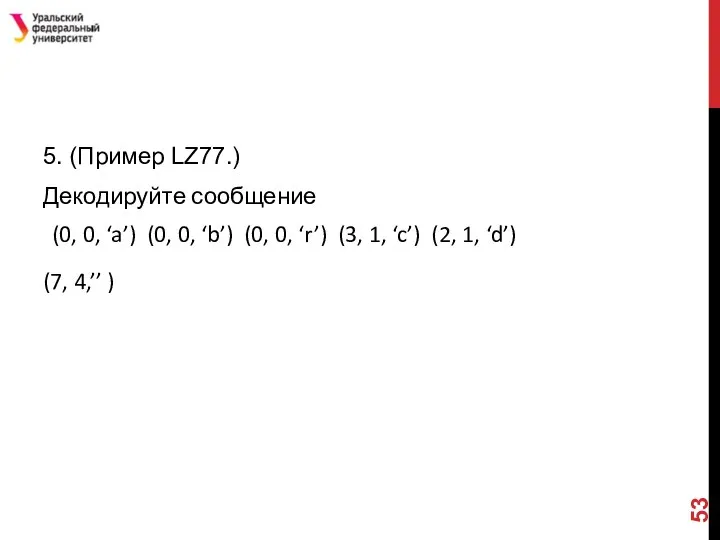

- 53. 5. (Пример LZ77.) Декодируйте сообщение (0, 0, ‘a’) (0, 0, ‘b’) (0, 0, ‘r’) (3, 1,

- 55. Скачать презентацию

Информация и её свойства. 7 класс

Информация и её свойства. 7 класс Ведение CРМ системы

Ведение CРМ системы Платформы для создания кроссвордов

Платформы для создания кроссвордов Взаимодействие систем электронного документооборота

Взаимодействие систем электронного документооборота Что такое компьютер

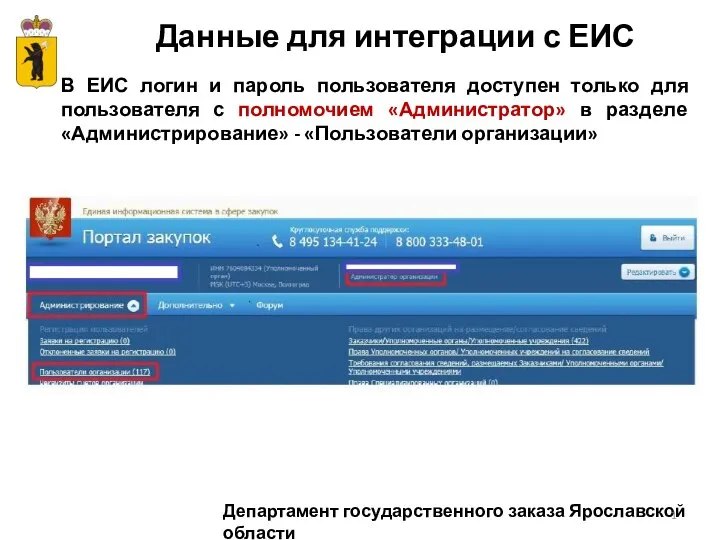

Что такое компьютер Данные для интеграции с ЕИС

Данные для интеграции с ЕИС Разработка интерфейса информационной системы с помощью Gui Matlab

Разработка интерфейса информационной системы с помощью Gui Matlab Жизненные ситуации и онлайн сервисы

Жизненные ситуации и онлайн сервисы Персональный компьютер. Компьютер как универсальное устройство для работы с информацией. Информатика, 7 класс

Персональный компьютер. Компьютер как универсальное устройство для работы с информацией. Информатика, 7 класс Войны в EVE Online

Войны в EVE Online Развитие мотивационного компонента творческого потенциала обучающихся на уроках информатики

Развитие мотивационного компонента творческого потенциала обучающихся на уроках информатики Dream Pad — блокнот сновидений в твоём сматфоне

Dream Pad — блокнот сновидений в твоём сматфоне Виды систем исчесления

Виды систем исчесления 1C:CRM Модуль для 1С:ERP и 1С:КА2 обзор решения

1C:CRM Модуль для 1С:ERP и 1С:КА2 обзор решения Основные понятия и теории моделирования

Основные понятия и теории моделирования Подключение сетевого принтера

Подключение сетевого принтера Разработка приложения StarPlatinum: Алгоритмизация

Разработка приложения StarPlatinum: Алгоритмизация Триггеры в презентации. Применение. Создание слайдов

Триггеры в презентации. Применение. Создание слайдов Пробой уровня

Пробой уровня Разновидности объектов и их классификация

Разновидности объектов и их классификация Ссылки – теория

Ссылки – теория Информационные технологии при изучении математики

Информационные технологии при изучении математики Kofax. Настраиваемые (обучаемые) локаторы для счет-фактуры. Извлечение по форматам и ключевым словам

Kofax. Настраиваемые (обучаемые) локаторы для счет-фактуры. Извлечение по форматам и ключевым словам Одномерные массивы целых чисел

Одномерные массивы целых чисел Понятие алгоритмов, свойства алгоритма

Понятие алгоритмов, свойства алгоритма Ограничение доступа к информации в целях защиты интересов личности, общества и государства

Ограничение доступа к информации в целях защиты интересов личности, общества и государства Специализированные технические средства, применяемые в библиотеках

Специализированные технические средства, применяемые в библиотеках Вставка изображения в документ ворд

Вставка изображения в документ ворд