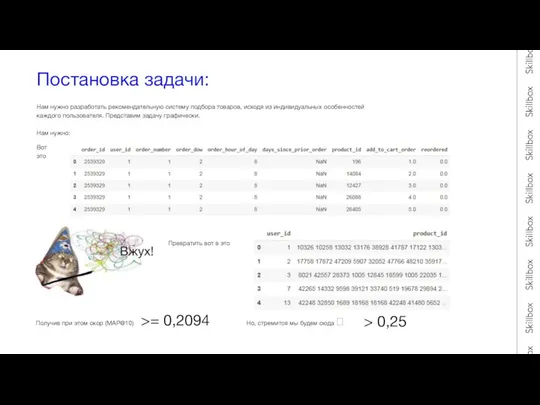

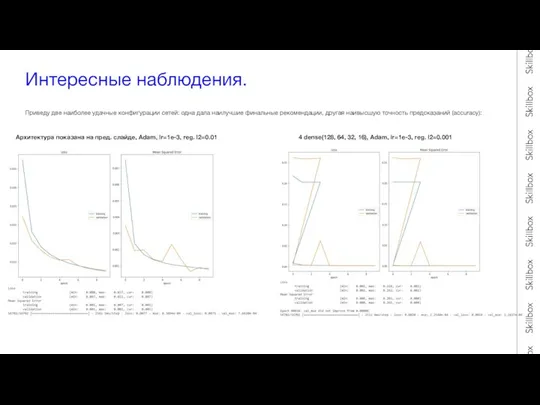

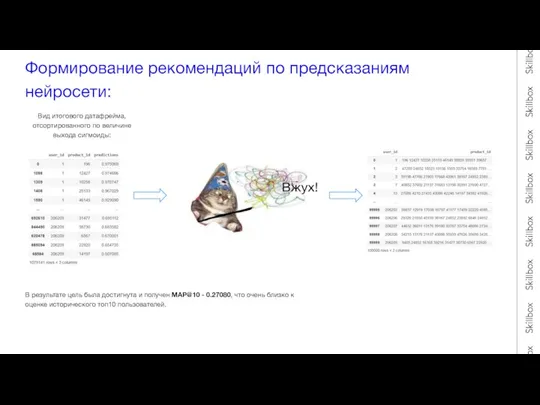

кол-во купленных за всю историю продуктов. В результате будем иметь для каждого пользователя такую картину: Повторим эту операцию 100 000 раз (для каждого пользователя) и преобразовав к итоговому виду, получим скор 0.27841.

Это будет наш эталон, к нему мы будем стремиться, однако мы не можем назвать такой подход рекомендательной системой, ведь мы ничего нового не предлагаем пользователю, а принимаем в учет только те товары, про которые он сам прекрасно знает и, более того, любит, т к это его топ.

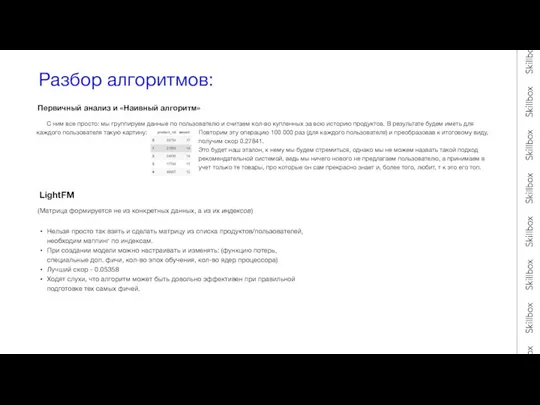

LightFM

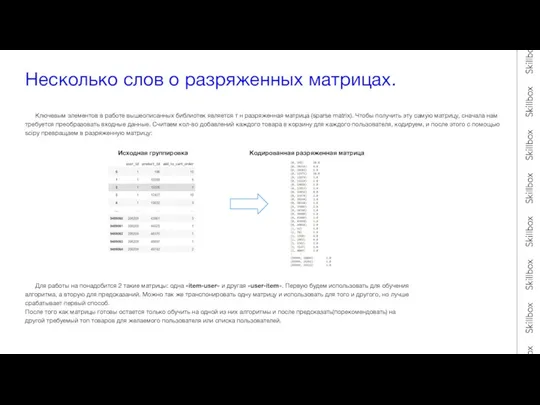

(Матрица формируется не из конкретных данных, а из их индексов)

Нельзя просто так взять и сделать матрицу из списка продуктов/пользователей, необходим маппинг по индексам.

При создании модели можно настраивать и изменять: (функцию потерь, специальные доп. фичи, кол-во эпох обучения, кол-во ядер процессора)

Лучший скор - 0.05358

Ходят слухи, что алгоритм может быть довольно эффективен при правильной подготовке тех самых фичей.

Первичный анализ и «Наивный алгоритм»

Экономика

Экономика Какое слово склевали цыплята?

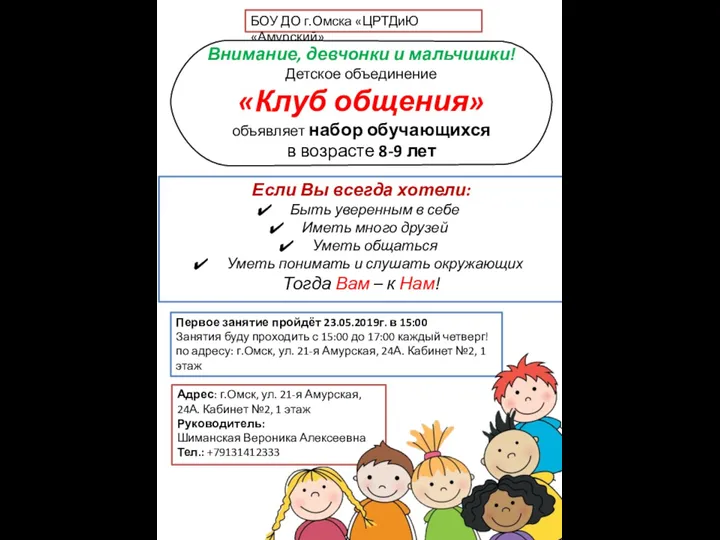

Какое слово склевали цыплята? Детское объединение Клуб общения

Детское объединение Клуб общения body parts

body parts ВКР: Алгоритм поиска неисправностей схемы питания главной платы smart-led-телевизора LG на шасси LA31R

ВКР: Алгоритм поиска неисправностей схемы питания главной платы smart-led-телевизора LG на шасси LA31R Pancakes day

Pancakes day  Перевод чисел из десятичной системы счисления в двоичную, восьмеричную и шестнадцатеричную

Перевод чисел из десятичной системы счисления в двоичную, восьмеричную и шестнадцатеричную Деловая игра для учащихся Притобольной средней школы

Деловая игра для учащихся Притобольной средней школы Правила проведения делового разговора по телефону

Правила проведения делового разговора по телефону Формулировка и комментарий основной проблемы текста

Формулировка и комментарий основной проблемы текста Новые инновационные композиционные материалы

Новые инновационные композиционные материалы Портрет Натюрморт Пейзаж Описание

Портрет Натюрморт Пейзаж Описание Происхождение Вселенной 11 класс

Происхождение Вселенной 11 класс Лудомания

Лудомания Повышение эффективности системы солнечного теплоснабженияА. Жамалов КазГос ЖенПИ

Повышение эффективности системы солнечного теплоснабженияА. Жамалов КазГос ЖенПИ Развитие координационных способностей у юных борцов вольного стиля

Развитие координационных способностей у юных борцов вольного стиля My holidays

My holidays Презентация

Презентация Презентация на тему Первые русские князья Олег, Игорь, Ольга

Презентация на тему Первые русские князья Олег, Игорь, Ольга  Гатчинский педагогический колледж имени К.Д. Ушинского

Гатчинский педагогический колледж имени К.Д. Ушинского Объект. Предмет

Объект. Предмет Покинут счастьем будет тот, Кого ребёнком плохо воспитали. Побег зелёный выпрямить легко, Сухую ветвь один огонь исправит.

Покинут счастьем будет тот, Кого ребёнком плохо воспитали. Побег зелёный выпрямить легко, Сухую ветвь один огонь исправит.  Научная химическая лаборатория Ломоносова

Научная химическая лаборатория Ломоносова Вы блестящий учитель, у Вас прекрасные ученики!

Вы блестящий учитель, у Вас прекрасные ученики! Среды обитания организмов. Приспособленность к среде обитания

Среды обитания организмов. Приспособленность к среде обитания Киото Сангё Университет

Киото Сангё Университет Звезда по имени Саломея Крушельницкая

Звезда по имени Саломея Крушельницкая «Создание условий в ДОУ комбинированного вида для комплексной поддержки детей с ограниченными возможностями здоровья»

«Создание условий в ДОУ комбинированного вида для комплексной поддержки детей с ограниченными возможностями здоровья»