Содержание

- 2. План курса Машинное обучение (3 занятия) Нейронные сети (2 занятия) Сверточные нейронные сети (2 занятия) Детекция

- 3. План лекции Типы задач машинного обучения Обучение с учителем KNN Обучение моделей Линейная регрессия и переобучение

- 4. Типы задач машинного обучения

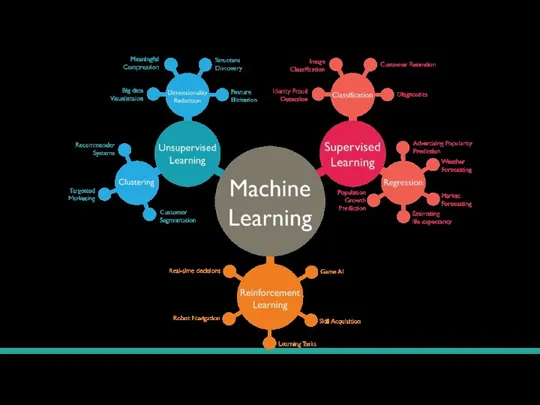

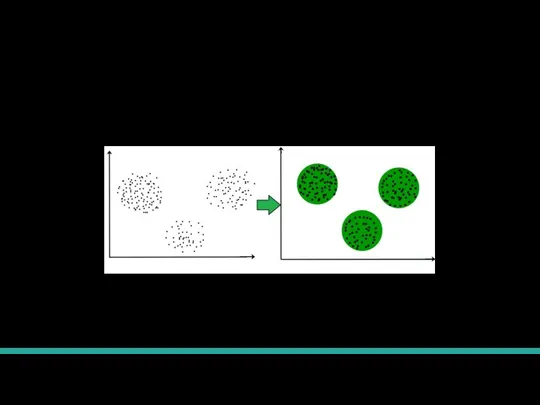

- 6. Unsupervised learning Кластеризация. Применение на практике: разделение аудитории на группы с общими интересами для эффективной рекламы.

- 7. Reinforcement learning Reinforcement Learning основан на том, что алгоритм за каждое свое действие получает награду или

- 8. Обучение с учителем

- 9. Обучение с учителем (supervised learning) X - множество объектов Y - множество ответов истинная зависимость. Обучающий

- 10. Обучение с учителем (supervised learning) Типы признаков (features): Числовые (Numerical) Категориальные (Categorical) Порядковые (Ordinal) Типы задач:

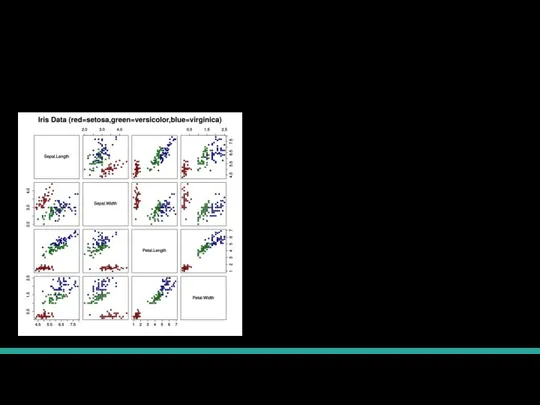

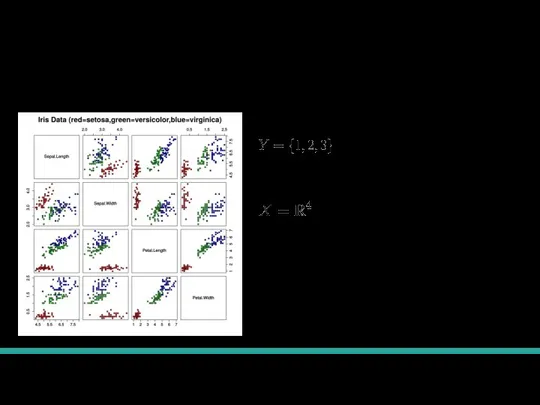

- 11. Примеры задач (Ирисы Фишера) Какая это задача? Какие есть признаки?

- 12. Примеры задач (Ирисы Фишера) Какая это задача? . Задача классификации. Какие есть признаки? . Есть только

- 13. Примеры задач (Цена дома) Какая это задача? Какие есть признаки? Нужно предсказать стоимость дома. Есть обучающий

- 14. Примеры задач (Цена дома) Какая это задача? . Задача регрессии. Какие есть признаки? Числовые, порядковые, категориальные.

- 15. Примеры задач (Поисковая выдача) Какая это задача? Какие есть признаки? Получив запрос от пользователя нужно найти

- 16. Примеры задач (Поисковая выдача) Какая это задача? Задача ранжирования. Какие есть признаки? Данные намного сложнее и

- 17. KNN

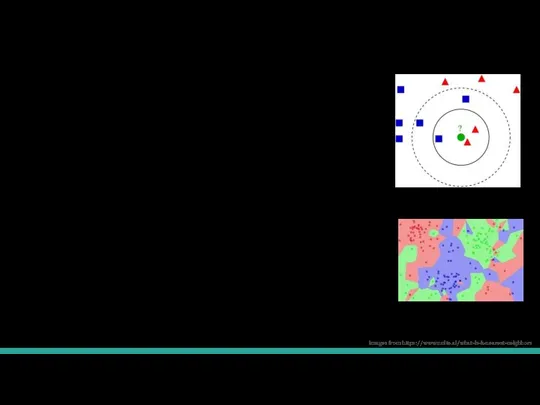

- 18. K-Nearest Neighbors Images from https://www.unite.ai/what-is-k-nearest-neighbors Решение задачи классификации: Обучение: Просто запоминаем обучающую выборку. Предсказание: Получаем точку

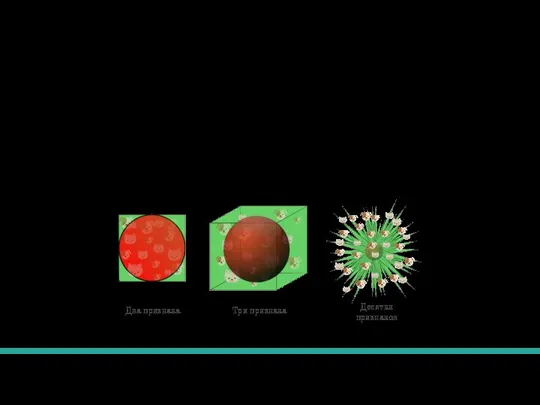

- 19. Curse of Dimensionality В KNN мы делаем очень слабое предположение: близкие точки будут иметь близкие ответы.

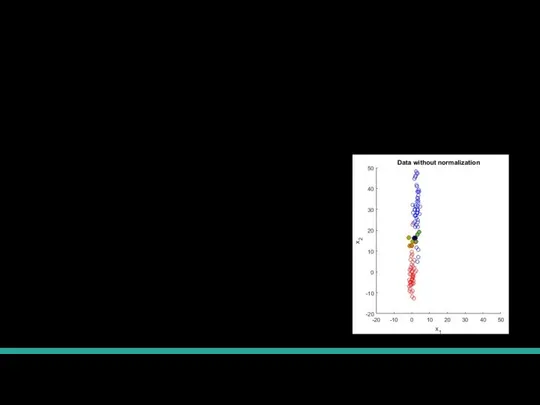

- 20. Feature Scale Если в качестве метрики взять обычное расстояние между векторами, то возникает проблема масштаба признаков.

- 21. Обучение моделей

- 22. Обучение с учителем (supervised learning) Наша задача - найти функцию хорошо приближающую реальную зависимость . Назовем

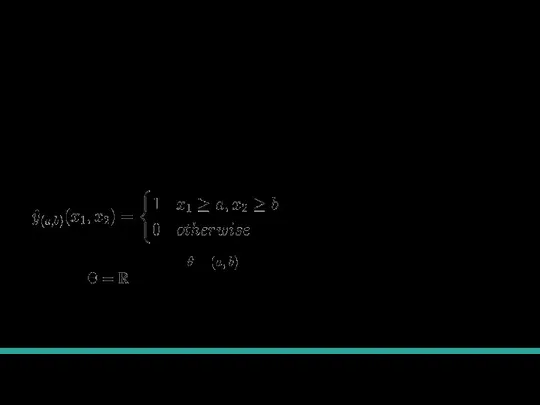

- 23. Пример семейства моделей (функции порога) Задача: определить, можно ли ребенку пройти на аттракцион? Причем мы знаем

- 24. Обучение с учителем (supervised learning) Обучение -- процесс выбора параметра , которому соответствует наиболее подходящее нам

- 25. Обучение с учителем (supervised learning) Как обучать алгоритм (подбирать оптимальные параметры)?

- 26. Обучение с учителем (supervised learning) Функция потерь (loss): Определим функцию , ее значение показывает насколько сильно

- 27. Обучение с учителем (supervised learning) Эмпирический риск: Определим эмпирический риск как среднее значение функции потерь на

- 28. Линейная регрессия и переобучение

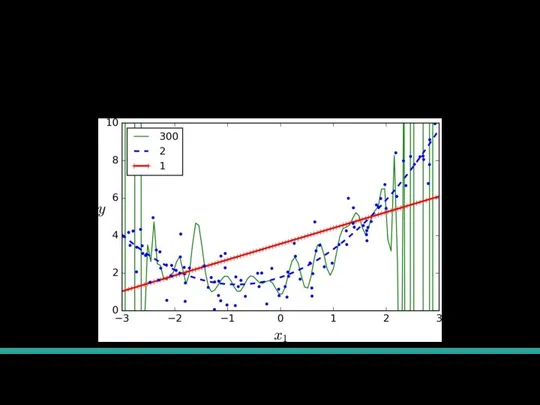

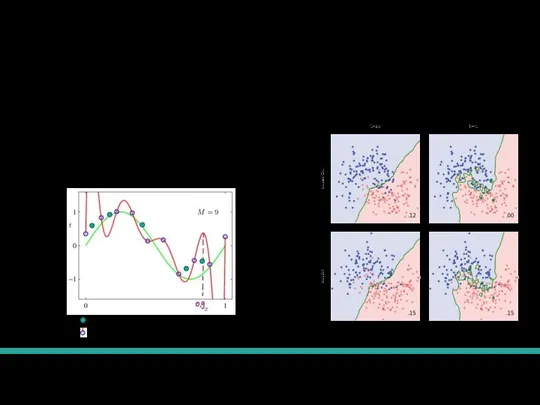

- 29. Переобучение для линейной регрессии Вспомним как выглядит линейная регрессия: Обучение линейной регрессии: Классически в качестве лосса

- 30. Переобучение для линейной регрессии Вспомним как выглядит линейная регрессия: Polynomial Regression: Пусть у нас изначально есть

- 31. Переобучение для линейной регрессии

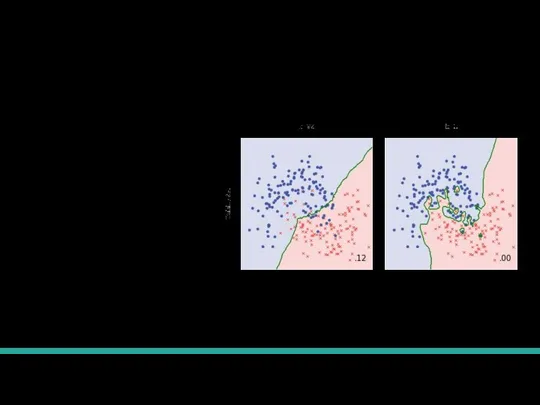

- 32. Переобучение (KNN) Если в алгоритме KNN мы возьмем k = 1, то получим идеальные предсказания на

- 33. Как определить термин переобучение и потом находить его?

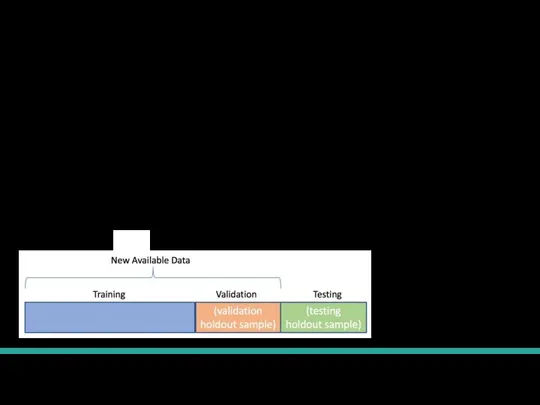

- 34. Разделение на Train/Validation/Test Train - данные для обучения. Validation - данные для итеративной оценки качества. Test

- 35. Разделение на Train/Validation/Test Переобучение - ситуация, когда качество модели на train данных значительно лучше, чем на

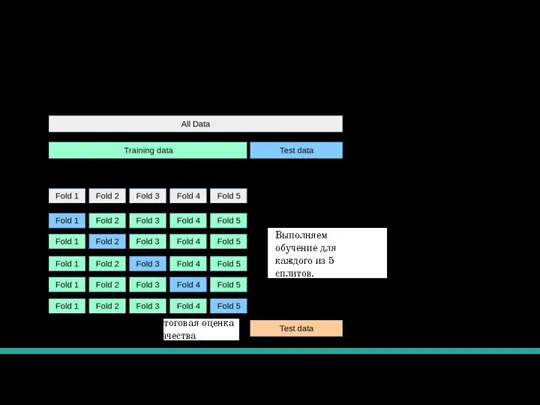

- 36. Cross-validation Выполняем обучение для каждого из 5 сплитов. Итоговая оценка качества

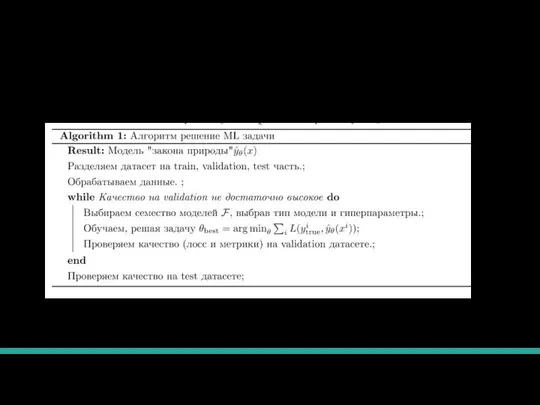

- 37. Алгоритм применения ML

- 38. Решение задачи

- 40. Скачать презентацию

Программное обеспечение компьютера

Программное обеспечение компьютера Обработка фотографий в Lightroom

Обработка фотографий в Lightroom Презентация на тему Безопасность в сети интернет для 5-6 классов

Презентация на тему Безопасность в сети интернет для 5-6 классов  Создание коллажей. Работа со слоями на изображениях. Урок 20

Создание коллажей. Работа со слоями на изображениях. Урок 20 Универсальность цифрового представления информации

Универсальность цифрового представления информации Культура, этика и практика масс-медиа. Современная журналистика

Культура, этика и практика масс-медиа. Современная журналистика Объекты в JavaScript, их свойства и методы

Объекты в JavaScript, их свойства и методы Проектирование программных систем

Проектирование программных систем Ithub-1. Поиск утечек персональных данных

Ithub-1. Поиск утечек персональных данных Cvičení 6 4IZ110 - Informační a komunikační technologie

Cvičení 6 4IZ110 - Informační a komunikační technologie Разработка программного продукта по предметной области, автоматизированная работа предприятия ОАО ФСК ЕЭС Верхне-Донское ПМЭС

Разработка программного продукта по предметной области, автоматизированная работа предприятия ОАО ФСК ЕЭС Верхне-Донское ПМЭС Виртуальная экскурсия. Основные преимущества и недостатки

Виртуальная экскурсия. Основные преимущества и недостатки Файлообменник

Файлообменник Создание конференции в Skype

Создание конференции в Skype Системы счисления. Математические основы информатики

Системы счисления. Математические основы информатики Дорожные знаки. Запрещающие знаки

Дорожные знаки. Запрещающие знаки Уровни и типы требований

Уровни и типы требований Основы самоорганизующихся сетей

Основы самоорганизующихся сетей Проектирование реляционных баз данных на основе принципов нормализации, с использованием семантических моделей

Проектирование реляционных баз данных на основе принципов нормализации, с использованием семантических моделей Текстовые документы и технологии их создания

Текстовые документы и технологии их создания Локальные компьютерные сети

Локальные компьютерные сети Анализ соцсети

Анализ соцсети Программное обеспечение. Виртуальные машины

Программное обеспечение. Виртуальные машины Принципы построения функций, используемы в криптографических системах

Принципы построения функций, используемы в криптографических системах Одномерные массивы

Одномерные массивы Разработка программных приложений. Парадигмы программирования

Разработка программных приложений. Парадигмы программирования Dzień dobry, proszę o wykonanie polecenia z opisu, na tej podstawie otrzymają

Dzień dobry, proszę o wykonanie polecenia z opisu, na tej podstawie otrzymają Закрепление материала о документах Microsoft Word

Закрепление материала о документах Microsoft Word