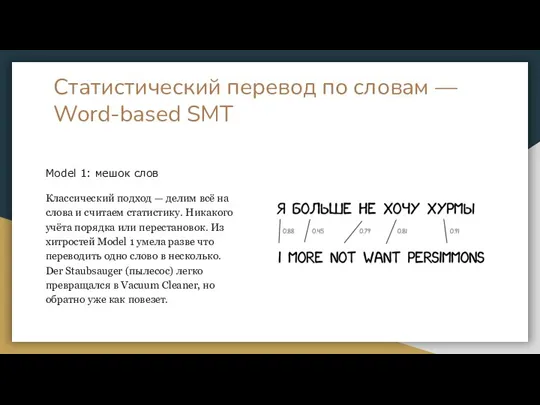

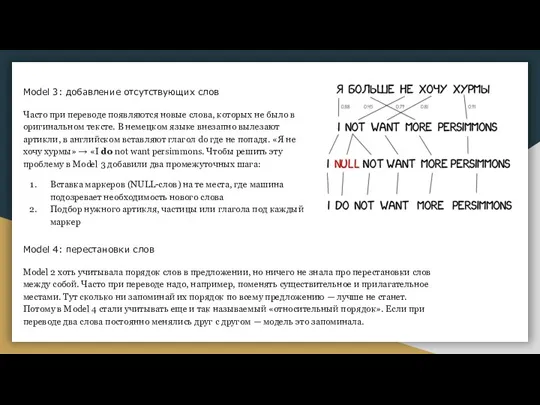

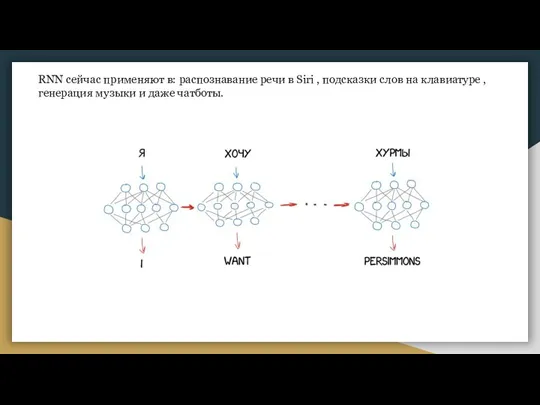

было в оригинальном тексте. В немецком языке внезапно вылезают артикли, в английском вставляют глагол do где не попадя. «Я не хочу хурмы» → «I do not want persimmons. Чтобы решить эту проблему в Model 3 добавили два промежуточных шага:

Вставка маркеров (NULL-слов) на те места, где машина подозревает необходимость нового слова

Подбор нужного артикля, частицы или глагола под каждый маркер

Model 4: перестановки слов

Model 2 хоть учитывала порядок слов в предложении, но ничего не знала про перестановки слов между собой. Часто при переводе надо, например, поменять существительное и прилагательное местами. Тут сколько ни запоминай их порядок по всему предложению — лучше не станет. Потому в Model 4 стали учитывать еще и так называемый «относительный порядок». Если при переводе два слова постоянно менялись друг с другом — модель это запоминала.

История термина алгоритм

История термина алгоритм Moodboard на тему Зимний день

Moodboard на тему Зимний день Структуры данных для выполнения интервальных запросов

Структуры данных для выполнения интервальных запросов Введение в программирование на языке Python. Повторение

Введение в программирование на языке Python. Повторение Информационная безопасность. Фишинг

Информационная безопасность. Фишинг Моделирование информационных систем

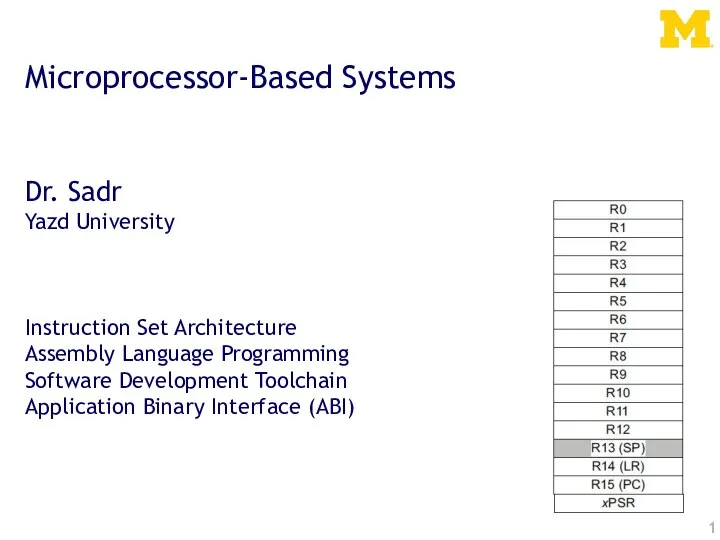

Моделирование информационных систем Microprocessor-Based Systems

Microprocessor-Based Systems Робототехника и искусственный интеллект

Робототехника и искусственный интеллект Поисковые системы Internet. Информационно поисковая система Рамблер

Поисковые системы Internet. Информационно поисковая система Рамблер Системы счисления

Системы счисления 21-22_Объект события

21-22_Объект события Иконография. Детство – какое оно

Иконография. Детство – какое оно Разработать и предложить модель и инструменты информационного взаимодействия с обучающимися

Разработать и предложить модель и инструменты информационного взаимодействия с обучающимися Webpack

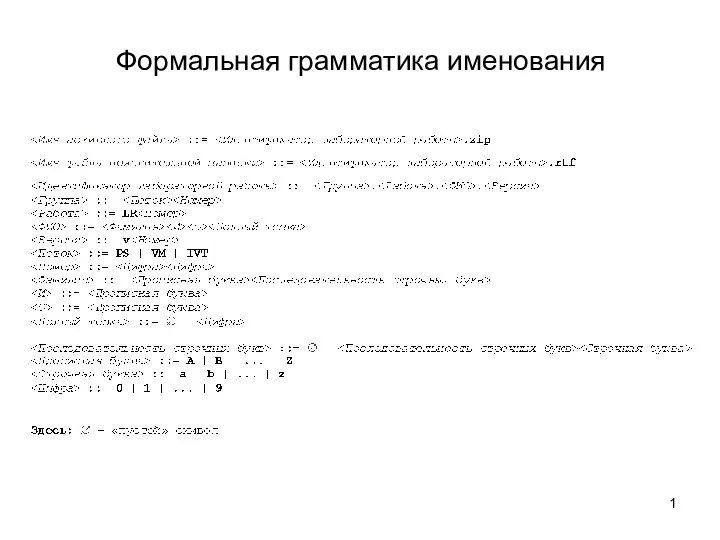

Webpack Формальная грамматика именования

Формальная грамматика именования Основные элементы программирования

Основные элементы программирования Референсы постов для оценки дизайна

Референсы постов для оценки дизайна Братья Гримм. Сказки

Братья Гримм. Сказки Списочные выражения. Методы Split и Join

Списочные выражения. Методы Split и Join Исходная концептуальная схема обеспечения ИБ

Исходная концептуальная схема обеспечения ИБ Массивы. Объявление

Массивы. Объявление Файловая система

Файловая система Вред и польза социальных сетей

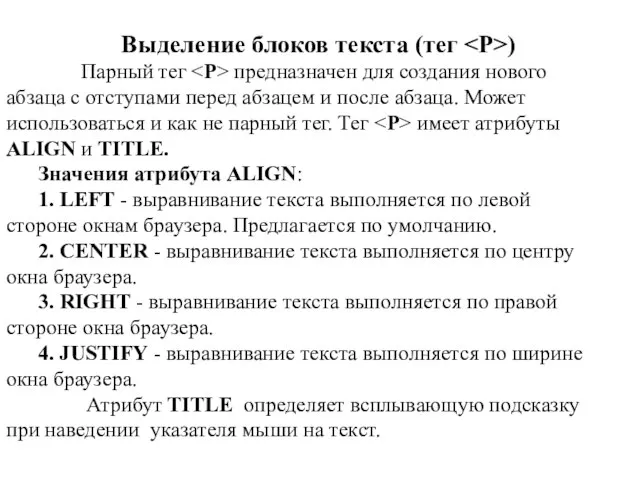

Вред и польза социальных сетей Выделение блоков текста (тег <P>)

Выделение блоков текста (тег <P>) Шрифт Times New Roman

Шрифт Times New Roman Единое окно доступа к информационным ресурсам

Единое окно доступа к информационным ресурсам Python в качестве альтернативного языка обучения программированию

Python в качестве альтернативного языка обучения программированию Разработка и сопровождение web-ресурса для ИП Заболотская

Разработка и сопровождение web-ресурса для ИП Заболотская