Содержание

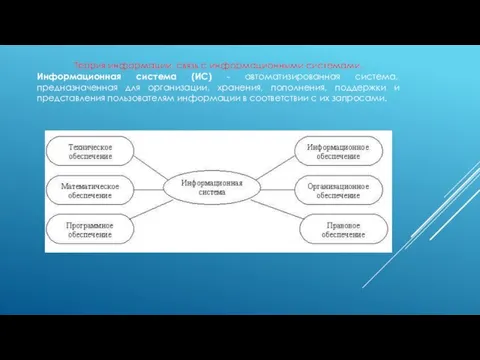

- 2. Теория информации, связь с информационными системами. Информационная система (ИС) - автоматизированная система, предназначенная для организации, хранения,

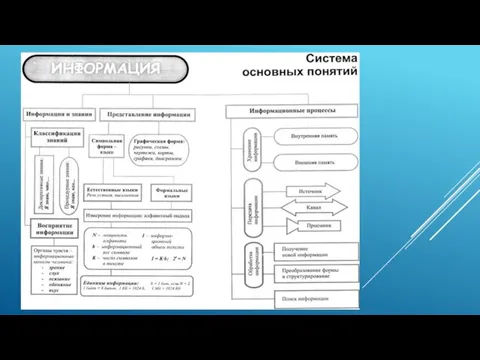

- 3. Информация — нематериальная сущность, при помощи которой с любой точностью можно описывать реальные (материальные), виртуальные (возможные)

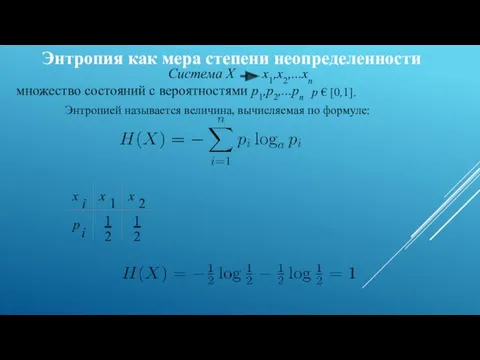

- 7. Энтропия как мера степени неопределенности Энтропией называется величина, вычисляемая по формуле: Система X x1,x2,...xn множество состояний

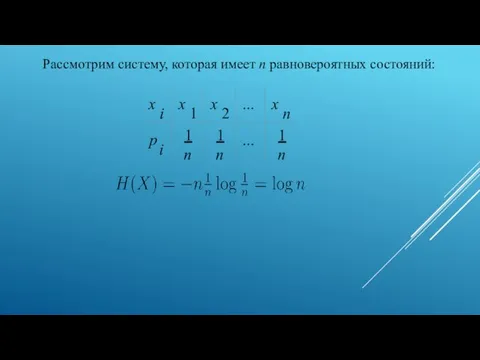

- 8. Рассмотрим систему, которая имеет n равновероятных состояний:

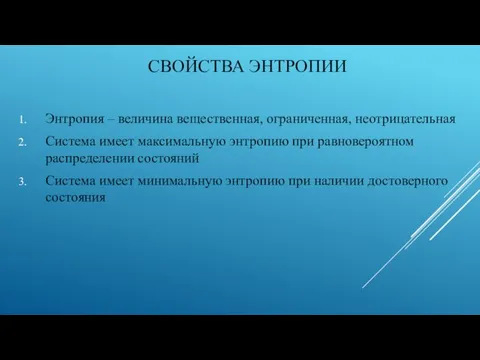

- 9. СВОЙСТВА ЭНТРОПИИ Энтропия – величина вещественная, ограниченная, неотрицательная Система имеет максимальную энтропию при равновероятном распределении состояний

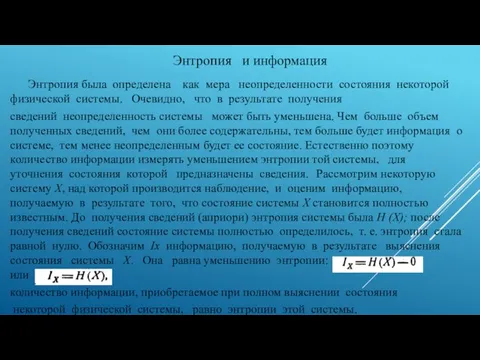

- 10. Энтропия и информация Энтропия была определена как мера неопределенности состояния некоторой физической системы. Очевидно, что в

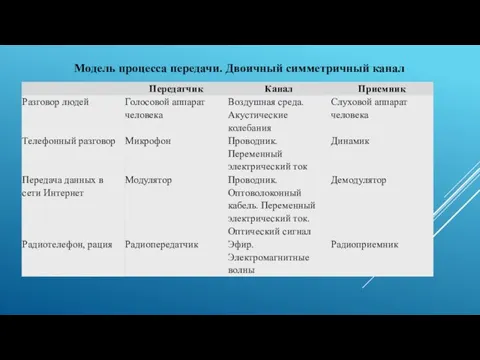

- 11. Модель процесса передачи. Двоичный симметричный канал

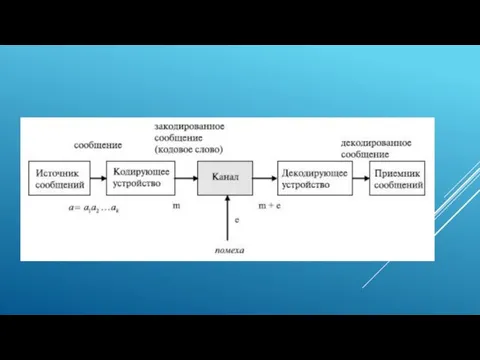

- 12. Общая схема передачи информации

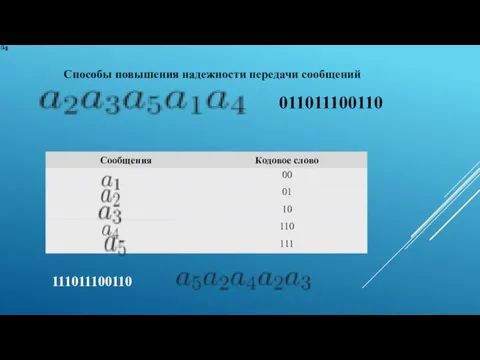

- 13. Способы повышения надежности передачи сообщений 011011100110 111011100110

- 16. Скачать презентацию

Операционные системы компьютера

Операционные системы компьютера Python как универсальный инструмент реализации количественных исследований

Python как универсальный инструмент реализации количественных исследований Методы массивов

Методы массивов Параллельные сортировки на общей памяти

Параллельные сортировки на общей памяти Интернет помогает учиться. Интернет-ресурсы для детей и их родителей

Интернет помогает учиться. Интернет-ресурсы для детей и их родителей Инструмент для поиска отзывов пользователей на заданный товар или компанию

Инструмент для поиска отзывов пользователей на заданный товар или компанию Использование сетевого ресурса Dnevnik.ru в работе учителя

Использование сетевого ресурса Dnevnik.ru в работе учителя Классификация программного обеспечения

Классификация программного обеспечения Digital classroom. Микроскопия для образования в эпоху цифровых технологий

Digital classroom. Микроскопия для образования в эпоху цифровых технологий Система автоматизации договорной работы ТурбоКонтракт

Система автоматизации договорной работы ТурбоКонтракт Система управления базами данных (Урок 8)

Система управления базами данных (Урок 8) Выпускная квалификационная работа: применение XML технологий на MS SQL для сопровождения корпоративных приложений

Выпускная квалификационная работа: применение XML технологий на MS SQL для сопровождения корпоративных приложений Flask. Пример Hello

Flask. Пример Hello Порядок передачи ВКР для размещения в электронной библиотеке

Порядок передачи ВКР для размещения в электронной библиотеке Шутер. Враги и снаряды

Шутер. Враги и снаряды Подготовка учебной презентации и особенности ее использования

Подготовка учебной презентации и особенности ее использования Строки в C#

Строки в C# Эвристические методы синтеза систем

Эвристические методы синтеза систем Множество. Понятие множества

Множество. Понятие множества Термины РМД в SQL

Термины РМД в SQL E-mail

E-mail Презентация на тему Алгебра логики вторая часть

Презентация на тему Алгебра логики вторая часть  Информатика 2 класс. Одинаковые цепочки. Разные цепочки

Информатика 2 класс. Одинаковые цепочки. Разные цепочки Topslide. Дизайн, эффективность, скорость

Topslide. Дизайн, эффективность, скорость Метрологическое обеспечение испытаний абонентского оборудования 45G на соответствие требованиям стандартов

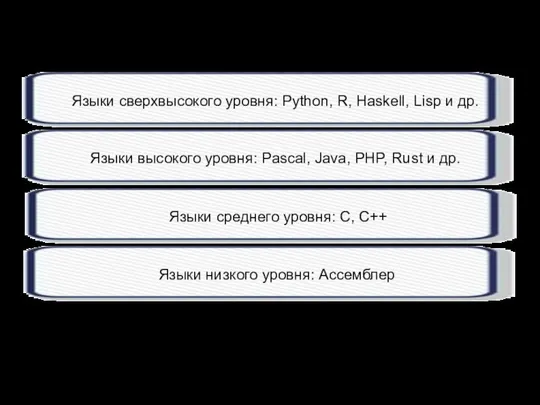

Метрологическое обеспечение испытаний абонентского оборудования 45G на соответствие требованиям стандартов Языки сверхвысокого уровня: Python, R, Haskell, Lisp И Др

Языки сверхвысокого уровня: Python, R, Haskell, Lisp И Др Основные теоретические вопросы проектирования ПОР

Основные теоретические вопросы проектирования ПОР Преобразование форматов данных

Преобразование форматов данных