Содержание

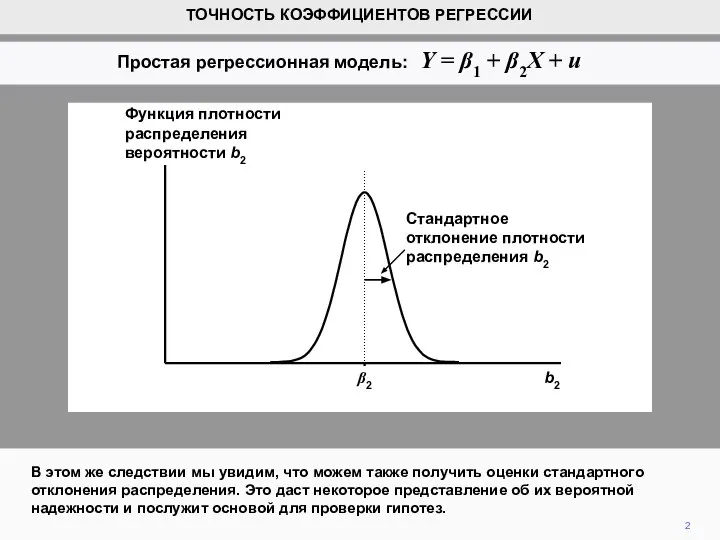

- 2. В этом же следствии мы увидим, что можем также получить оценки стандартного отклонения распределения. Это даст

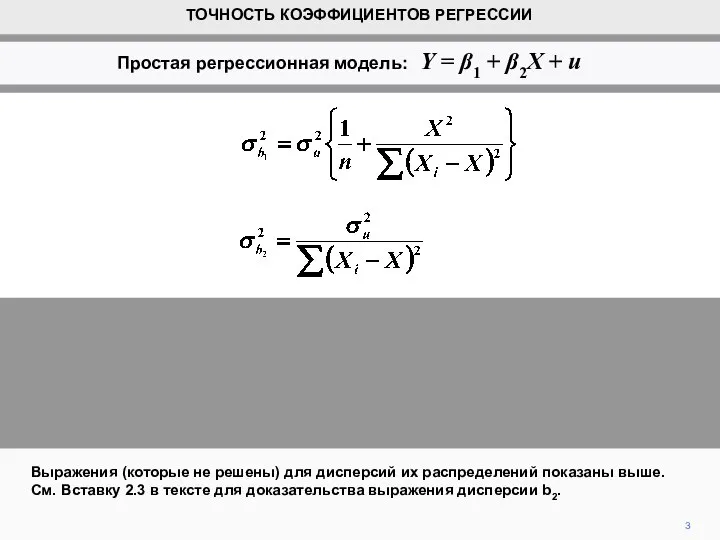

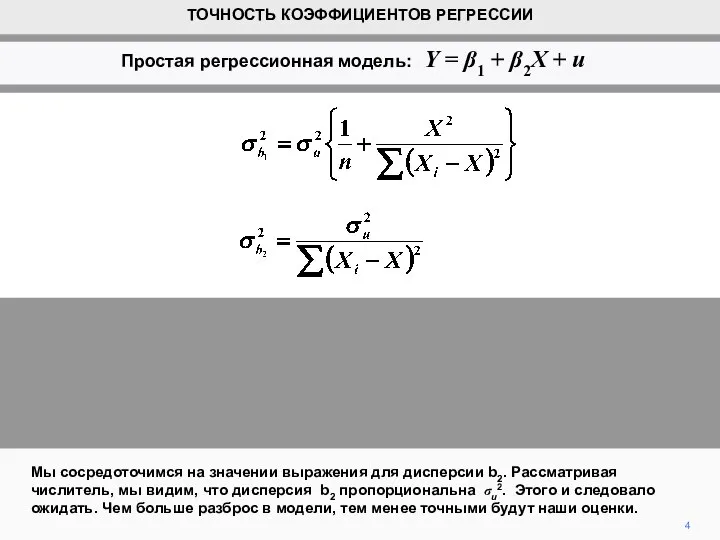

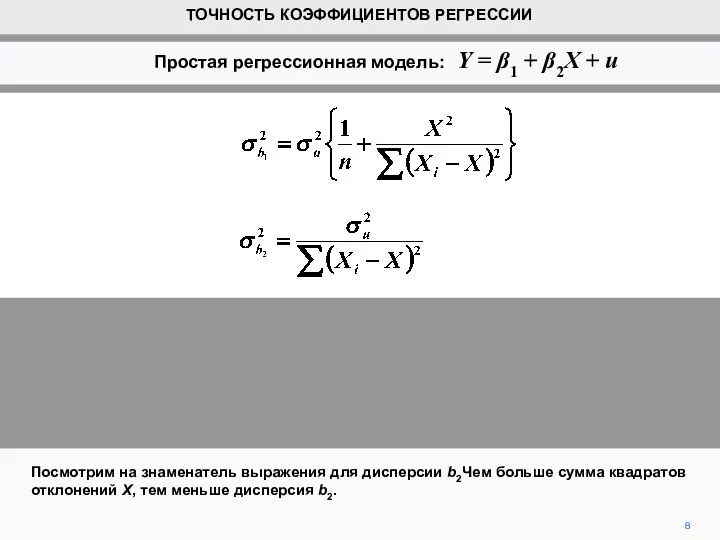

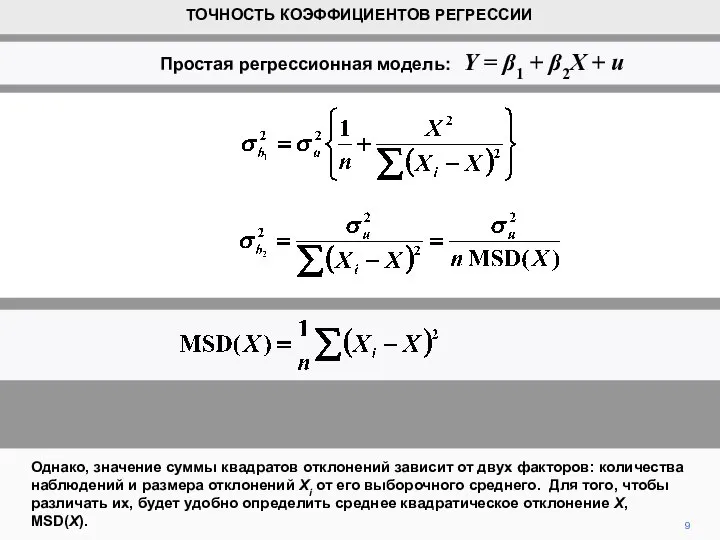

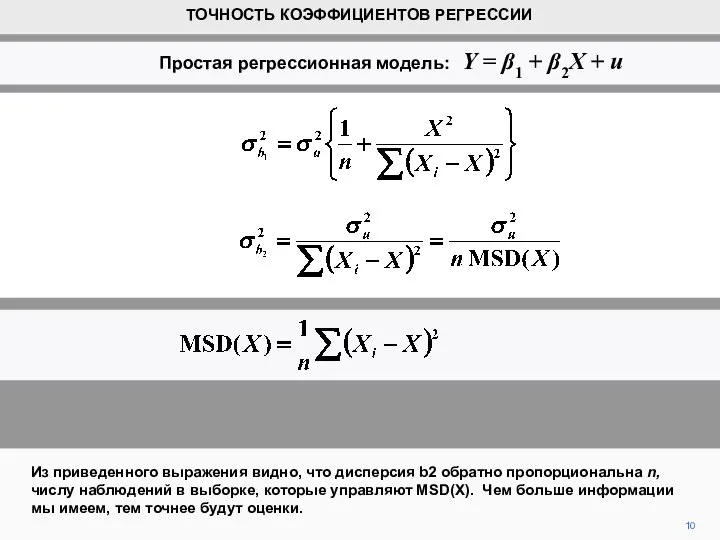

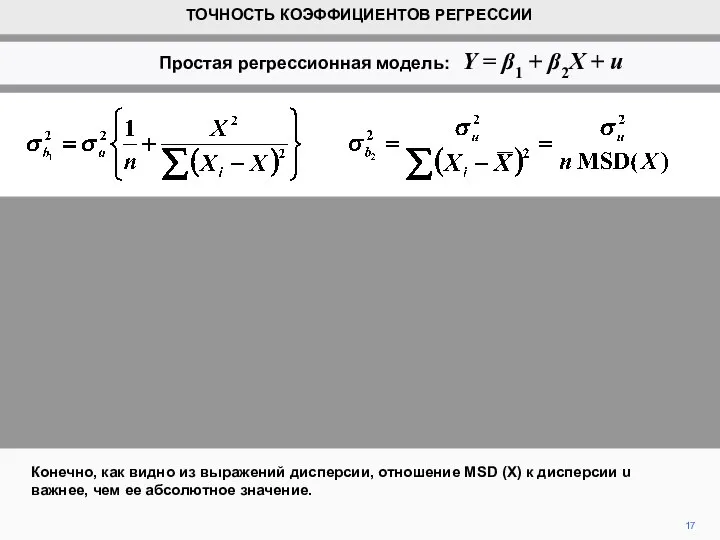

- 3. Выражения (которые не решены) для дисперсий их распределений показаны выше. См. Вставку 2.3 в тексте для

- 4. Мы сосредоточимся на значении выражения для дисперсии b2. Рассматривая числитель, мы видим, что дисперсия b2 пропорциональна

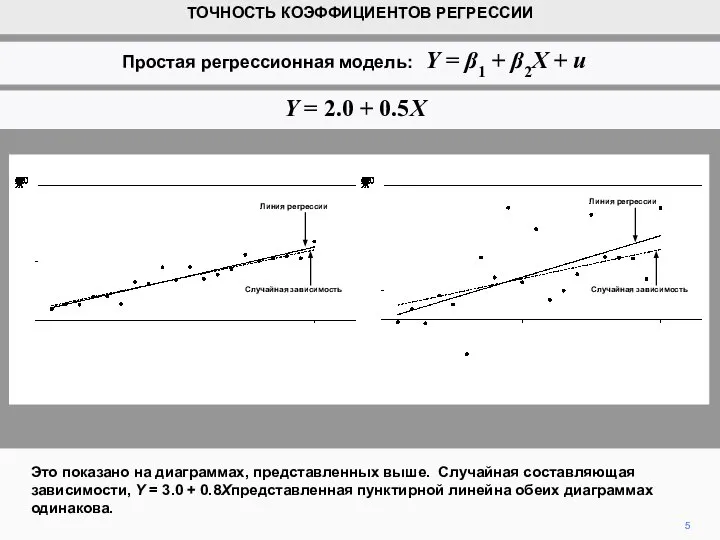

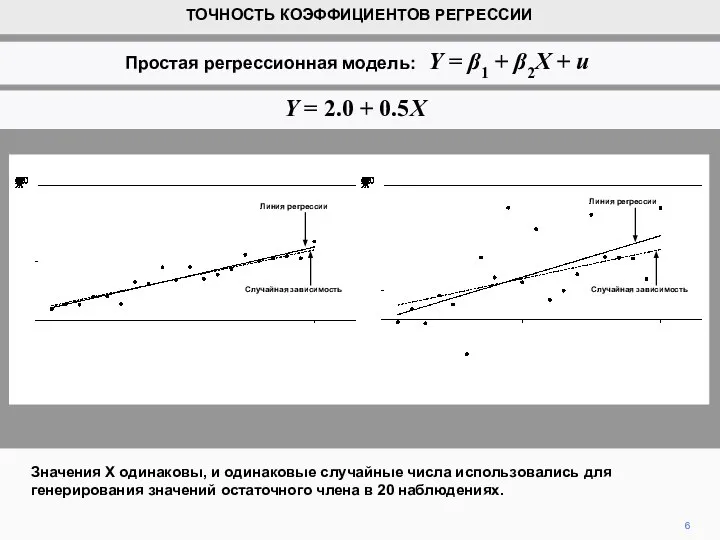

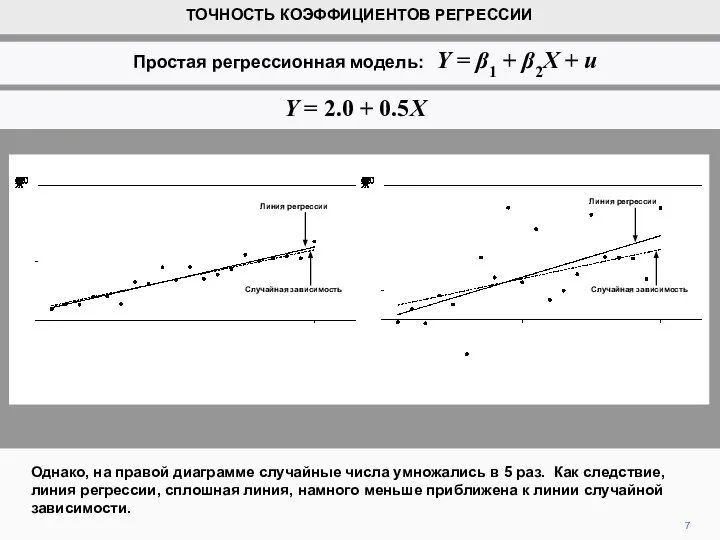

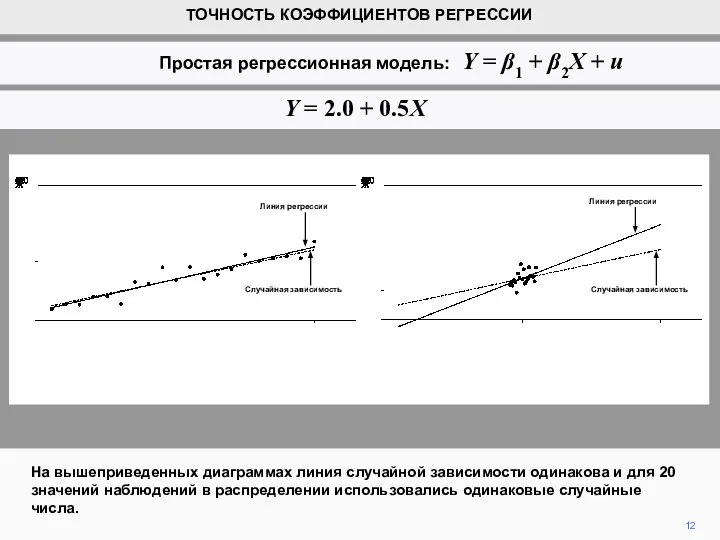

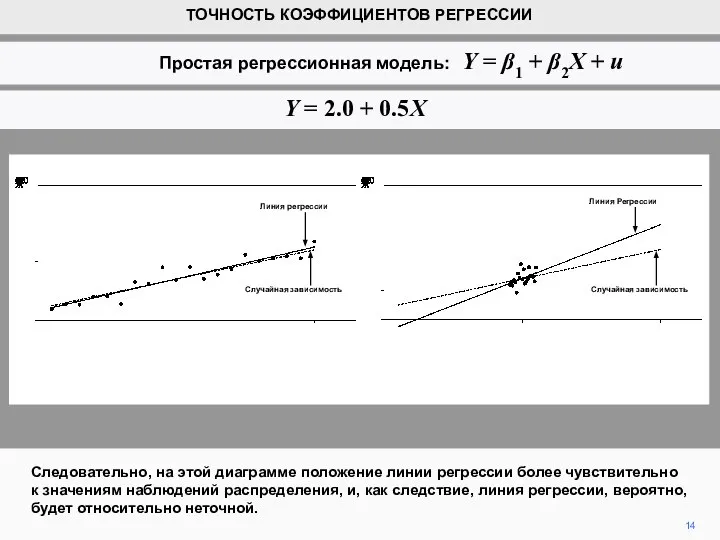

- 5. Это показано на диаграммах, представленных выше. Случайная составляющая зависимости, Y = 3.0 + 0.8Xпредставленная пунктирной линейна

- 6. Значения Х одинаковы, и одинаковые случайные числа использовались для генерирования значений остаточного члена в 20 наблюдениях.

- 7. Однако, на правой диаграмме случайные числа умножались в 5 раз. Как следствие, линия регрессии, сплошная линия,

- 8. Посмотрим на знаменатель выражения для дисперсии b2Чем больше сумма квадратов отклонений X, тем меньше дисперсия b2.

- 9. Однако, значение суммы квадратов отклонений зависит от двух факторов: количества наблюдений и размера отклонений Xi от

- 10. Из приведенного выражения видно, что дисперсия b2 обратно пропорциональна n, числу наблюдений в выборке, которые управляют

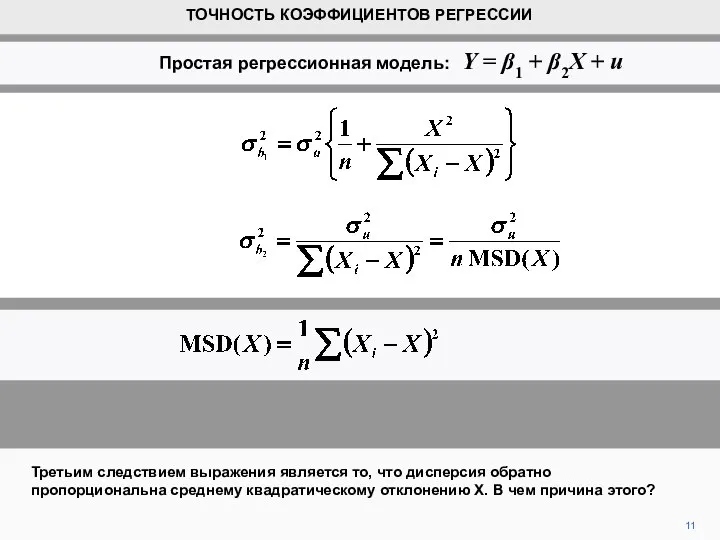

- 11. 11 Третьим следствием выражения является то, что дисперсия обратно пропорциональна среднему квадратическому отклонению Х. В чем

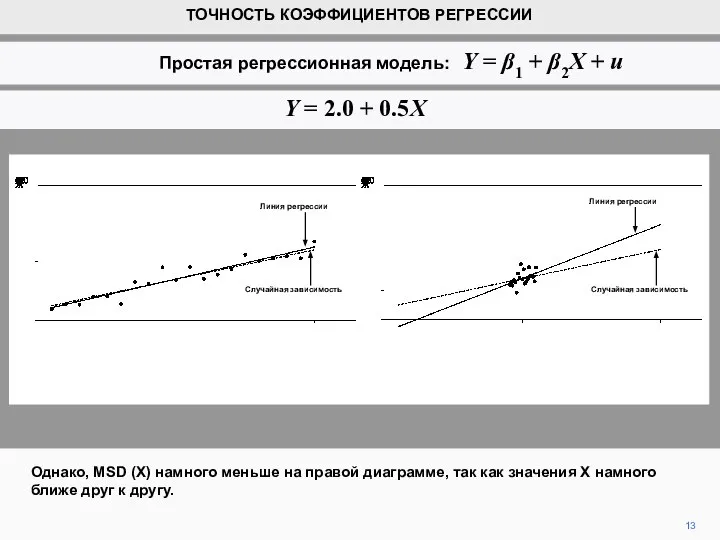

- 12. На вышеприведенных диаграммах линия случайной зависимости одинакова и для 20 значений наблюдений в распределении использовались одинаковые

- 13. Однако, MSD (X) намного меньше на правой диаграмме, так как значения Х намного ближе друг к

- 14. Следовательно, на этой диаграмме положение линии регрессии более чувствительно к значениям наблюдений распределения, и, как следствие,

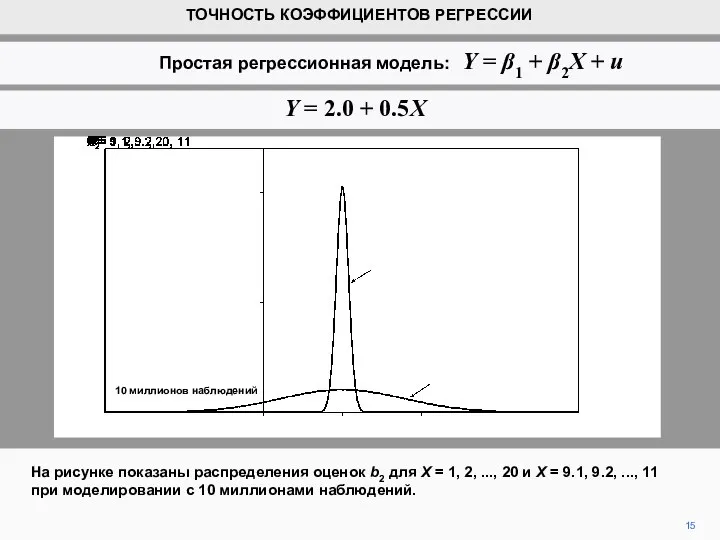

- 15. На рисунке показаны распределения оценок b2 для X = 1, 2, ..., 20 и X =

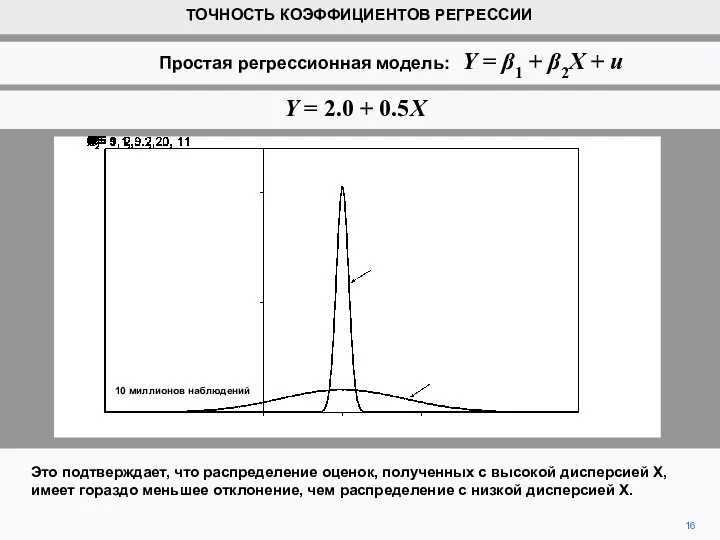

- 16. Это подтверждает, что распределение оценок, полученных с высокой дисперсией Х, имеет гораздо меньшее отклонение, чем распределение

- 17. Конечно, как видно из выражений дисперсии, отношение MSD (X) к дисперсии u важнее, чем ее абсолютное

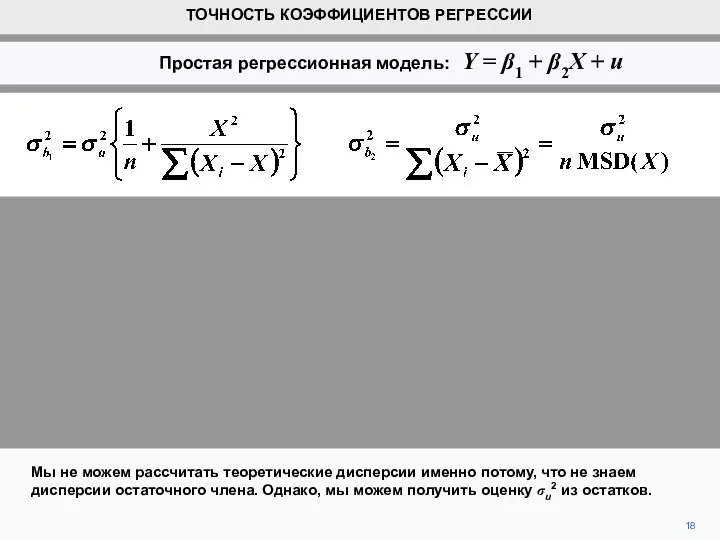

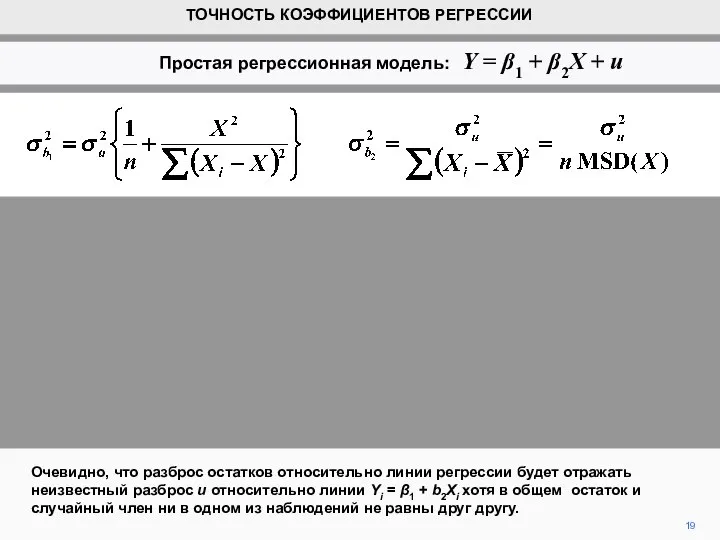

- 18. 18 Мы не можем рассчитать теоретические дисперсии именно потому, что не знаем дисперсии остаточного члена. Однако,

- 19. 19 Очевидно, что разброс остатков относительно линии регрессии будет отражать неизвестный разброс u относительно линии Yi

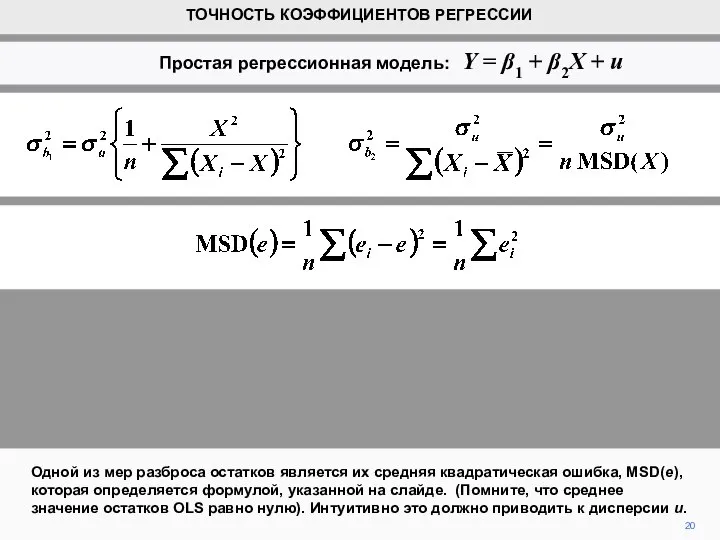

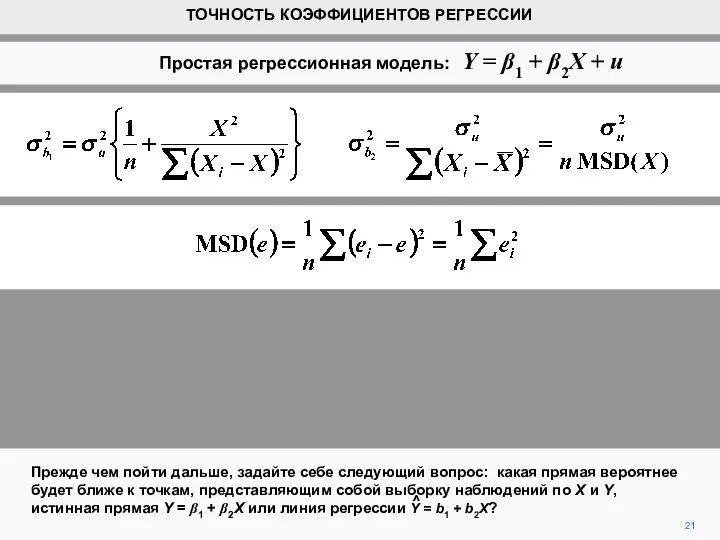

- 20. 20 Одной из мер разброса остатков является их средняя квадратическая ошибка, MSD(e), которая определяется формулой, указанной

- 21. 21 Прежде чем пойти дальше, задайте себе следующий вопрос: какая прямая вероятнее будет ближе к точкам,

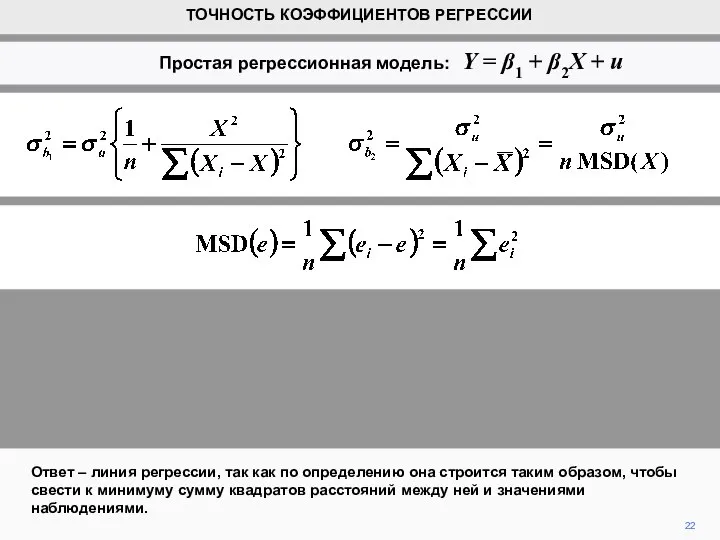

- 22. 22 Ответ – линия регрессии, так как по определению она строится таким образом, чтобы свести к

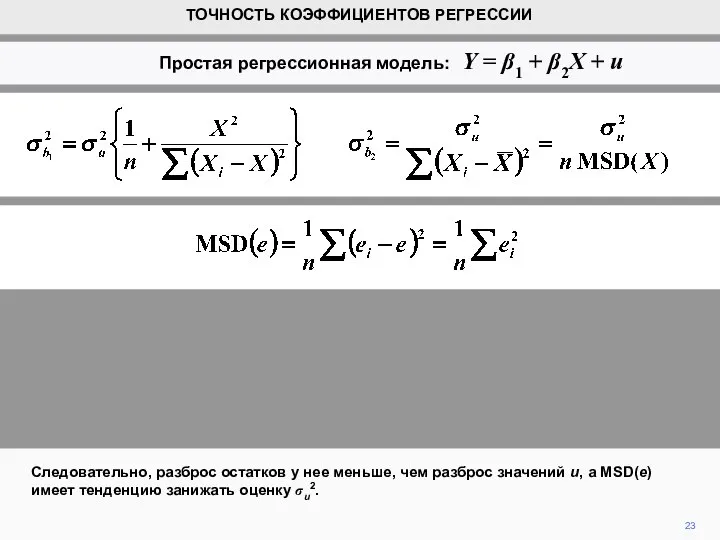

- 23. 23 Следовательно, разброс остатков у нее меньше, чем разброс значений u, а MSD(e) имеет тенденцию занижать

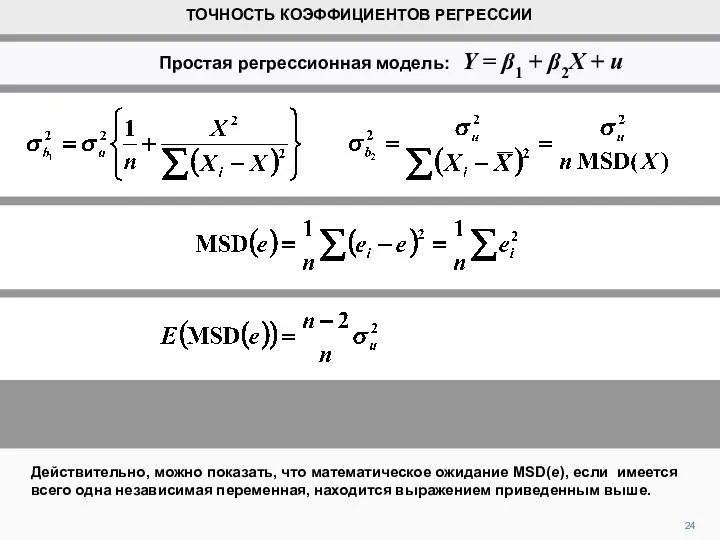

- 24. 24 Действительно, можно показать, что математическое ожидание MSD(e), если имеется всего одна независимая переменная, находится выражением

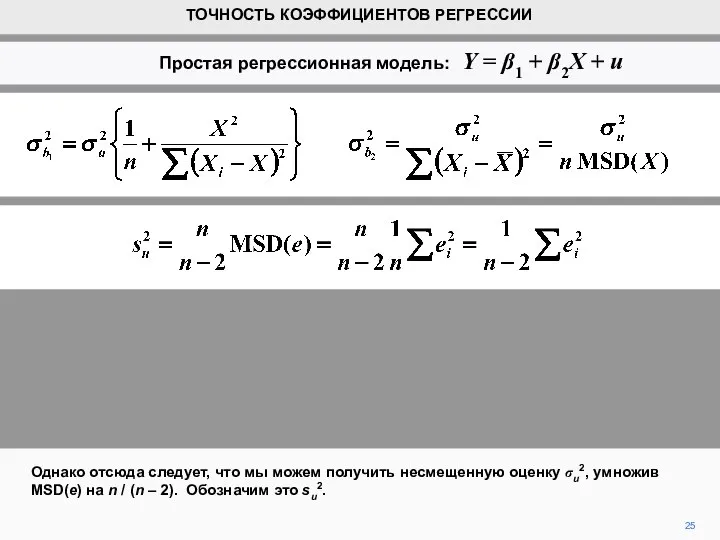

- 25. 25 Однако отсюда следует, что мы можем получить несмещенную оценку σu2, умножив MSD(e) на n /

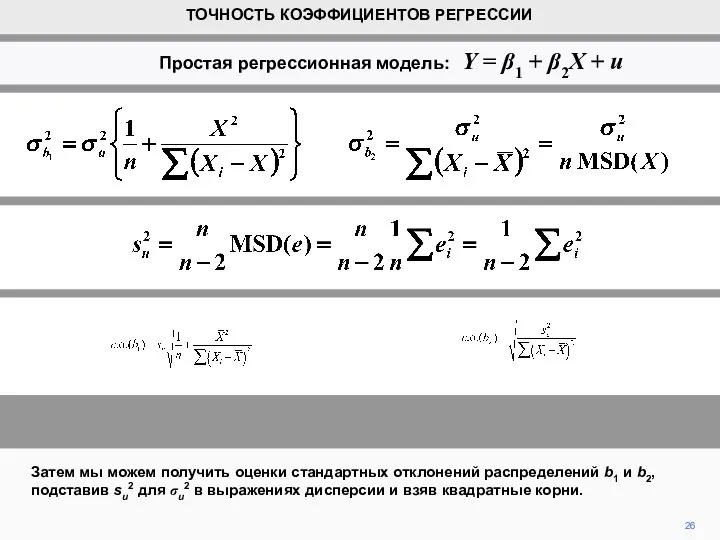

- 26. 26 Затем мы можем получить оценки стандартных отклонений распределений b1 и b2, подставив su2 для σu2

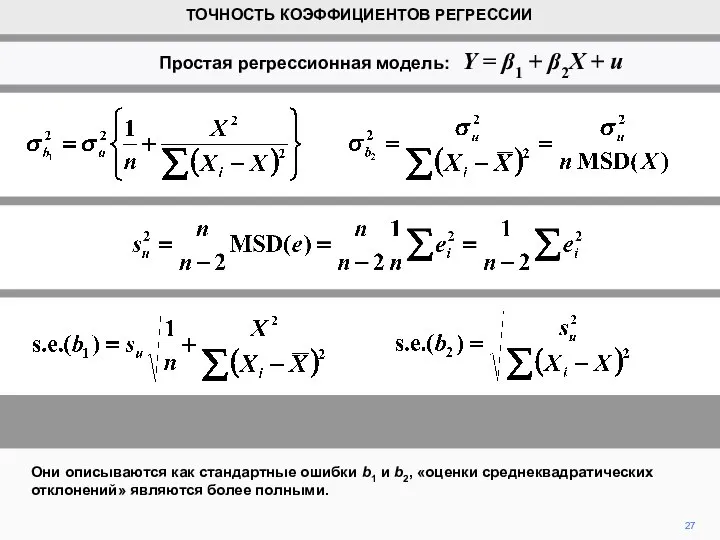

- 27. 27 Они описываются как стандартные ошибки b1 и b2, «оценки среднеквадратических отклонений» являются более полными. ТОЧНОСТЬ

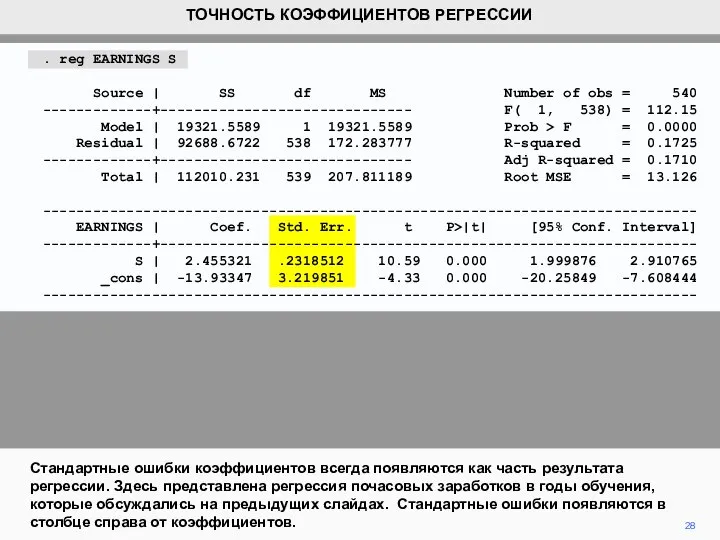

- 28. 28 Стандартные ошибки коэффициентов всегда появляются как часть результата регрессии. Здесь представлена регрессия почасовых заработков в

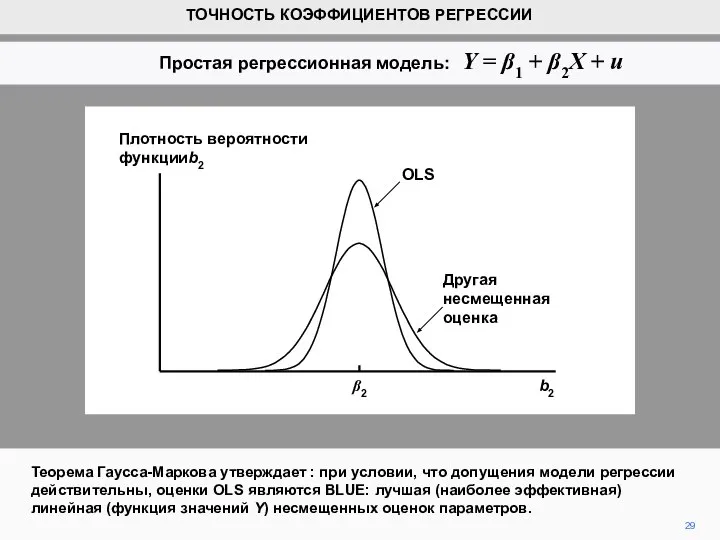

- 29. Теорема Гаусса-Маркова утверждает : при условии, что допущения модели регрессии действительны, оценки OLS являются BLUE: лучшая

- 31. Скачать презентацию

Программное обеспечение компьютера

Программное обеспечение компьютера Обработка фотографий в Lightroom

Обработка фотографий в Lightroom Презентация на тему Безопасность в сети интернет для 5-6 классов

Презентация на тему Безопасность в сети интернет для 5-6 классов  Создание коллажей. Работа со слоями на изображениях. Урок 20

Создание коллажей. Работа со слоями на изображениях. Урок 20 Универсальность цифрового представления информации

Универсальность цифрового представления информации Культура, этика и практика масс-медиа. Современная журналистика

Культура, этика и практика масс-медиа. Современная журналистика Объекты в JavaScript, их свойства и методы

Объекты в JavaScript, их свойства и методы Проектирование программных систем

Проектирование программных систем Ithub-1. Поиск утечек персональных данных

Ithub-1. Поиск утечек персональных данных Cvičení 6 4IZ110 - Informační a komunikační technologie

Cvičení 6 4IZ110 - Informační a komunikační technologie Разработка программного продукта по предметной области, автоматизированная работа предприятия ОАО ФСК ЕЭС Верхне-Донское ПМЭС

Разработка программного продукта по предметной области, автоматизированная работа предприятия ОАО ФСК ЕЭС Верхне-Донское ПМЭС Виртуальная экскурсия. Основные преимущества и недостатки

Виртуальная экскурсия. Основные преимущества и недостатки Файлообменник

Файлообменник Создание конференции в Skype

Создание конференции в Skype Системы счисления. Математические основы информатики

Системы счисления. Математические основы информатики Дорожные знаки. Запрещающие знаки

Дорожные знаки. Запрещающие знаки Уровни и типы требований

Уровни и типы требований Основы самоорганизующихся сетей

Основы самоорганизующихся сетей Проектирование реляционных баз данных на основе принципов нормализации, с использованием семантических моделей

Проектирование реляционных баз данных на основе принципов нормализации, с использованием семантических моделей Текстовые документы и технологии их создания

Текстовые документы и технологии их создания Локальные компьютерные сети

Локальные компьютерные сети Анализ соцсети

Анализ соцсети Программное обеспечение. Виртуальные машины

Программное обеспечение. Виртуальные машины Принципы построения функций, используемы в криптографических системах

Принципы построения функций, используемы в криптографических системах Одномерные массивы

Одномерные массивы Разработка программных приложений. Парадигмы программирования

Разработка программных приложений. Парадигмы программирования Dzień dobry, proszę o wykonanie polecenia z opisu, na tej podstawie otrzymają

Dzień dobry, proszę o wykonanie polecenia z opisu, na tej podstawie otrzymają Закрепление материала о документах Microsoft Word

Закрепление материала о документах Microsoft Word