Содержание

- 2. Задачи интеллектуального анализа данных Задачи ИАД Описательные Ассоциативные правила Кластеризация Классификация Прогнозирование Предсказательные

- 3. Введение Задача кластеризации состоит в разделении исследуемого множества объектов на группы «похожих» объектов, называемых кластерами Решение

- 4. Кластеризация отличается от классификации тем, что этап обучения на примерах отсутствует В задачах классификации множество классов

- 5. Задача кластеризации часто решается на начальных этапах исследования, когда о данных мало что известно Ее решение

- 6. ПРИМЕР –кластеризация результатов поиска

- 8. Формальная постановка задачи Дано множество данных, состоящее из N объектов (векторов): S1, S2, …, SN Каждый

- 9. Формальная постановка задачи Таким образом, i-й объект можно записать в виде: Si = (xi1, xi2, …,

- 10. Формальная постановка задачи Требуется: найти способ сравнения d(Sp, Sq) объектов между собой (меру сходства, функцию расстояния)

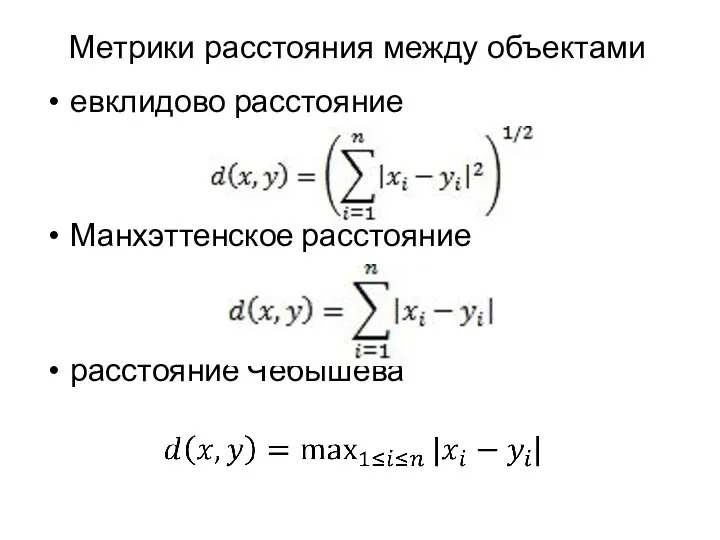

- 11. евклидово расстояние Манхэттенское расстояние расстояние Чебышева Метрики расстояния между объектами

- 12. Методы кластерного анализа можно разделить на две группы: неиерархические иерархические

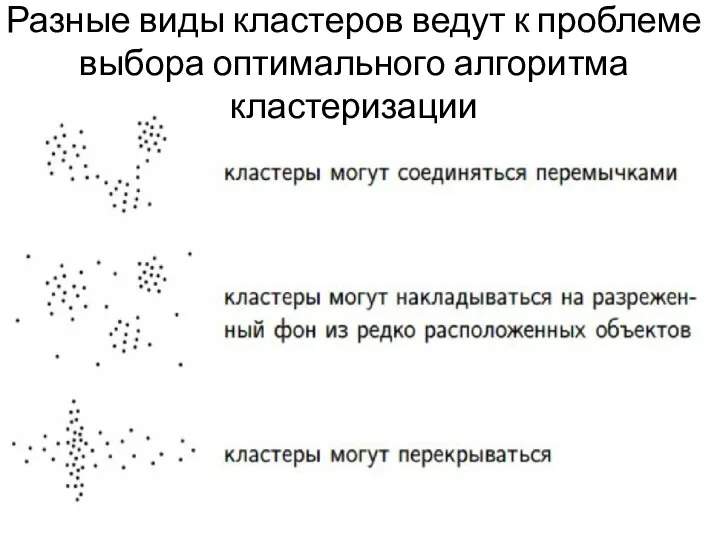

- 13. Виды кластеров Внутрикластерные расстояния, как правило, меньше межкластерных Но бывают ленточные кластеры, в которых внутрикластерные расстояния

- 14. Разные виды кластеров ведут к проблеме выбора оптимального алгоритма кластеризации

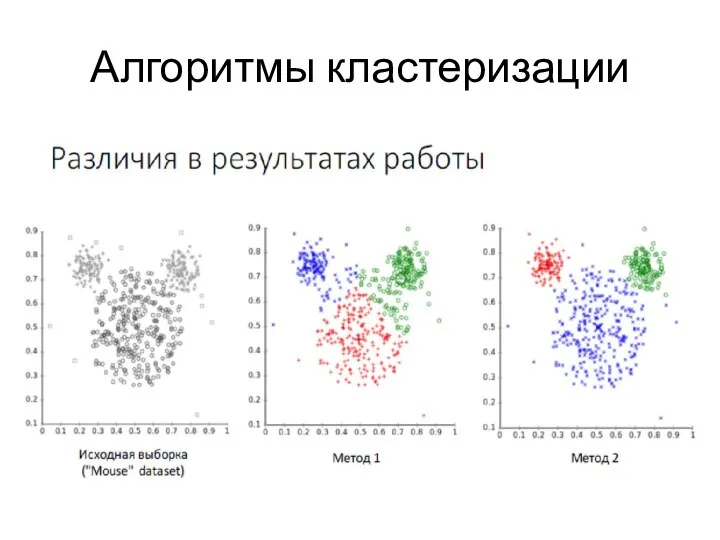

- 15. Алгоритмы кластеризации

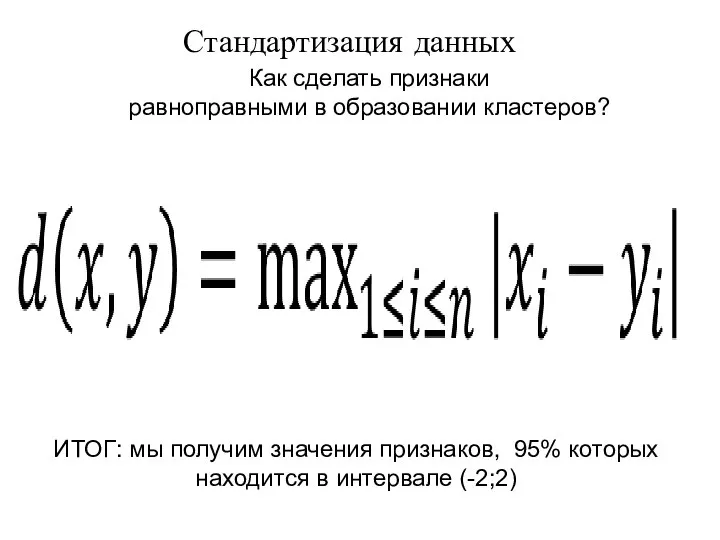

- 16. Как сделать признаки равноправными в образовании кластеров? ИТОГ: мы получим значения признаков, 95% которых находится в

- 17. Метод k-средних Неиерархическим методом кластеризации является метод k-средних (k-means) Предварительно необходимо выбрать вероятное число кластеров k

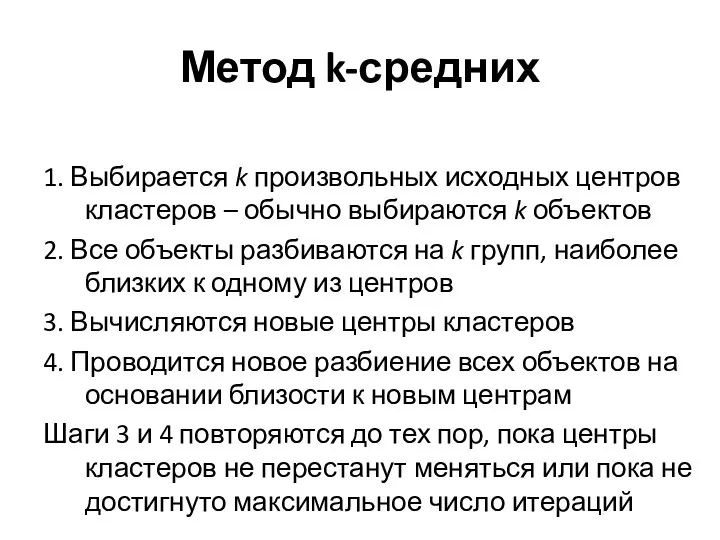

- 18. Метод k-средних 1. Выбирается k произвольных исходных центров кластеров – обычно выбираются k объектов 2. Все

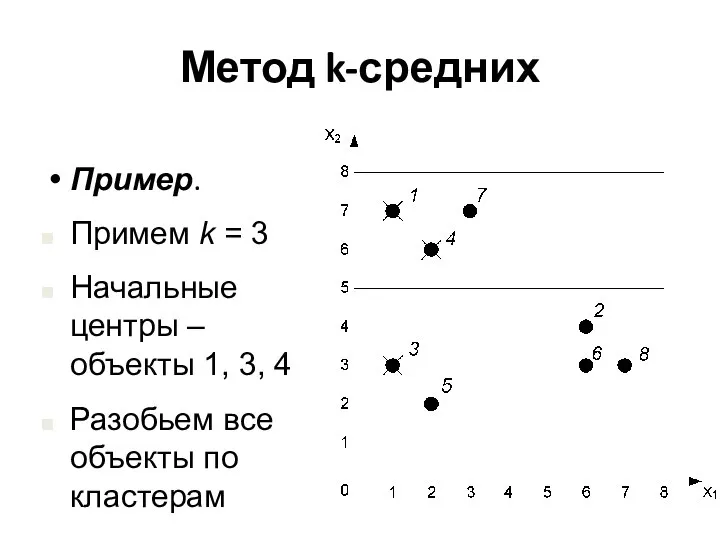

- 19. Метод k-средних Пример. Примем k = 3 Начальные центры – объекты 1, 3, 4 Разобьем все

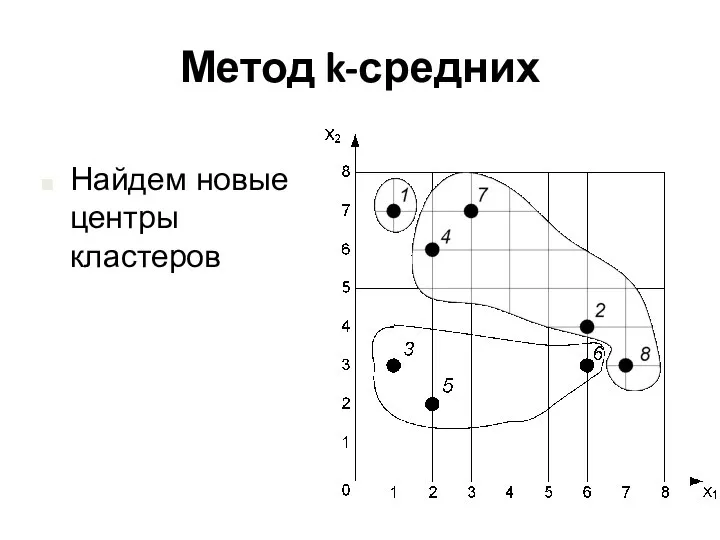

- 20. Метод k-средних Найдем новые центры кластеров

- 21. Метод k-средних Найдем новые центры кластеров

- 22. Метод k-средних Разобьем все объекты по новым кластерам, относя каждый объект к кластеру с ближайшим центром

- 23. Метод k-средних Пересчитаем центры кластеров. Дальнейшая разбивка объектов по новым кластерам не меняет расположение центров

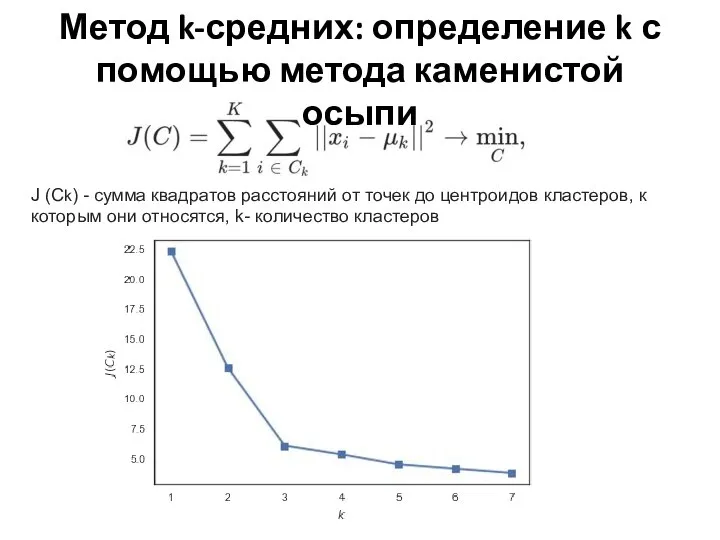

- 24. Метод k-средних: определение k с помощью метода каменистой осыпи J (Ck) - сумма квадратов расстояний от

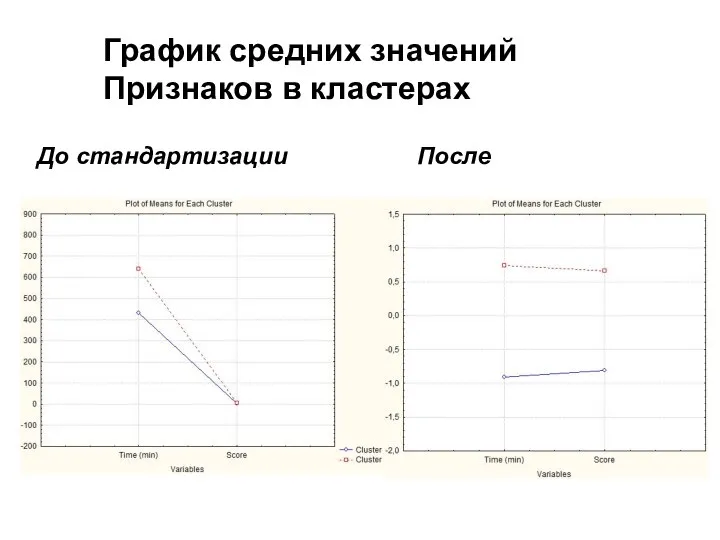

- 25. До стандартизации После График средних значений Признаков в кластерах

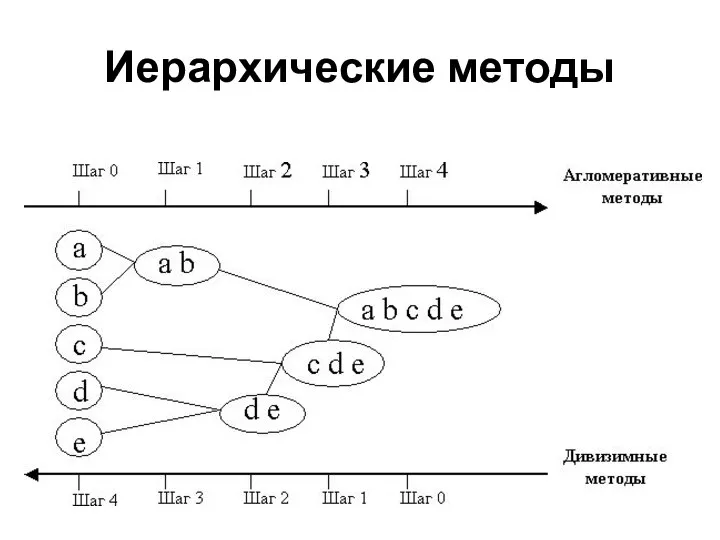

- 26. Иерархические методы К иерархическим методам кластеризации относятся: агломеративный алгоритмы дивизимный алгоритмы

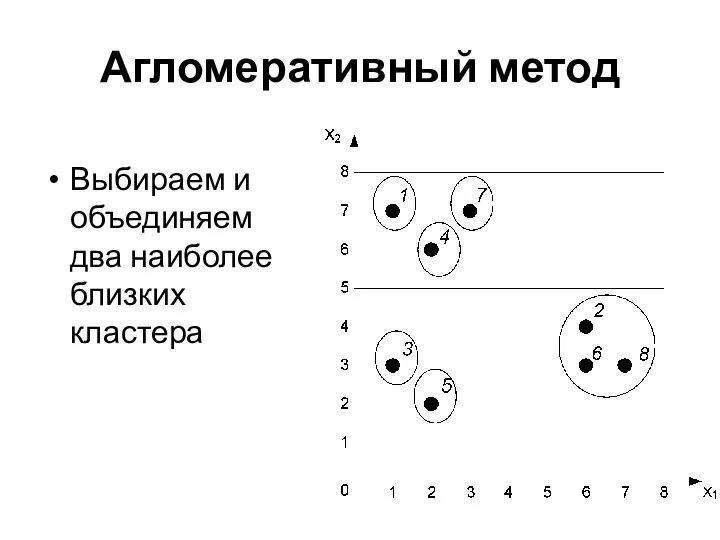

- 27. Агломеративный метод В начале работы алгоритма все объекты являются отдельными кластерами На первом шаге наиболее похожие

- 28. Метод ближайшего соседа (одиночная связь, Single linkage). Расстояние между двумя кластерами определяется расстоянием между двумя наиболее

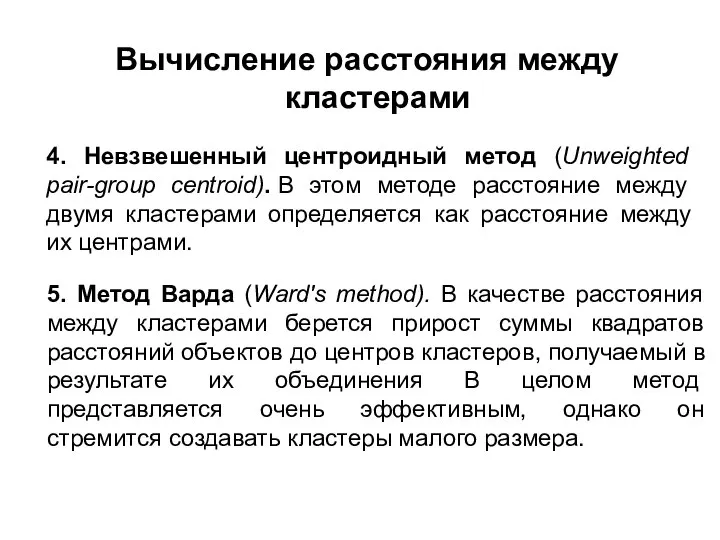

- 29. 4. Невзвешенный центроидный метод (Unweighted pair-group centroid). В этом методе расстояние между двумя кластерами определяется как

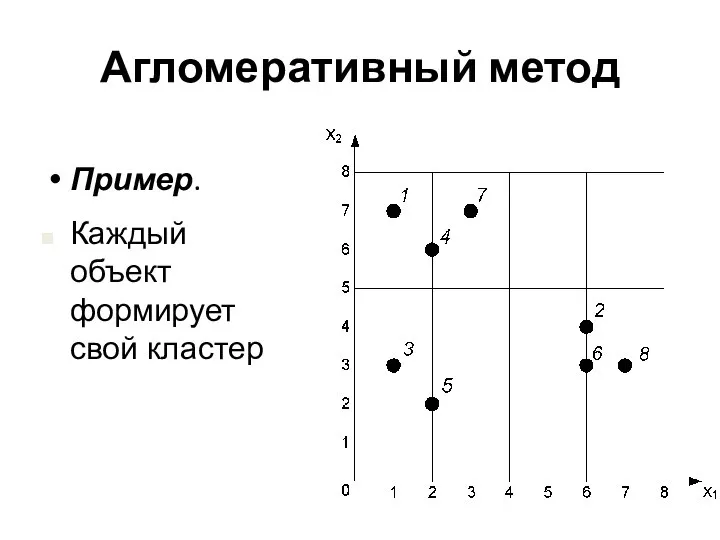

- 30. Агломеративный метод Пример. Каждый объект формирует свой кластер

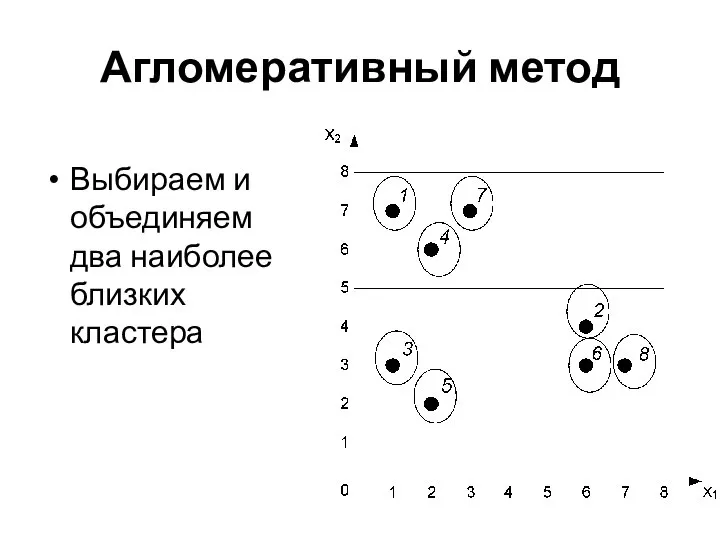

- 31. Агломеративный метод Выбираем и объединяем два наиболее близких кластера

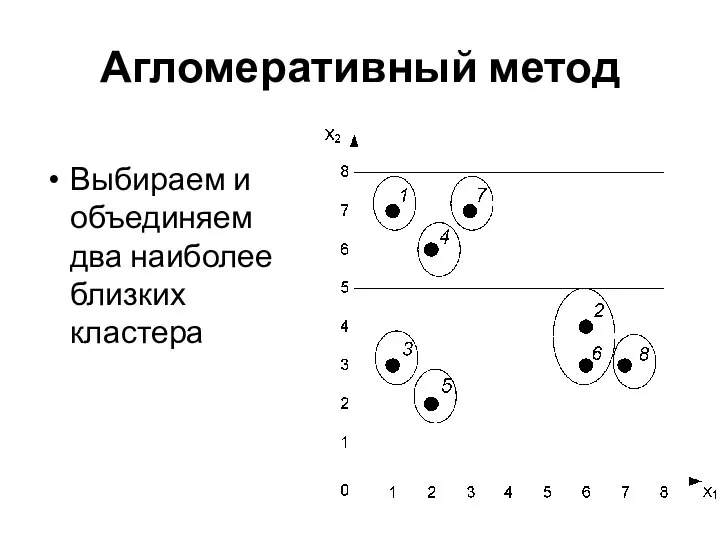

- 32. Агломеративный метод Выбираем и объединяем два наиболее близких кластера

- 33. Агломеративный метод Выбираем и объединяем два наиболее близких кластера

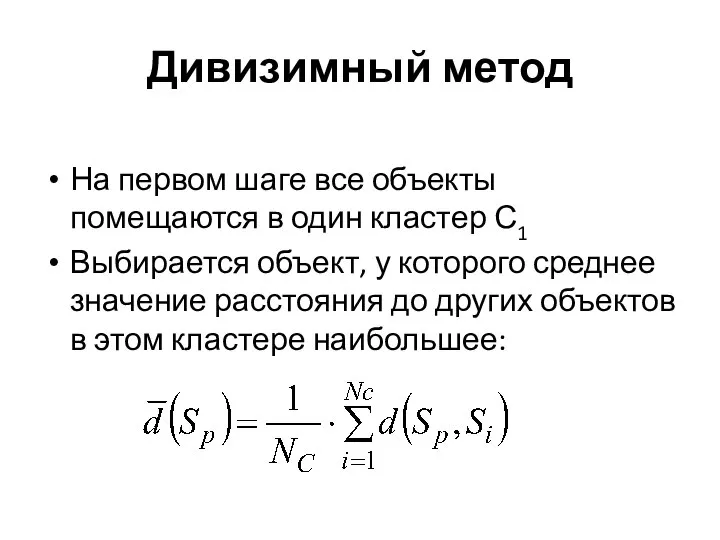

- 34. Дивизимный метод На первом шаге все объекты помещаются в один кластер С1 Выбирается объект, у которого

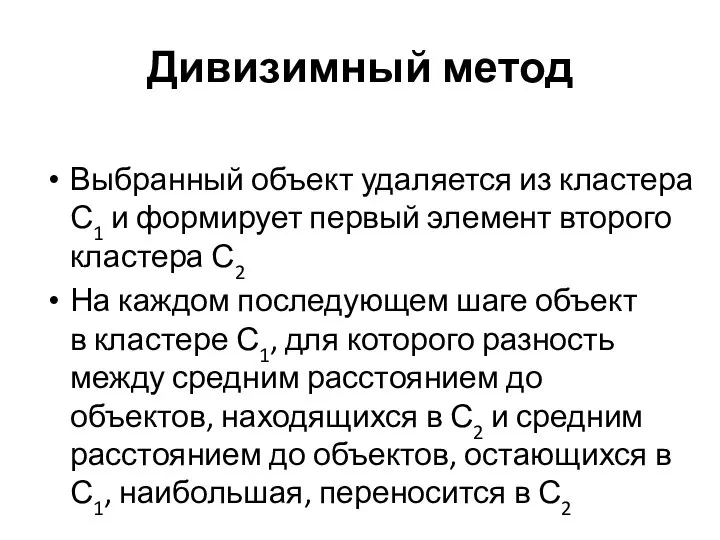

- 35. Дивизимный метод Выбранный объект удаляется из кластера С1 и формирует первый элемент второго кластера С2 На

- 36. Дивизимный метод В результате один кластер делится на два дочерних, один из которых расщепляется на следующем

- 37. Иерархические методы

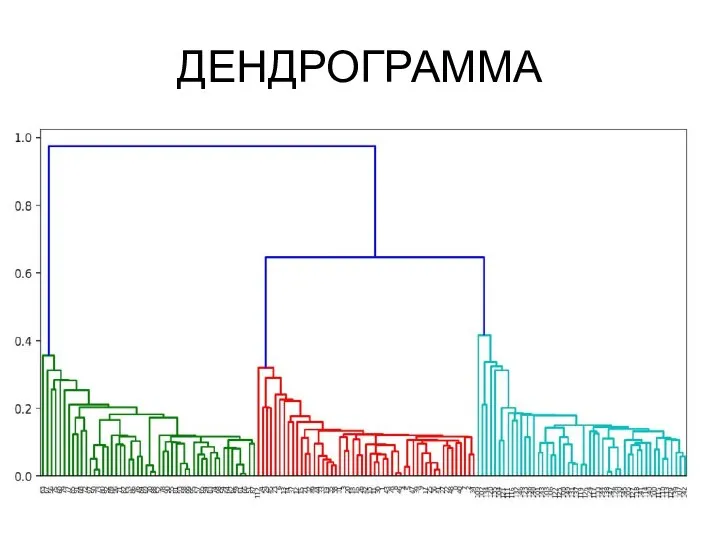

- 38. ДЕНДРОГРАММА

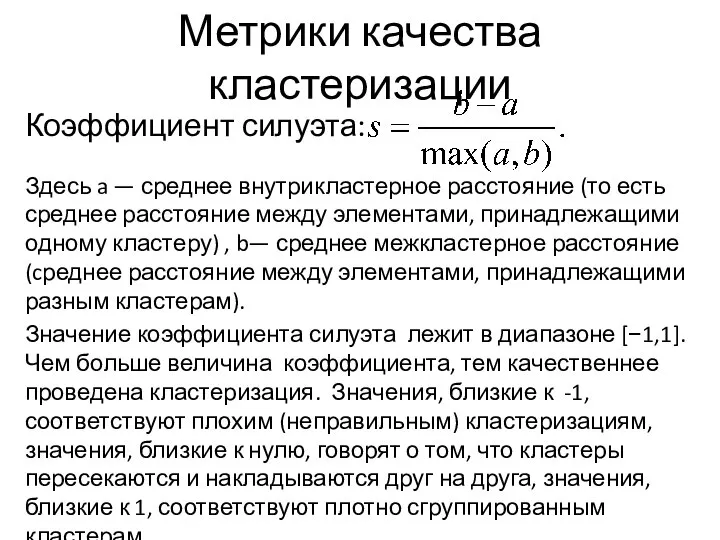

- 39. Метрики качества кластеризации Коэффициент силуэта: Здесь a — среднее внутрикластерное расстояние (то есть среднее расстояние между

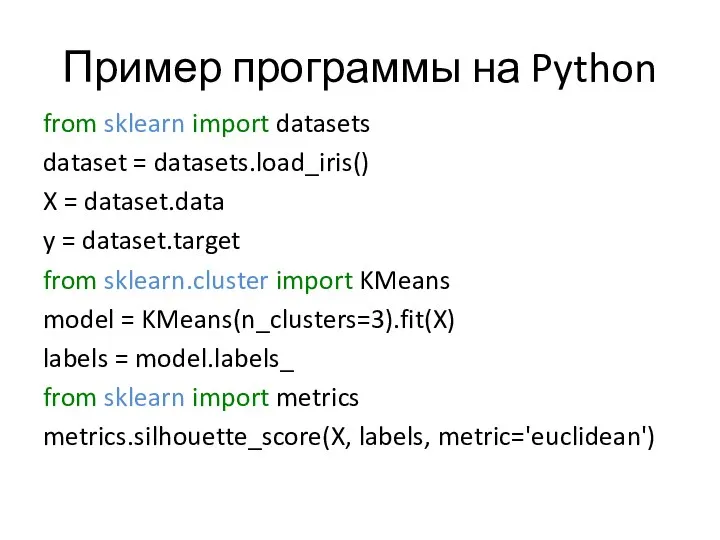

- 40. Пример программы на Python from sklearn import datasets dataset = datasets.load_iris() X = dataset.data y =

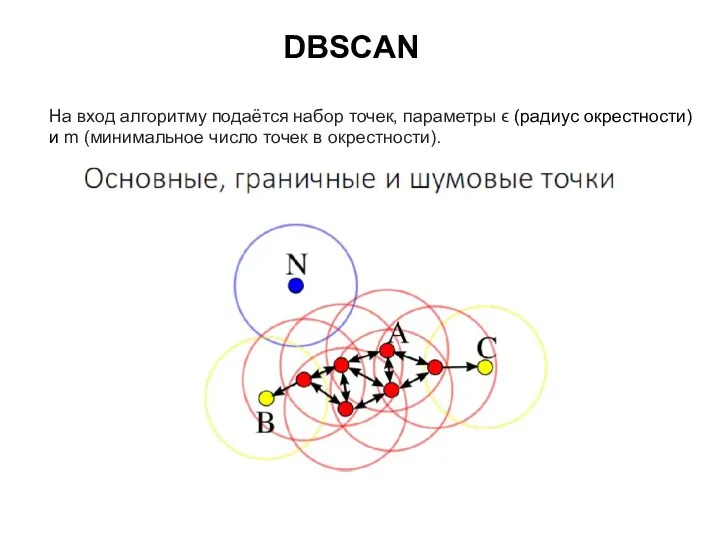

- 41. DBSCAN На вход алгоритму подаётся набор точек, параметры ϵ (радиус окрестности) и m (минимальное число точек

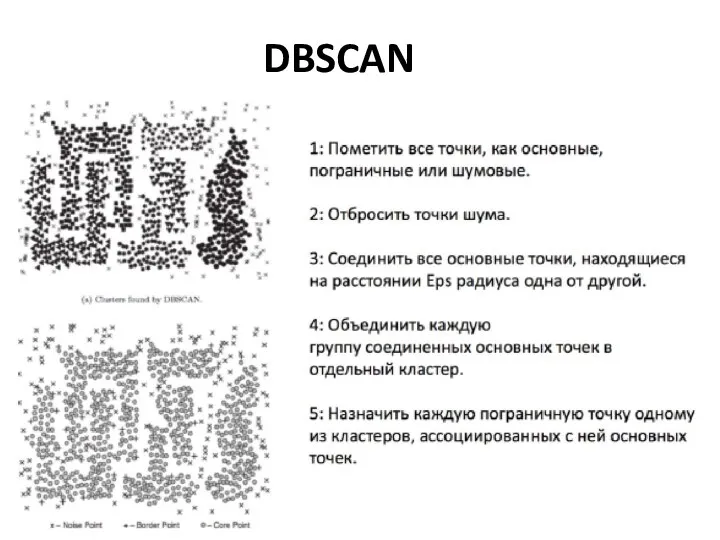

- 42. DBSCAN

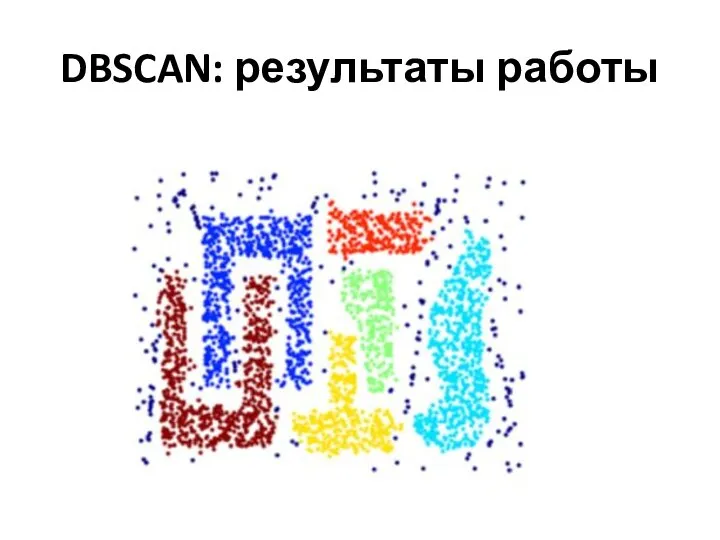

- 43. DBSCAN: результаты работы

- 45. Скачать презентацию

Решение задач составлением систем уравнений с двумя переменными

Решение задач составлением систем уравнений с двумя переменными Свойства параллелограмма

Свойства параллелограмма Плоскости

Плоскости Измерение углов.Транспортир

Измерение углов.Транспортир Преобразование иррациональных выражений

Преобразование иррациональных выражений Критерий ранговой корреляции Спирмена

Критерий ранговой корреляции Спирмена Основы тригонометрии. Радианная мера угла. Вращательное движение точки вокруг начла координат

Основы тригонометрии. Радианная мера угла. Вращательное движение точки вокруг начла координат Занимательная математика. Числовая окружность

Занимательная математика. Числовая окружность Непрерывность функций

Непрерывность функций Признаки параллельности прямых

Признаки параллельности прямых Статистическое изучение связей между явлениями (4 часа). Тема 1.7

Статистическое изучение связей между явлениями (4 часа). Тема 1.7 Матрицы и определители

Матрицы и определители Занимательные задачи на смекалку

Занимательные задачи на смекалку Информационная безопасность. Базовые логические элементы, применяемые в вычислительной технике

Информационная безопасность. Базовые логические элементы, применяемые в вычислительной технике Теория вероятностей

Теория вероятностей Основы теории множеств

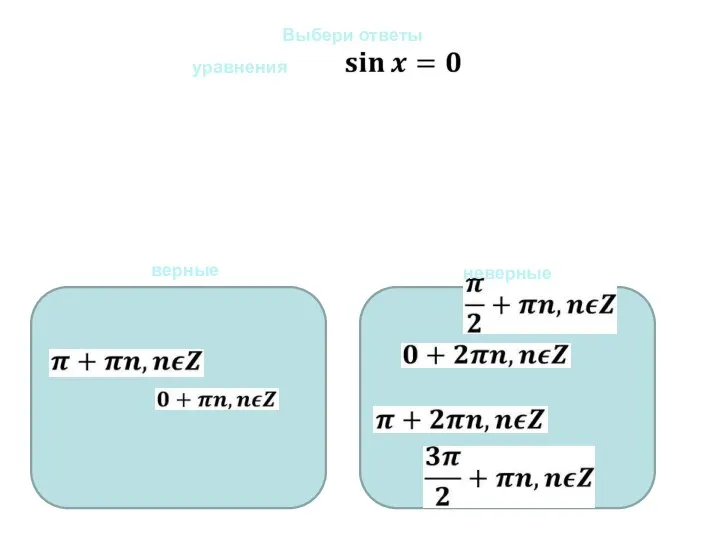

Основы теории множеств Уравнения sinx=0, cosx=0. Выберите правильный ответ

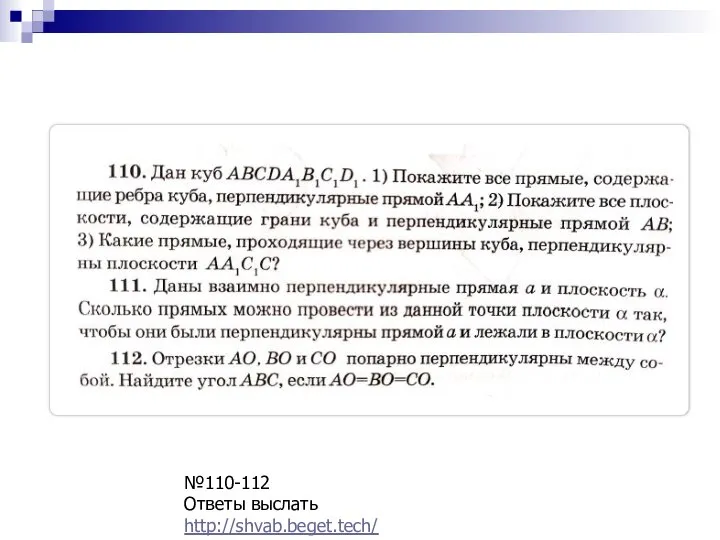

Уравнения sinx=0, cosx=0. Выберите правильный ответ Связь между параллельностью и перпендикулярностью прямых и плоскостей (Задание)

Связь между параллельностью и перпендикулярностью прямых и плоскостей (Задание) Решение иррациональных уравнений

Решение иррациональных уравнений Числові нерівності. Властивості числових нерівностей

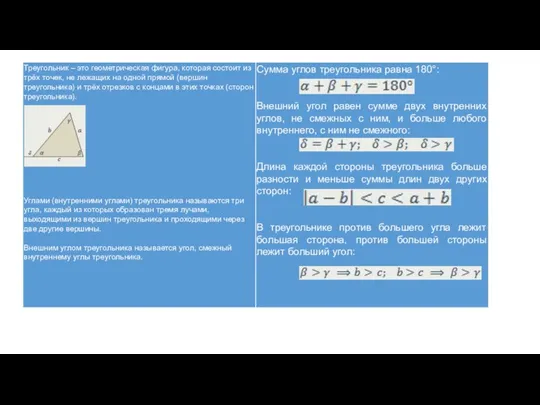

Числові нерівності. Властивості числових нерівностей Треугольники. Подобие треугольников

Треугольники. Подобие треугольников Правильные многоугольники в нашей жизни

Правильные многоугольники в нашей жизни Имитационное моделирование

Имитационное моделирование Сечение поверхности плоскостью

Сечение поверхности плоскостью Арифметика в системах счисления

Арифметика в системах счисления Средства измерительной техники

Средства измерительной техники Составление алгоритма

Составление алгоритма Уравнение прямой

Уравнение прямой