Основная терминология курса: шейдер, SM, ROP, TPC, SP. Типы параллельных архитектур: SISD, MISD, SIMD, MIMD, DSP

Содержание

- 2. Введение Схематическое изображение графического адаптера Классификация вычислительных систем по Флинну Схематическое устройство SMP Multithreading Bottleneck

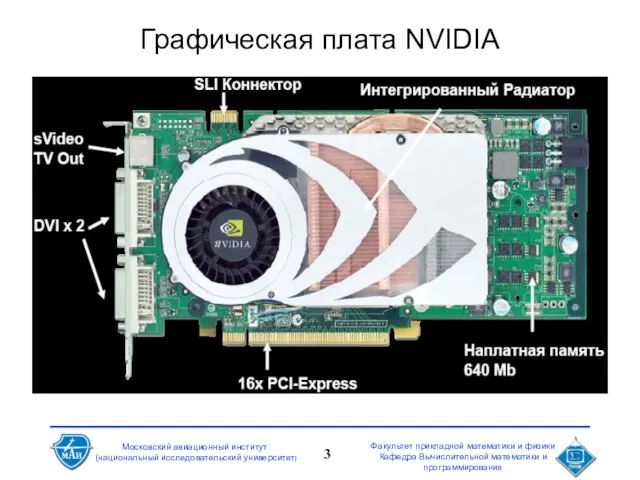

- 3. Графическая плата NVIDIA

- 4. Средства обмена данными в компьютере Обмен данными – важнейшая составляющая компьютера Примеры: многопроцессорные системы, FPGA etc.

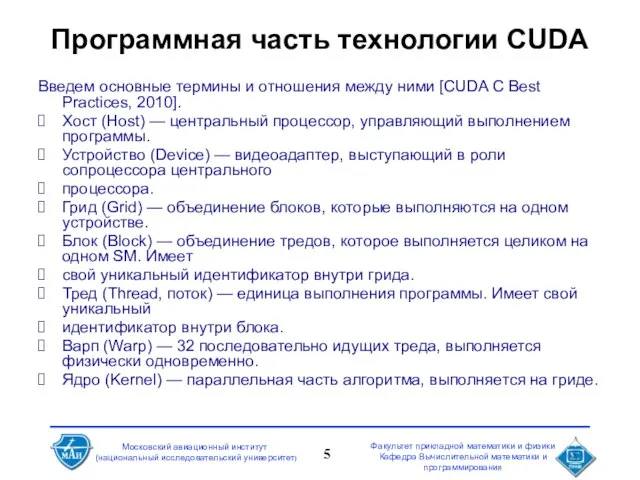

- 5. Программная часть технологии CUDA Введем основные термины и отношения между ними [CUDA C Best Practices, 2010].

- 6. Схематическое изображение графического адаптера

- 7. DSP Цифровой сигнальный процессор (англ. Digital signal processor, DSP; сигнальный микропроцессор, СМП; процессор цифровых сигналов, ПЦС)

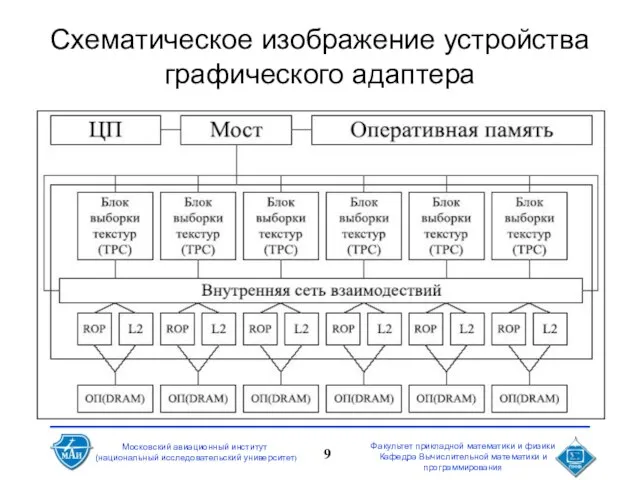

- 9. Схематическое изображение устройства графического адаптера

- 10. Схематические особенности видеочипа

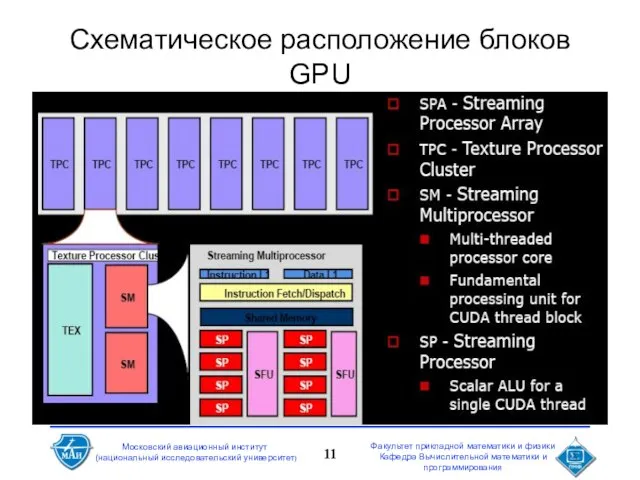

- 11. Схематическое расположение блоков GPU

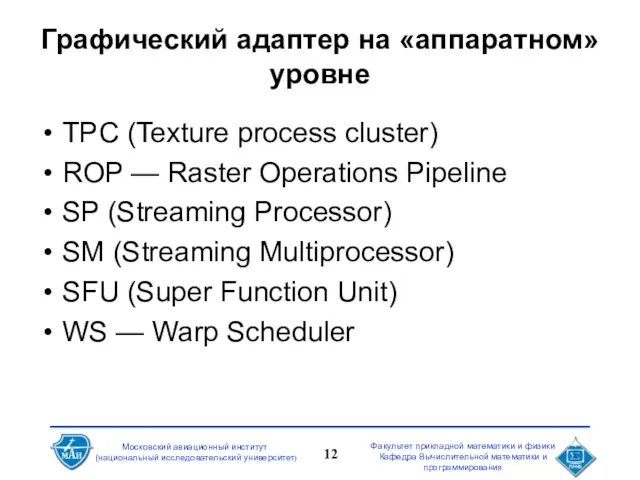

- 12. Графический адаптер на «аппаратном» уровне TPC (Texture process cluster) ROP — Raster Operations Pipeline SP (Streaming

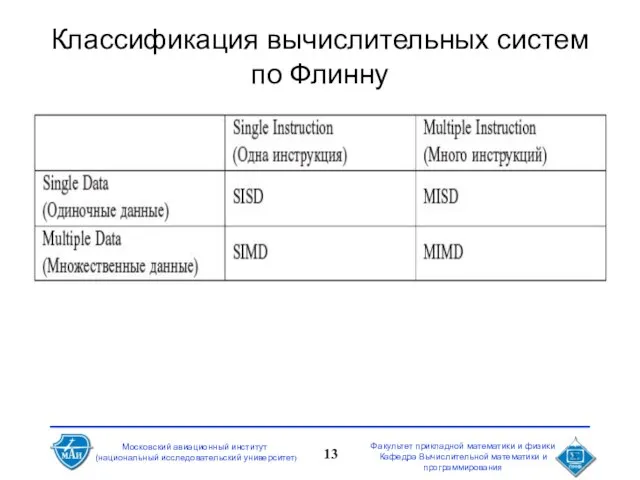

- 13. Классификация вычислительных систем по Флинну

- 14. Классы систем

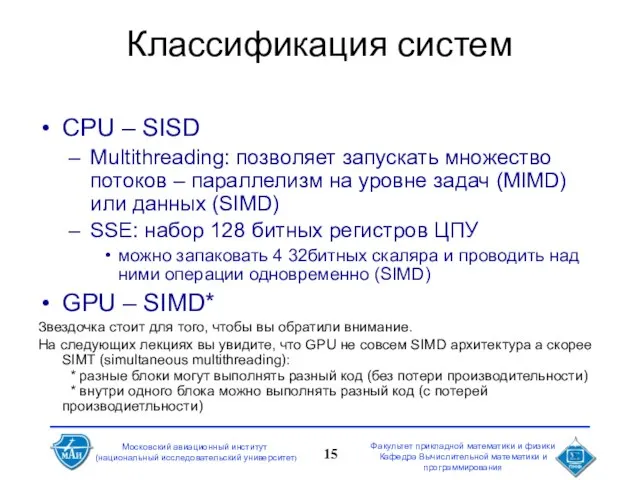

- 15. Классификация систем CPU – SISD Multithreading: позволяет запускать множество потоков – параллелизм на уровне задач (MIMD)

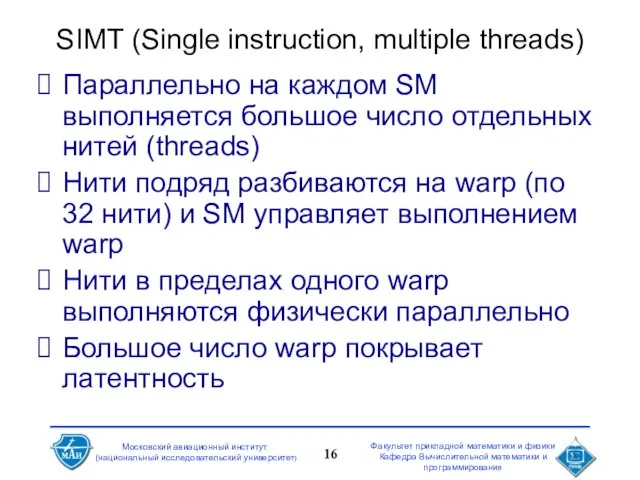

- 16. SIMT (Single instruction, multiple threads) Параллельно на каждом SM выполняется большое число отдельных нитей (threads) Нити

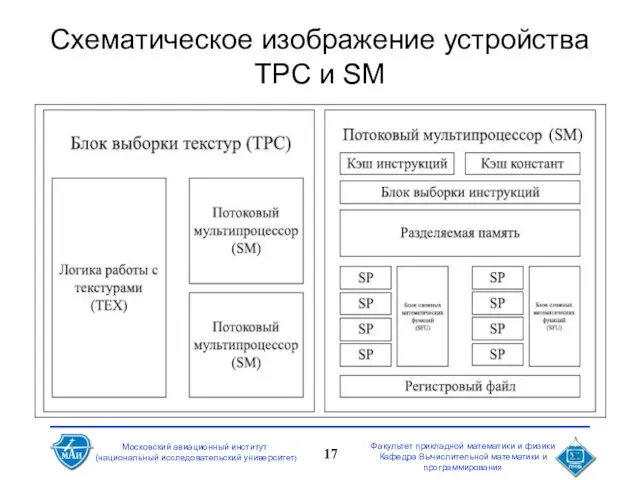

- 17. Схематическое изображение устройства TPC и SM

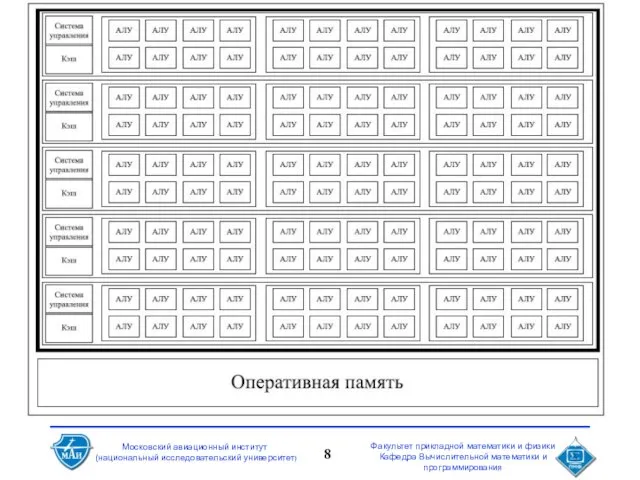

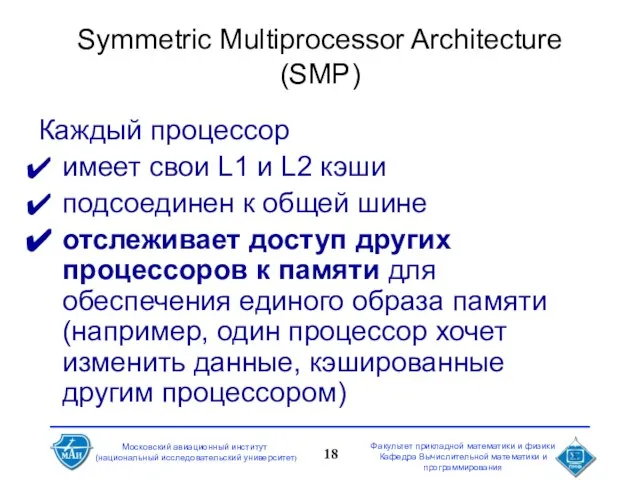

- 18. Symmetric Multiprocessor Architecture (SMP) Каждый процессор имеет свои L1 и L2 кэши подсоединен к общей шине

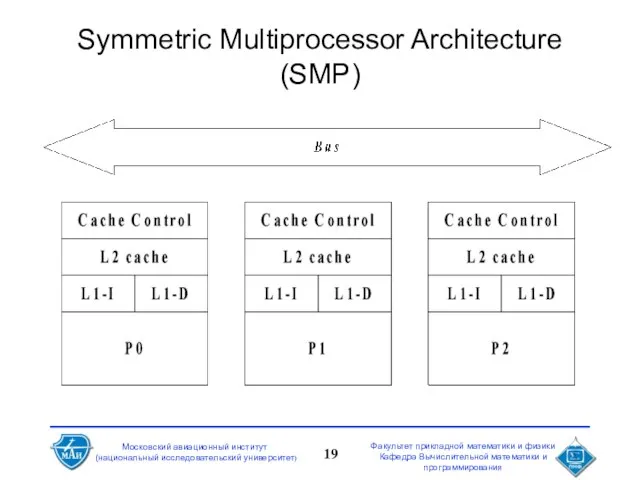

- 19. Symmetric Multiprocessor Architecture (SMP)

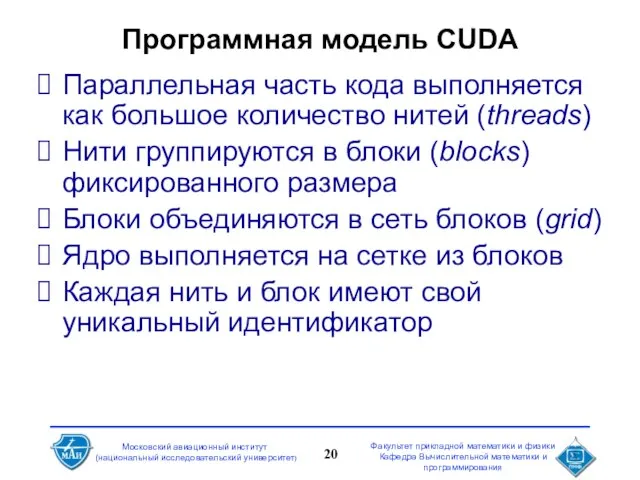

- 20. Программная модель CUDA Параллельная часть кода выполняется как большое количество нитей (threads) Нити группируются в блоки

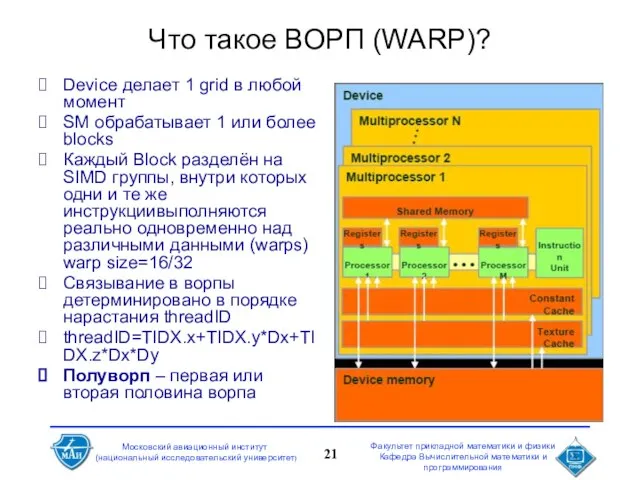

- 21. Что такое ВОРП (WARP)? Device делает 1 grid в любой момент SM обрабатывает 1 или более

- 22. Итоги лекции В результате лекции Вы должны : Понимать возможности использования GPU для расчётов с точки

- 24. Скачать презентацию

История возникновения комплексных чисел

История возникновения комплексных чисел Понятие смешанной дроби

Понятие смешанной дроби Погрешности измерений

Погрешности измерений Решение задач на увеличение числа в несколько раз

Решение задач на увеличение числа в несколько раз Прибавление числа 6 с переходом через десяток

Прибавление числа 6 с переходом через десяток Свойство описанного четырехугольника

Свойство описанного четырехугольника Проценты. 1% одна сотая часть целого

Проценты. 1% одна сотая часть целого Интерактивная игра-тренажёр. Сколько? Соотношение числа и цифры

Интерактивная игра-тренажёр. Сколько? Соотношение числа и цифры Памятка по оформлению краткой записи к задачам. 1-2 класс

Памятка по оформлению краткой записи к задачам. 1-2 класс Основы системной динамики

Основы системной динамики Проецирование правильной шестиугольной призмы

Проецирование правильной шестиугольной призмы Преобразование графиков

Преобразование графиков Викторина по геометрии

Викторина по геометрии Медианы, биссектрисы и высота треугольника

Медианы, биссектрисы и высота треугольника Косинус угла

Косинус угла Памятка по оформлению краткой записи к задачам (1 класс)

Памятка по оформлению краткой записи к задачам (1 класс) Презентация на тему Сложение и вычитание дробей с разными знаменателями

Презентация на тему Сложение и вычитание дробей с разными знаменателями  Решение задач по теме Теорема Пифагора и площади фигур. 8 класс

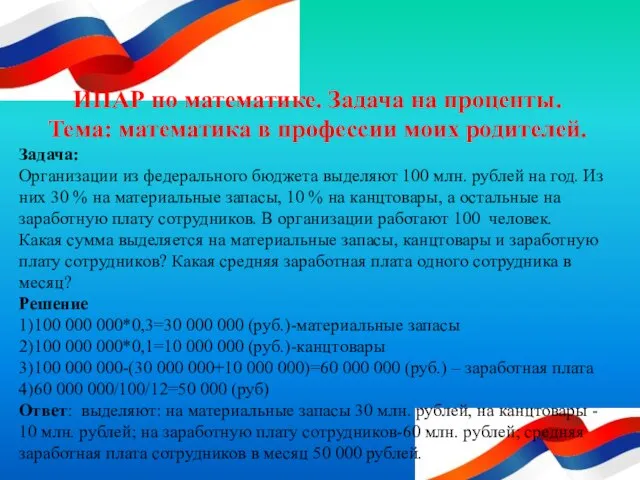

Решение задач по теме Теорема Пифагора и площади фигур. 8 класс ИПАР по математике. Задача на проценты. Тема: математика в профессии моих родителей

ИПАР по математике. Задача на проценты. Тема: математика в профессии моих родителей Игра-тренажёр Округление чисел

Игра-тренажёр Округление чисел Последовательность трехзначных чисел

Последовательность трехзначных чисел Конус

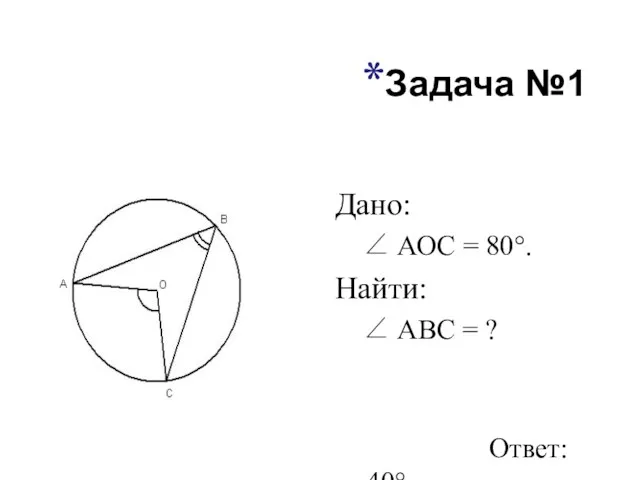

Конус Пропорциональность отрезков хорд, касательных и секущих

Пропорциональность отрезков хорд, касательных и секущих Деление. Неправильные дроби

Деление. Неправильные дроби многогранники

многогранники Подготовка к ЕГЭ 2020

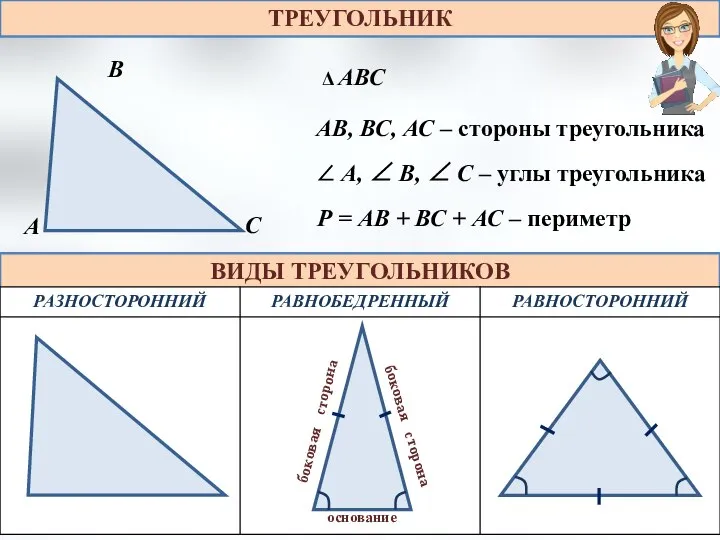

Подготовка к ЕГЭ 2020 Треугольник

Треугольник Педагогические приемы включения детей, имеющих нарушения слуха, в образовательное пространство урока математики

Педагогические приемы включения детей, имеющих нарушения слуха, в образовательное пространство урока математики