Слайд 3Постановка задачи

Если входные и выходные переменные модели непрерывные — перед нами задача

регрессии.

Если выходная переменная одна и она является дискретной (метка класса), то речь идет о задаче классификации.

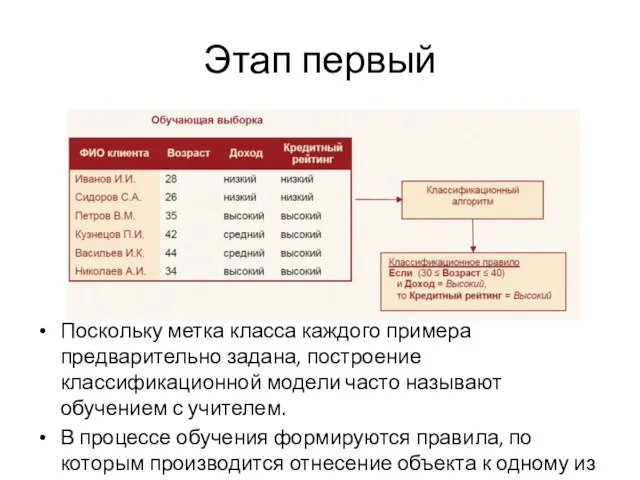

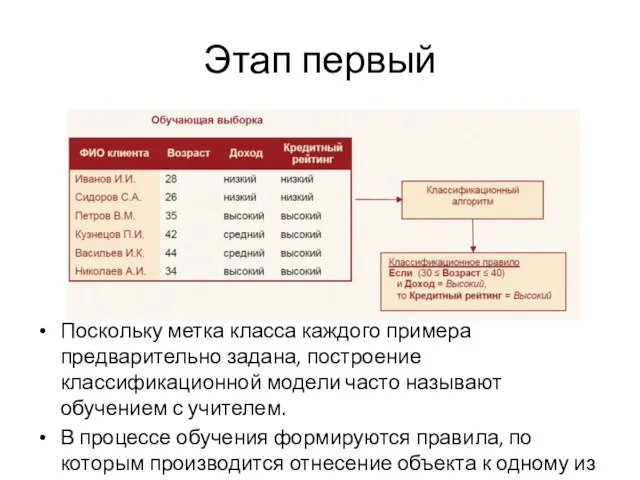

Слайд 4Этап первый

Поскольку метка класса каждого примера предварительно задана, построение классификационной модели часто

называют обучением с учителем.

В процессе обучения формируются правила, по которым производится отнесение объекта к одному из классов

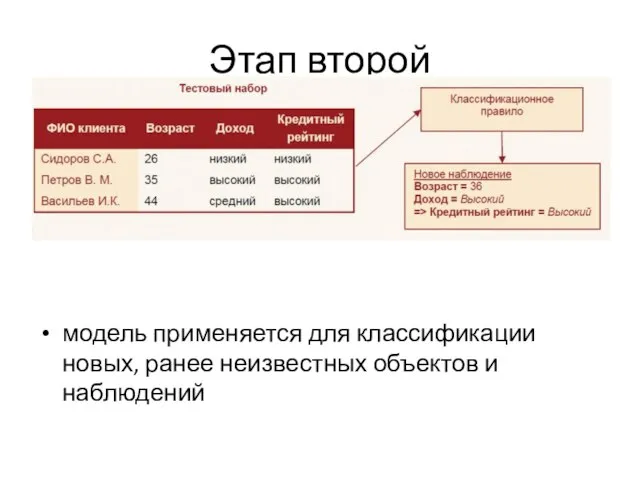

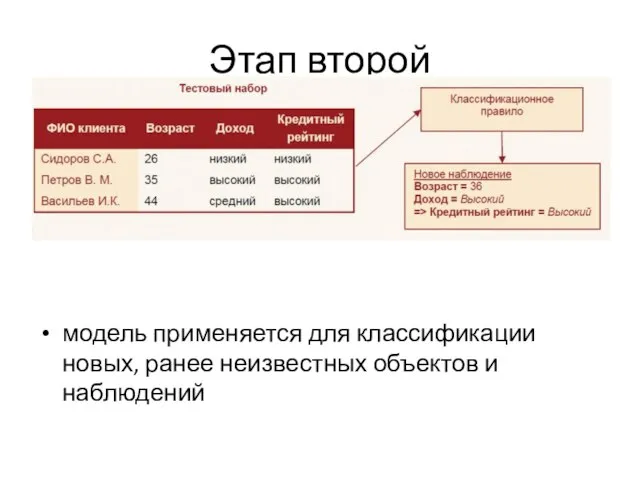

Слайд 5Этап второй

модель применяется для классификации новых, ранее неизвестных объектов и наблюдений

Слайд 6Линейная регрессия

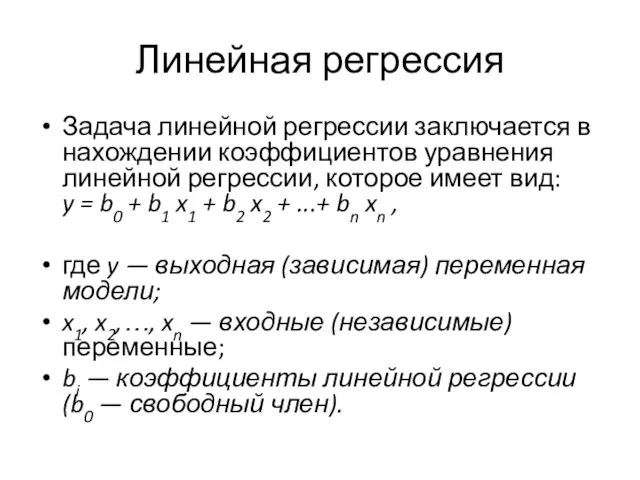

Задача линейной регрессии заключается в нахождении коэффициентов уравнения линейной регрессии, которое

имеет вид:

y = b0 + b1 x1 + b2 x2 + ...+ bn xn ,

где y — выходная (зависимая) переменная модели;

x1, x2,…, xn — входные (независимые) переменные;

bi — коэффициенты линейной регрессии (b0 — свободный член).

Слайд 7Задача линейной регрессии заключается в подборе коэффициентов bi уравнения таким образом, чтобы

на заданный входной вектор X = (x1, x2,…, xn)T регрессионная модель формировала желаемое выходное значение y

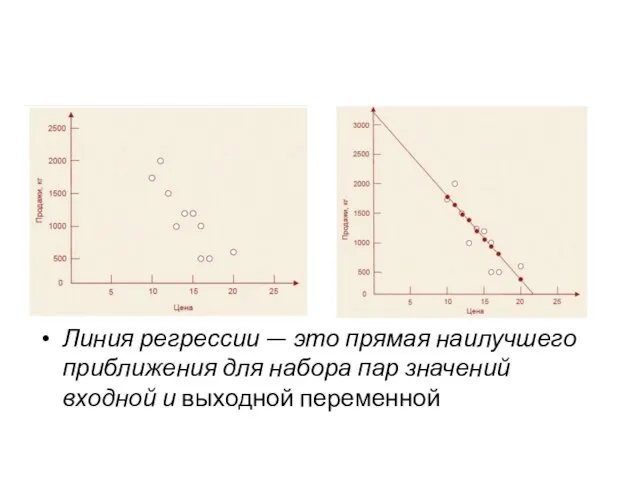

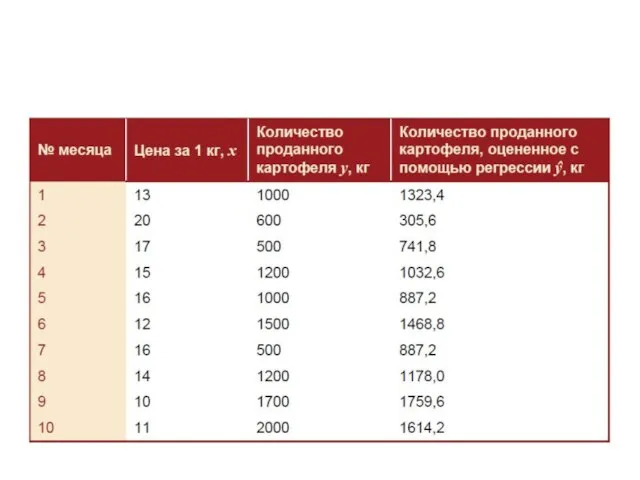

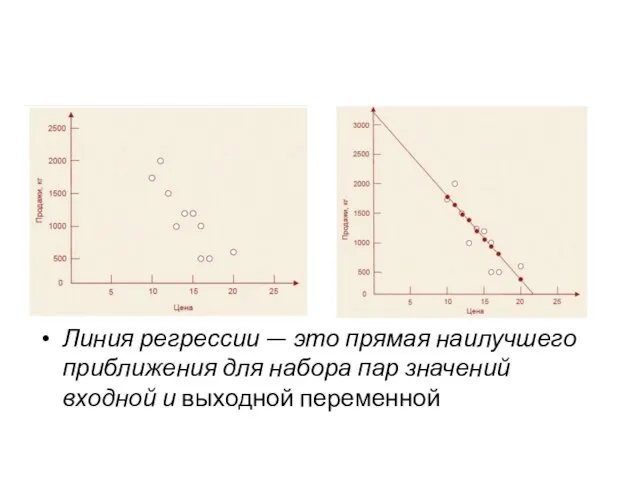

Слайд 9Линия регрессии — это прямая наилучшего приближения для набора пар значений входной

и выходной переменной

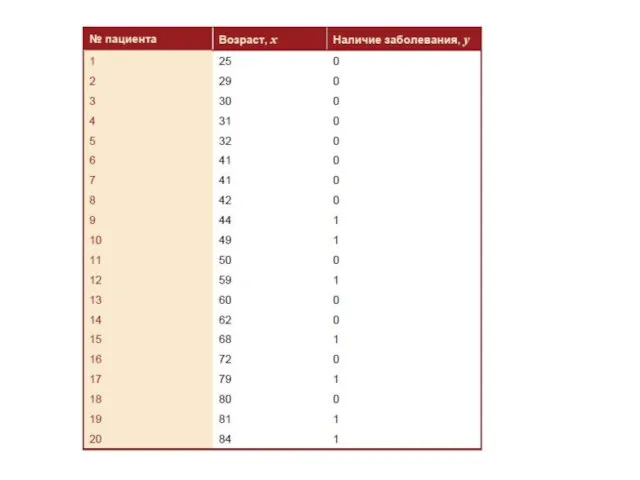

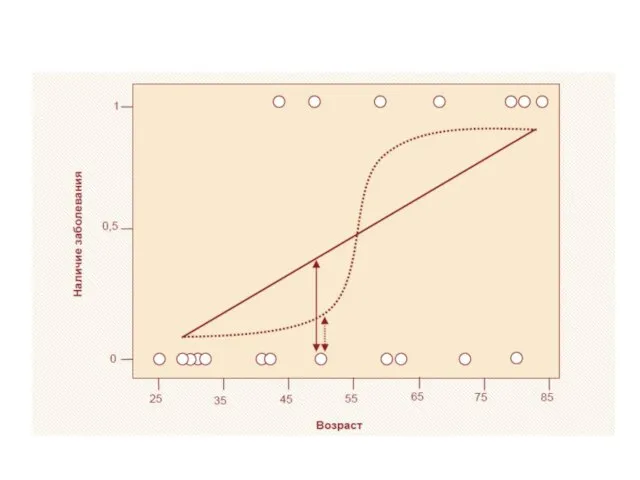

Слайд 10Логистическая регрессия

задачи предсказания вероятности некоторого события в зависимости от значений набора независимых

переменных

логистическая регрессия служит не для предсказания значений зависимой переменной, а для оценки вероятности того, что зависимая переменная примет заданное значение.

Слайд 13Деревья решений

Методы, основанные на обучении

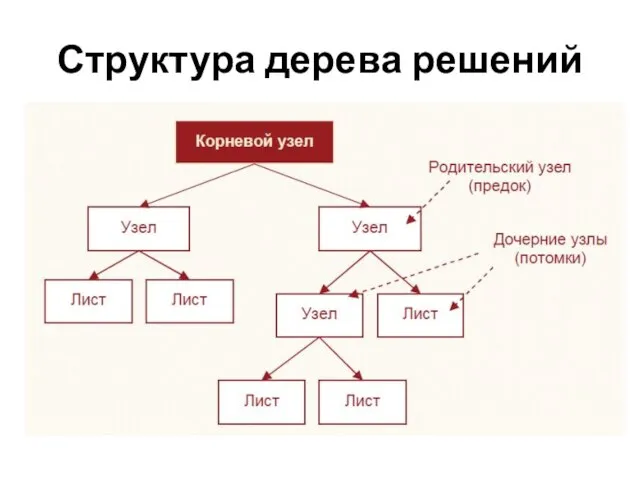

Слайд 14 Дерево решений — это древовидная иерархическая модель, где в каждом узле

производится проверка определенного атрибута (признака) с помощью правила

Деревья решений — иерархические древовидные структуры, состоящие из решающих правил вида «если… то…» и позволяющие выполнять классификацию объектов. В дереве каждому объекту соответствует единственный узел, дающий решение.

Слайд 15Деревья решений — это модели, основанные на обучении. Процесс обучения сравнительно прост

в настройке и управлении.

Процесс обучения деревьев решений быстр и эффективен.

Деревья решений универсальны — способны решать задачи как классификации, так и регрессии.

Деревья решений обладают высокой объясняющей способностью и интерпретируемостью.

Слайд 16Построение дерева

Описание атрибутов

Предварительное определение классов

Различимость классов

Полнота данных

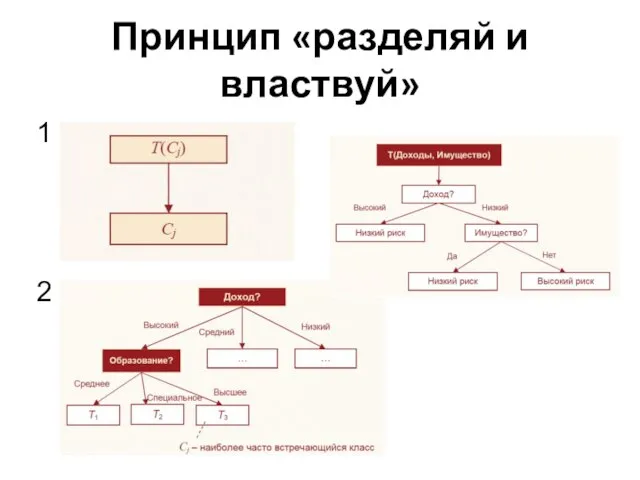

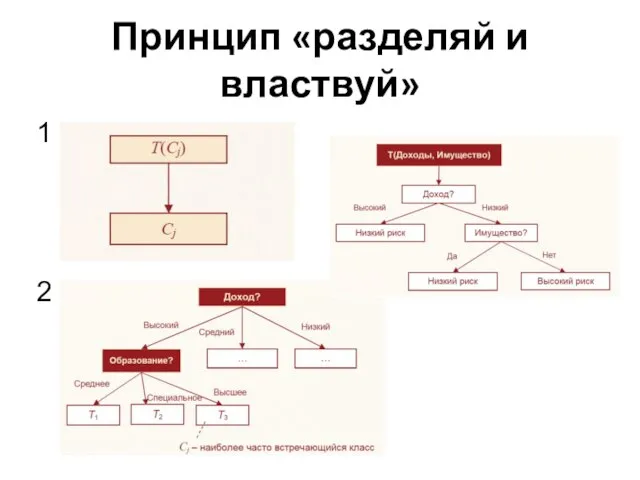

Слайд 18Принцип «разделяй и властвуй»

2 3

Слайд 19Искусственные нейронные сети

Методы, основанные на обучении

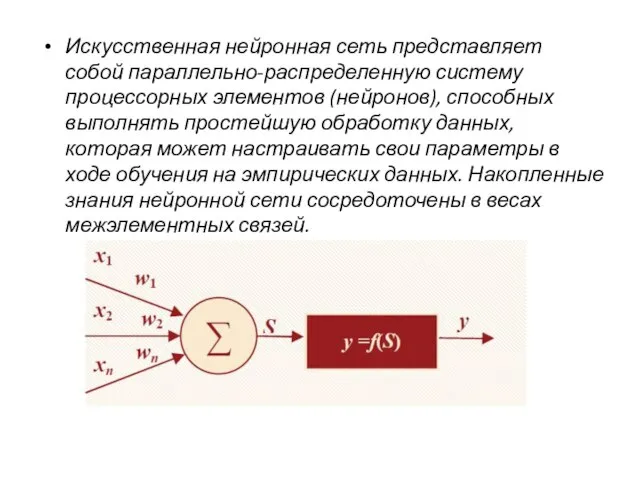

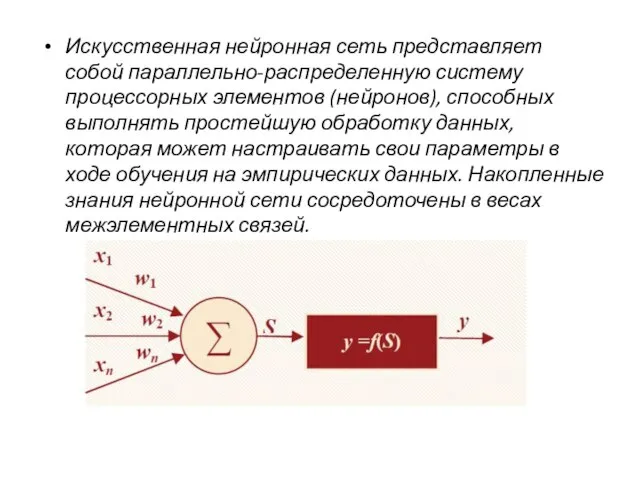

Слайд 20Искусственная нейронная сеть представляет собой параллельно-распределенную систему процессорных элементов (нейронов), способных выполнять

простейшую обработку данных, которая может настраивать свои параметры в ходе обучения на эмпирических данных. Накопленные знания нейронной сети сосредоточены в весах межэлементных связей.

Слайд 21свойства нейронных сетей

Нелинейность.

Обучение на примерах

Параллельная обработка данных.

Адаптивность.

Отказоустойчивость.

Слайд 22Входные данные хорошо интерпретируются

Желаемые результаты также хорошо интерпретируются

Доступный опыт

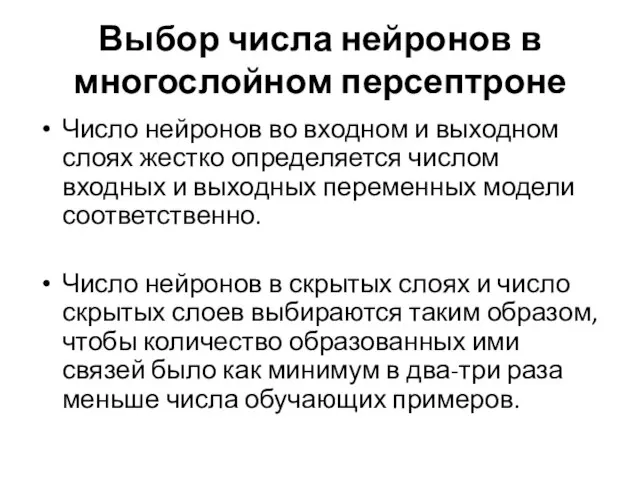

Слайд 23Выбор числа нейронов в многослойном персептроне

Число нейронов во входном и выходном слоях

жестко определяется числом входных и выходных переменных модели соответственно.

Число нейронов в скрытых слоях и число скрытых слоев выбираются таким образом, чтобы количество образованных ими связей было как минимум в два-три раза меньше числа обучающих примеров.

Основы цветоведения

Основы цветоведения Культурная практика по Древней Руси

Культурная практика по Древней Руси Развитие речи

Развитие речи Презентация на тему Культура речи Синтаксические нормы

Презентация на тему Культура речи Синтаксические нормы Ресурсы повышения эффективности индивидуальной профилактической деятельности

Ресурсы повышения эффективности индивидуальной профилактической деятельности Государство

Государство Поверхности. Начертательная геометрия

Поверхности. Начертательная геометрия Особенности современного проектирования

Особенности современного проектирования Дети, как известно, наша боль, наша радость

Дети, как известно, наша боль, наша радость Электронные платежные системы России: игроки, состояние и проблемы

Электронные платежные системы России: игроки, состояние и проблемы Faisons connaissence. Leçon 9

Faisons connaissence. Leçon 9 "Вопорсы дядюшки Светофора"

"Вопорсы дядюшки Светофора" Конструкция There is/there are-There was/there were

Конструкция There is/there are-There was/there were ИРЛАНДИЯ

ИРЛАНДИЯ Сервировка стола к завтраку

Сервировка стола к завтраку Главная улица Москвы Если вы пройдете через Александровский сад и повернете налево,

Главная улица Москвы Если вы пройдете через Александровский сад и повернете налево, Как научить ребёнка сознательно относиться к собственному здоровью

Как научить ребёнка сознательно относиться к собственному здоровью Итоги повышения квалификации специалистов учреждений МСЭ по МКФ в рамках государственной программы «Доступная среда» на 2011-2015 го

Итоги повышения квалификации специалистов учреждений МСЭ по МКФ в рамках государственной программы «Доступная среда» на 2011-2015 го Понятие и содержание законности

Понятие и содержание законности Условия назначения страховой пенсии по старости

Условия назначения страховой пенсии по старости Юрист

Юрист Пассивные операции банков, их характеристика

Пассивные операции банков, их характеристика Презентация на тему Треугольники (5 класс)

Презентация на тему Треугольники (5 класс)  Техника мраморирования в современном дизайне

Техника мраморирования в современном дизайне Речевые секреты

Речевые секреты ВОЗРОЖДЕНИЕ (Ренессанс) Торговая площадь (Гроте-маркт) и ратуша —

ВОЗРОЖДЕНИЕ (Ренессанс) Торговая площадь (Гроте-маркт) и ратуша —  Батьківський комітет. Благодійний внесок

Батьківський комітет. Благодійний внесок Сетевая лаборатория проектного предпринимательского образования

Сетевая лаборатория проектного предпринимательского образования