Содержание

- 2. Все просто! Один час, чтобы предсказать их все. Все преодолимо! Open Source! Что пробовал и куда

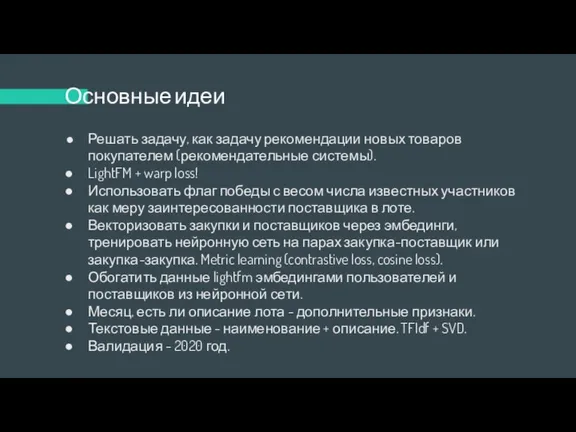

- 3. Основные идеи Решать задачу, как задачу рекомендации новых товаров покупателем (рекомендательные системы). LightFM + warp loss!

- 4. Быстрая и удобная библиотека для построения векторных представлений пар покупатель-товар или закупка-поставщик в нашем случае. Гибкая,

- 5. Распространенная и хорошо поддерживаемая библиотека построения нейронных сетей. Нейронные сети выглядят хорошим способом обработки текста. Pytorch

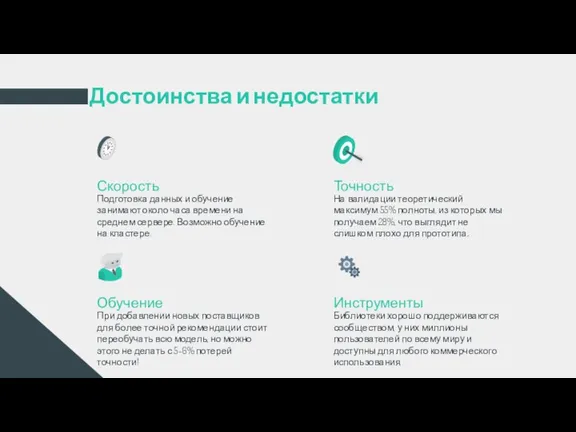

- 6. Подготовка данных и обучение занимают около часа времени на среднем сервере. Возможно обучение на кластере. Точность

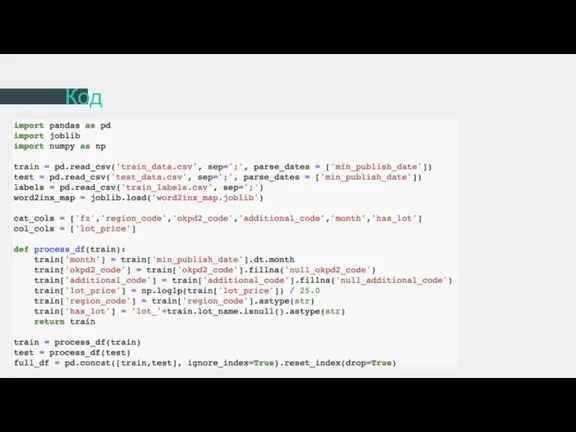

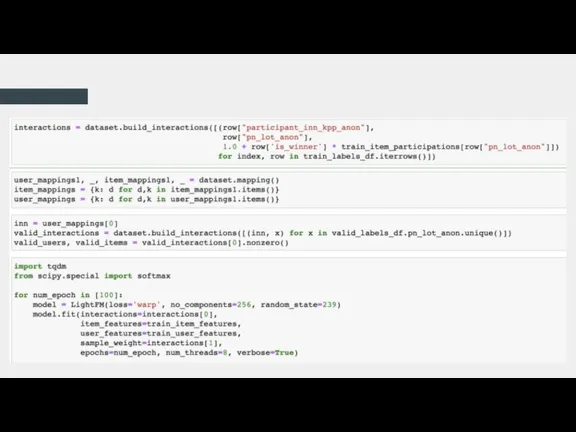

- 7. Код

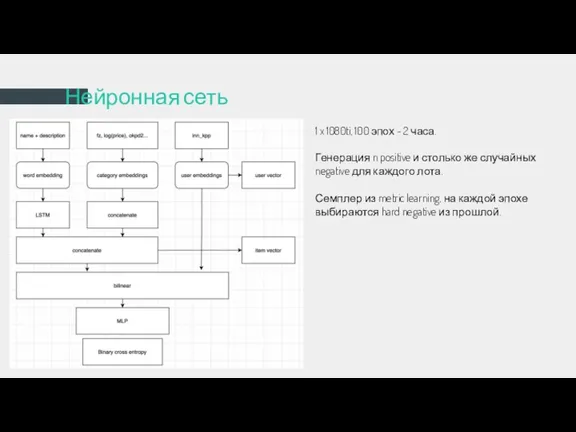

- 9. Нейронная сеть 1 x 1080ti, 100 эпох - 2 часа. Генерация n positive и столько же

- 10. На компьютере 8 ядер, 32 гигабайта памяти, время обучения модели на полном датасете 1 час. Скорость

- 11. Как улучшить Обучить лингвистические модели на специфичном корпусе описаний и получить вектора текста для lightfm. Тематическое

- 12. Metric learning для item-item contrastive, arcface, margin loss. Порядка 0.18 на валидации. Предсказывать вектор эмбединга следующей

- 14. Скачать презентацию

Практика 3 ИВМО-05-22 Филиппов Н.И. Microsoft Analysis Services

Практика 3 ИВМО-05-22 Филиппов Н.И. Microsoft Analysis Services Алгорітми стискання інформації

Алгорітми стискання інформації Этапы разработки программы. Структурное программирование для АСУб и ЭВМб (тема 1-2)

Этапы разработки программы. Структурное программирование для АСУб и ЭВМб (тема 1-2) Евфрат 2011

Евфрат 2011 2 ЛЕКЦИЯ

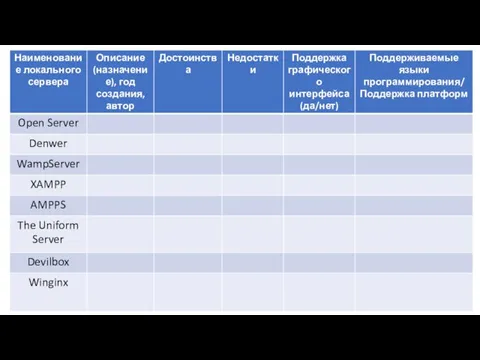

2 ЛЕКЦИЯ Сравнительная характеристика локальных серверов. Шаблон

Сравнительная характеристика локальных серверов. Шаблон Архитектура персонального компьютера

Архитектура персонального компьютера Имя цвета в системе NCS

Имя цвета в системе NCS Операторы языка C#. (Лекция 3)

Операторы языка C#. (Лекция 3) Архитектура операционной системы

Архитектура операционной системы Применение программного комплекса ТБ-HAZOP+SIL для решения задач интегрального анализа угроз

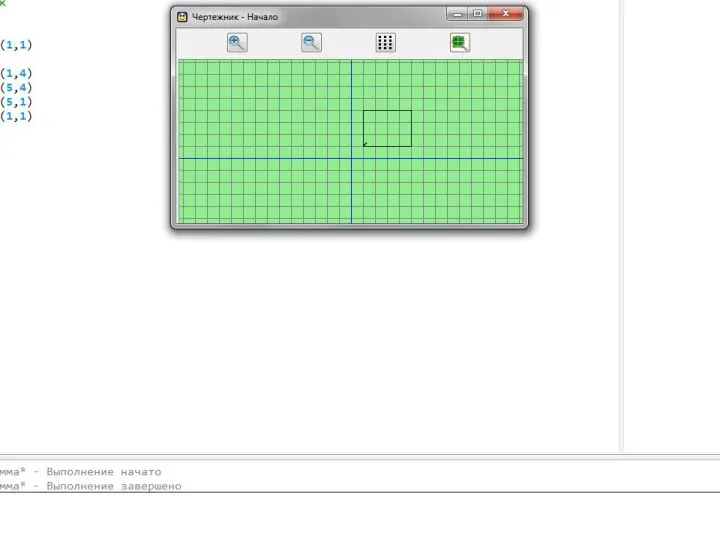

Применение программного комплекса ТБ-HAZOP+SIL для решения задач интегрального анализа угроз Пограмма Чертежник

Пограмма Чертежник Магистрально-модульный принцип построения компьютера

Магистрально-модульный принцип построения компьютера Кодирование звуковой информации.pptx

Кодирование звуковой информации.pptx Графический редактор

Графический редактор Доказательство правильности программ. Структурное программирование

Доказательство правильности программ. Структурное программирование Кабинет студента в системе Антиплагиат.ВУЗ

Кабинет студента в системе Антиплагиат.ВУЗ Мобильный деканат

Мобильный деканат Понятие информации Урок 2 10 Класс

Понятие информации Урок 2 10 Класс Оконное приложение С++. Матрица

Оконное приложение С++. Матрица Розробка універсального відношення

Розробка універсального відношення Разработка модели современной системы оплаты проезда в Санкт-Петербурге

Разработка модели современной системы оплаты проезда в Санкт-Петербурге Осторожно, вирус!

Осторожно, вирус! Информатика. Введение

Информатика. Введение Моделирование этапов обеспечения безопасности обмена информацией пользователей локальной сети

Моделирование этапов обеспечения безопасности обмена информацией пользователей локальной сети MalakhovOFF advertises LIVE: his well-baby check

MalakhovOFF advertises LIVE: his well-baby check Порядок передачи ВКР для размещения в электронной библиотеке

Порядок передачи ВКР для размещения в электронной библиотеке Teen Travel. Видеоблог о путешествиях подростков

Teen Travel. Видеоблог о путешествиях подростков