Содержание

- 2. АЛГОРИТМИЧЕСКАЯ СЛОЖНОСТЬ связана с тем, насколько быстро или медленно работает конкретный алгоритм. Мы определяем сложность как

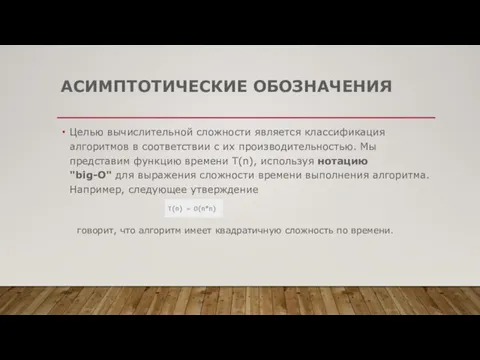

- 3. АСИМПТОТИЧЕСКИЕ ОБОЗНАЧЕНИЯ Целью вычислительной сложности является классификация алгоритмов в соответствии с их производительностью. Мы представим функцию

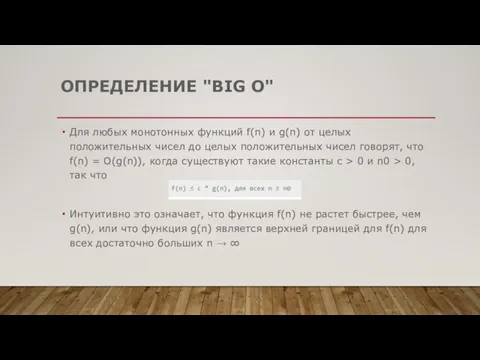

- 4. ОПРЕДЕЛЕНИЕ "BIG O" Для любых монотонных функций f(n) и g(n) от целых положительных чисел до целых

- 5. ГРАФИЧЕСКОЕ ПРЕДСТАВЛЕНИЕ ОТНОШЕНИЯ F(N) = O(G(N)):

- 6. ПРИМЕРЫ: "big-O" нотация не симметрична: n = O(n2) но n2 ≠ O(n).

- 7. ПОСТОЯННОЕ ВРЕМЯ: O(1) Говорят, что алгоритм работает за постоянное время, если ему требуется одинаковое количество времени

- 8. ЛИНЕЙНОЕ ВРЕМЯ: O(N) Говорят, что алгоритм работает за линейное время, если его выполнение по времени прямо

- 9. ЛОГАРИФМИЧЕСКОЕ ВРЕМЯ: O(LOG N) Говорят, что алгоритм работает за логарифмическое время, если его время выполнения пропорционально

- 10. КВАДРАТИЧНОЕ ВРЕМЯ: O(N*N) Говорят, что алгоритм работает за квадратичное время, если его время выполнения пропорционально квадрату

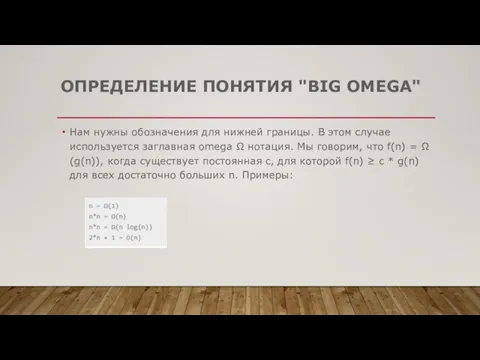

- 11. ОПРЕДЕЛЕНИЕ ПОНЯТИЯ "BIG OMEGA" Нам нужны обозначения для нижней границы. В этом случае используется заглавная omega

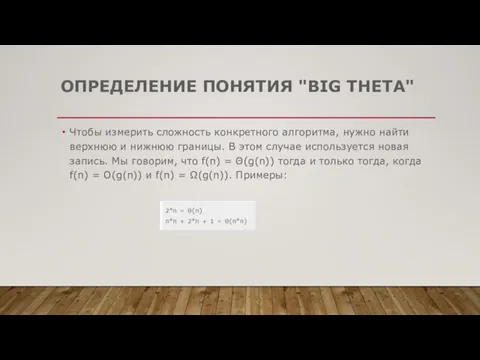

- 12. ОПРЕДЕЛЕНИЕ ПОНЯТИЯ "BIG THETA" Чтобы измерить сложность конкретного алгоритма, нужно найти верхнюю и нижнюю границы. В

- 13. АНАЛИЗ АЛГОРИТМОВ Наихудшая сложность алгоритма во время выполнения - это функция, определяемая максимальным количеством шагов, сделанных

- 15. Скачать презентацию

Структурировать информацию по блокам/проектам, изложив на слайде (или нескольких)

Структурировать информацию по блокам/проектам, изложив на слайде (или нескольких) Какое-нибудь крутое название. Шаблон

Какое-нибудь крутое название. Шаблон Решение прикладных задач и разработка приложений на языке Python

Решение прикладных задач и разработка приложений на языке Python Информационное обеспечение российской системы стандартизации

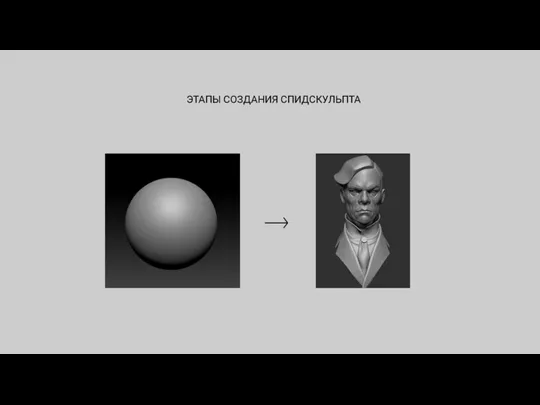

Информационное обеспечение российской системы стандартизации Этапы создания спидскульпта

Этапы создания спидскульпта Джерело інформації

Джерело інформації Текстовые документы и технологии их создания обработка текстовой информации

Текстовые документы и технологии их создания обработка текстовой информации Контент для каждого. Мастер-класс для участников экспресс-курса Основы SMM

Контент для каждого. Мастер-класс для участников экспресс-курса Основы SMM МК Осенний листопад

МК Осенний листопад Мой личный сайт. Проект

Мой личный сайт. Проект 14 ip

14 ip Характерные особенности полустатических структур

Характерные особенности полустатических структур Информация и её свойства

Информация и её свойства Практикум овладения компьютером (технология) 3 класс

Практикум овладения компьютером (технология) 3 класс Цифровая трансформация общества

Цифровая трансформация общества Командная игра для 10-11 классов Виртуальный батл

Командная игра для 10-11 классов Виртуальный батл Модели данных. Современные СУБД (Урок 2)

Модели данных. Современные СУБД (Урок 2) РћРњРћР__Лекция 2_Дискретные Рё непрерывные РјРѕРґРµРРё

РћРњРћР__Лекция 2_Дискретные Рё непрерывные РјРѕРґРµРРё Презентация на тему Число и кодирование информации

Презентация на тему Число и кодирование информации  Псевдокод

Псевдокод Основы проектной деятельности.1 лекция Введение 5 класс

Основы проектной деятельности.1 лекция Введение 5 класс Python. Множества и словари. Урок 7

Python. Множества и словари. Урок 7 Презентация на тему Алгоритмы на графах: определение наличия циклов в графе

Презентация на тему Алгоритмы на графах: определение наличия циклов в графе  Анимированная открытка. Мы помним

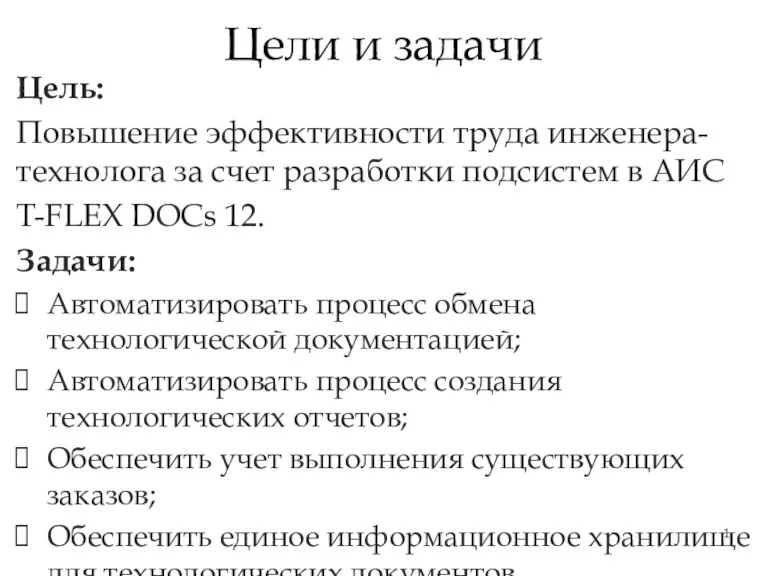

Анимированная открытка. Мы помним ВКР: Повышение эффективности труда инженера-технолога за счет разработки подсистем в АИС T-FLEX DOCs 12

ВКР: Повышение эффективности труда инженера-технолога за счет разработки подсистем в АИС T-FLEX DOCs 12 Системное программное обеспечение

Системное программное обеспечение Toshkent shaxridagi AYOQSHlarni hisobga olish axborot tizimini yaratish

Toshkent shaxridagi AYOQSHlarni hisobga olish axborot tizimini yaratish Системное программное обеспечение. OC Windows. (Лекция 6.3)

Системное программное обеспечение. OC Windows. (Лекция 6.3)